C-3PO es uno de los robots de cine más reconocibles, pero rara vez aparecen réplicas que intenten capturar lo realmente difícil del personaje: su voz. La mayoría de los proyectos maker que abordan al droide se quedan en la apariencia exterior y dejan en silencio al protagonista. La dificultad es comprensible. Recrear el habla y los gestos de C-3PO siempre fue un desafío inalcanzable hasta hace poco, pero la combinación de modelos de lenguaje grandes, transcripción en tiempo real y síntesis de voz neural cambió las reglas. El maker estadounidense Samuel Potozkin lo demuestra con su proyecto de C-3PO conversacional.

¿Qué hardware lleva esta réplica?

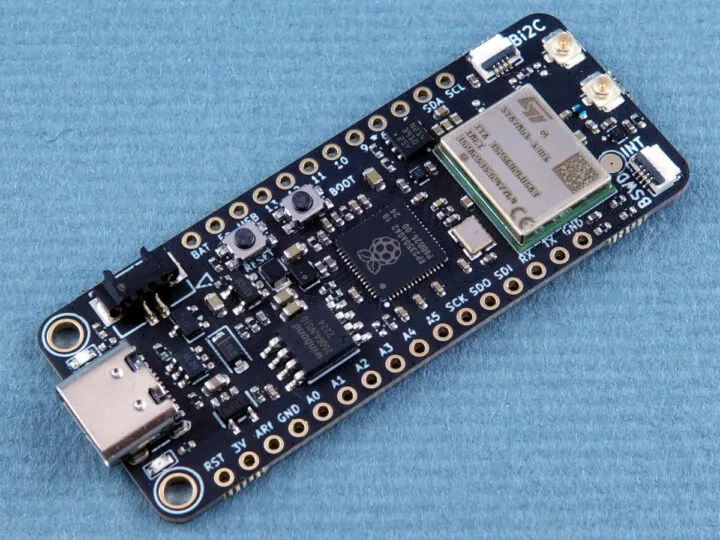

No estamos frente a un C-3PO completo. Solo la cabeza, lo que para los propósitos del proyecto basta y sobra, ya que toda la interacción ocurre por voz. El cerebro del droide es una Raspberry Pi 5, que en su variante de 8 GB de RAM cuesta cerca de 80.000 pesos chilenos en distribuidores como MechatronicStore. El sistema corre sobre Linux con un pipeline de procesamiento de audio en tres etapas.

| Etapa | Tecnología | Función |

|---|---|---|

| Captura | Micrófono USB | Grabación de voz humana |

| STT | Modelo speech-to-text en tiempo real | Transcribir a texto |

| LLM | Modelo de lenguaje | Generar respuesta con persona C-3PO |

| TTS | Sintetizador entrenado | Convertir texto a voz "C-3PO" |

| Reproducción | Parlante integrado | Salida audible |

¿Cómo se logra que suene a C-3PO?

El paso más interesante del pipeline es la capa de procesamiento que convierte una respuesta genérica del LLM en algo que suena como el droide protocolar de Star Wars. Potozkin entrenó (o más probablemente fine-tuned) un sintetizador de voz neural sobre clips del actor Anthony Daniels, quien interpreta a C-3PO desde la película original de 1977. La salida tiene la cadencia característica del personaje: ese tono nervioso, ligeramente formal y con pausas exageradas en los momentos equivocados.

La capa intermedia entre el LLM y el TTS es la que ajusta el "vibe" general de las respuestas. No basta con que el modelo genere una respuesta literalmente correcta. Tiene que sonar como algo que C-3PO diría: con ansiedad, con quejas sobre las probabilidades, con ese registro a la vez servil e impaciente.

¿Vale la pena vs un asistente comercial?

Aquí aparece el punto débil. El proyecto tiene latencia notable. Entre que el usuario termina de hablar y la cabeza responde pasan varios segundos, suficientes para romper la ilusión conversacional. Y el patrón de habla, aunque la voz mimiquea bien al droide, queda algo robótico, irónicamente, en un sentido distinto al del personaje en la película. C-3PO en pantalla es nervioso pero fluido. Esta versión es nerviosa y entrecortada por motivos técnicos, no actorales.

Aún así, el resultado es valioso. Hace cinco años, replicar este efecto requería un equipo de ingenieros de audio en un estudio. Hoy un maker con una Raspberry Pi 5 y un LLM open source corriendo localmente o en la nube por menos de USD 5 al mes puede llegar a algo cercano. La materia prima del proyecto está disponible: los archivos del build se publicaron en Google Drive y el código vive en GitHub bajo el repositorio threepio.

¿Qué falta para una réplica realmente convincente?

La latencia se puede reducir con modelos LLM más pequeños corriendo localmente, sin depender de la nube. Modelos como Llama 3.2 3B o Phi-3 Mini funcionan en una Raspberry Pi 5 con respuestas en menos de 2 segundos. La síntesis de voz también puede mejorar con modelos como XTTS-v2 que clonan voces con apenas seis segundos de muestra. Y la animación de la cabeza, que en este proyecto está limitada, podría incorporarse con servos sincronizados con los fonemas del audio.

Hackaday ya ha cubierto otras réplicas más clásicas de droides, pero esta es la primera que va más allá de lo decorativo y propone una interacción real. Para fans del universo Star Wars y makers que disfruten cruzar fandom con ingeniería, el repositorio público es un excelente punto de partida.