Anthropic ha activado en beta pública una capa de memoria para Claude Managed Agents que combina rendimiento y control para que los agentes acumulen aprendizaje sesión tras sesión. La pieza diferencial está en el formato de almacenamiento: cada memoria queda guardada como archivo exportable, accesible vía API y bajo gobierno del propio cliente. Un equipo puede abrir esos archivos, modificarlos, llevárselos a otra plataforma o borrarlos sin pedir permiso. La memoria deja de ser una caja opaca; pasa a ser un registro auditable y transferible.

El caso emblemático que la compañía presenta llega desde Rakuten, uno de los mayores grupos japoneses de comercio electrónico. Yusuke Kaji, General Manager de AI for Business del conglomerado, firma las cifras: caída del 97% en errores de primera iteración, reducción del 27% en el coste por tarea y bajada del 34% en la latencia, todo derivado del componente de memoria. Su frase resume el espíritu del despliegue: "La memoria en Claude Managed Agents nos permite poner el aprendizaje continuo en producción a escala. Nuestros agentes destilan lecciones de cada sesión... y como la memoria tiene alcance de workspace y es observable, el aprendizaje continuo se mantiene bajo nuestro control". Tres atributos resumen la propuesta: scoped (alcance acotado al workspace), observable (inspeccionable por el equipo) y exportable (transferible fuera del sistema).

El problema de la memoria en agentes autónomos

Cuando un agente de IA carece de memoria, opera en modo amnésico permanente. Cada inicio implica empezar de cero. Si una unidad de soporte automatiza la revisión de 500 tickets diarios, el agente no transfiere nada de los primeros 100 a los 400 restantes. De ahí brotan dos limitaciones graves. La primera, el agente vuelve a tropezar con los mismos errores que ya cometió antes. La segunda, los humanos tienen que verificar cada output con la misma exigencia siempre, porque ningún elemento sugiere que el agente haya progresado. Los workflows agénticos sin memoria escalan en volumen pero no en calidad, y en dominios técnicos , programación, finanzas, soporte avanzado, ese límite separa la automatización útil de la decepcionante.

Anthropic ha venido pavimentando este lanzamiento durante meses. El bosquejo conceptual de la memoria de larga duración para agentes Claude ya asomaba en el Claude Agent SDK de finales de 2025, cuando la firma probó arquitecturas de dos agentes , un inicializador y otro de codificación, para mantener contexto entre sesiones. Claude Managed Agents con memoria llega como la versión consolidada de aquella línea: un servicio gestionado donde la memoria deja de ser un patrón que cada cliente reinventa para convertirse en pieza nativa de la infraestructura.

Los tres casos de uso que Anthropic destaca

La firma señala tres escenarios donde la memoria reescribe el flujo de trabajo. Primero, cerrar el bucle de feedback: el agente captura las correcciones humanas sobre sus errores y las usa como guía para sesiones posteriores. No solo deja de repetir el mismo fallo, sino que afina su comportamiento para alinearse con las preferencias del equipo. Segundo, agilizar la verificación: si un equipo confirma que el agente ha asimilado las reglas del dominio, puede aprobar resultados con menos revisión por output, multiplicando el throughput del sistema. Tercero, sustituir RAG custom: muchas organizaciones han fabricado pipelines propios de Retrieval-Augmented Generation para abastecer de contexto a sus agentes; la memoria nativa de Managed Agents reemplaza parte de esa fontanería interna y reduce complejidad operativa.

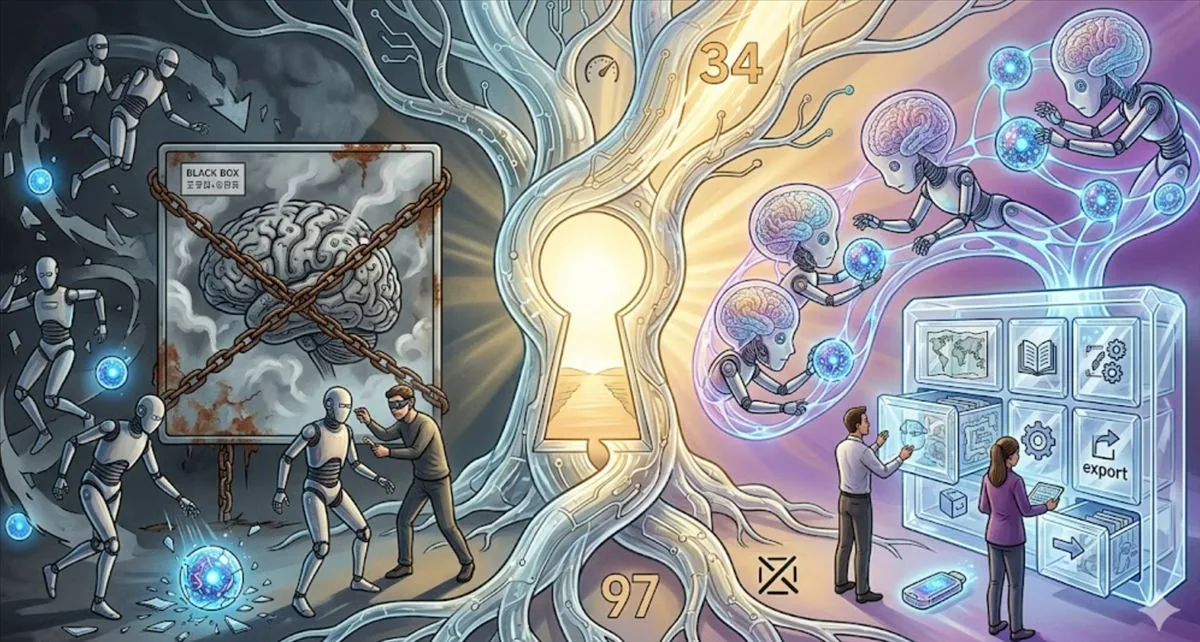

Archivos exportables: el antídoto al lock-in

La elección más astuta del anuncio es el formato de archivo. Almacenar la memoria como ficheros tiene cuatro consecuencias prácticas. Primero, observabilidad: el equipo puede abrir los archivos y leer literalmente qué aprendió el agente, sin tener que deducirlo del comportamiento. Segundo, portabilidad: si una organización decide mover su stack a otro proveedor, las memorias viajan con él, evitando el clásico secuestro de datos por parte de la plataforma. Tercero, compliance: los archivos pueden auditarse, revisarse por equipos legales o redactarse de forma selectiva si contienen información sensible. Cuarto, edición manual: cuando una memoria está sesgada o equivocada, el equipo la corrige directamente en lugar de esperar a que el agente la sobrescriba por exposición contraria.

Esa decisión rompe con la opacidad de la competencia. OpenAI y Google administran la memoria de sus agentes como estado interno no transferible. Anthropic, en cambio, apuesta por la transparencia radical y el mensaje comercial es nítido: "no quedas amarrado a nosotros". La filosofía de Claude de fabricar herramientas para desarrolladores donde el control del usuario es explícito y la observabilidad ocupa el centro también aflora en productos como Claude Code 2.1.0 con sesiones portables y permisos granulares, o Claude Cowork, donde el acceso del agente a los archivos del usuario se concede de forma supervisada y auditable.

Los números de Rakuten en contexto

El recorte del 97% en errores de primera iteración es el dato que más resuena, pero también el que más matización exige. "Primera pasada" significa que el agente entrega resultados aceptables sin requerir corrección humana inmediata. Antes del despliegue de memoria, prácticamente cualquier output (97%) necesitaba algún tipo de retoque humano. Ahora solo un 3% lo requiere. Esa concentración del esfuerzo de revisión es lo que justifica económicamente que un equipo humano supervise agentes en lugar de competir contra ellos. La caída del 27% en costes nace, casi seguro, de dos lugares: menos llamadas al modelo (porque el agente cierra tareas en menos vueltas) y menos horas humanas dedicadas a verificar. La reducción del 34% en latencia es el corolario lógico: el agente alcanza antes la respuesta correcta, y el ciclo de extremo a extremo se acorta proporcionalmente.

Son cifras de un cliente concreto en un escenario concreto: Rakuten gestiona miles de flujos de comercio electrónico donde los agentes ejecutan trabajo repetitivo aunque no trivial. Extrapolarlas a otras industrias exige cautela, pero el orden de magnitud es elocuente: una implementación seria de memoria en agentes puede transformar la economía del despliegue agéntico.

El contexto competitivo

La carrera de los agentes gestionados se está intensificando. OpenAI sumó memoria persistente a Codex para Mac la semana pasada, acercándose a lo que Anthropic ya ofrecía con Claude Code y Cowork, y con esta jugada en Managed Agents Anthropic mantiene la presión en el segmento de agentes desplegados a escala empresarial. Google también incorporó Memory Bank y Memory Profiles a Agent Platform en el último Cloud Next. Los tres grandes pelean por consolidarse como infraestructura estándar para agentes corporativos, y la memoria se ha convertido en el frente más visible de competencia tras 18 meses donde el centro de gravedad estaba solo en el modelo base.

Mi valoración

La pieza más relevante del anuncio no son las cifras de Rakuten, que dependen del contexto y son difíciles de replicar en otros workflows. Lo verdaderamente diferencial es la decisión de diseño de almacenar memorias en archivos exportables. Eso constituye un compromiso implícito con la portabilidad de los datos del cliente y marca distancia respecto a competidores que tratan el estado del agente como propiedad de la plataforma. Para clientes empresariales que se preocupan por el lock-in, la continuidad del servicio o el cumplimiento normativo, esa elección puede pesar más que el 97% de mejora en errores. Es del tipo de decisión que se toma cuando la estrategia comercial se alinea con la postura ética declarada: Anthropic ha tejido su marca sobre la idea de "somos los buenos de la IA" y la memoria portable es una prueba tangible de esa narrativa. Cuánto durará si los incentivos de crecimiento empujan en sentido contrario es otra historia: ya hemos visto a Anthropic cerrar accesos a frameworks open source como OpenClaw cuando la suscripción dejaba de cuadrar. La tensión entre lo abierto y lo rentable es permanente. De momento, la implementación es coherente con el discurso.

La segunda lectura clave es que la memoria convierte Claude Managed Agents de una curiosidad en una infraestructura desplegable. Sin memoria, los agentes son piezas dispersas. Con memoria observable y exportable, son sistemas compatibles con un compliance empresarial serio, auditorías anuales y gobernanza de datos. Para un CIO que evalúa si los agentes en producción son viables, este lanzamiento mueve la aguja. Para el ecosistema agéntico en general, confirma que 2026 es el año de la memoria: quien no la traiga, controlable y observable, no jugará en la división empresarial.

Preguntas frecuentes

¿Qué son Claude Managed Agents? Servicio donde Anthropic gestiona la infraestructura de ejecución de agentes , hosting, escalado, seguridad, mientras el cliente solo configura el agente y lo conecta con sus flujos vía API. Es un producto distinto a Claude Code (orientado a desarrolladores) o a Cowork (asistente de escritorio).

¿La memoria está disponible para Claude Code o Cowork? El anuncio se concentra específicamente en Claude Managed Agents. Claude Code y Cowork ya disponían de funciones de memoria con arquitecturas distintas. La beta pública con archivos exportables es una novedad exclusiva de Managed Agents.

¿Puedo exportar las memorias a otro proveedor? En principio sí. Los archivos quedan en formato inspeccionable y exportable vía API. La compatibilidad semántica con los sistemas de memoria de OpenAI o Google dependerá de cómo cada proveedor implemente la ingesta de memoria externa, pero los datos son portables.