Puntos clave

- Tras las quejas de usuarios por la caída de calidad en Claude Code, Anthropic identificó y corrigió tres bugs independientes que afectaban la profundidad de razonamiento, el sistema de caché y las restricciones de longitud de texto.

- Para evitar incidentes similares, la empresa está endureciendo las pruebas internas antes de lanzar actualizaciones. Como compensación, Anthropic restableció los límites de uso de todos los suscriptores.

- Los problemas reflejan una escasez de cómputo que afecta a toda la industria, que cada vez más provoca interrupciones y obliga a los proveedores de IA a subir los precios de las herramientas con mayor demanda de cómputo.

Durante el último mes, un número creciente de usuarios reportó que la herramienta de programación Claude Code de Anthropic producía resultados notablemente peores. Anthropic acaba de publicar las causas en un análisis post-mortem detallado: tres cambios independientes en Claude Code, el Claude Agent SDK y Claude Cowork se combinaron para generar una caída de calidad generalizada. La API en sí no se vio afectada, según Anthropic. Los tres problemas fueron corregidos el 20 de abril con la versión 2.1.116.

Menor esfuerzo de razonamiento, bugs de caché y restricciones de prompt

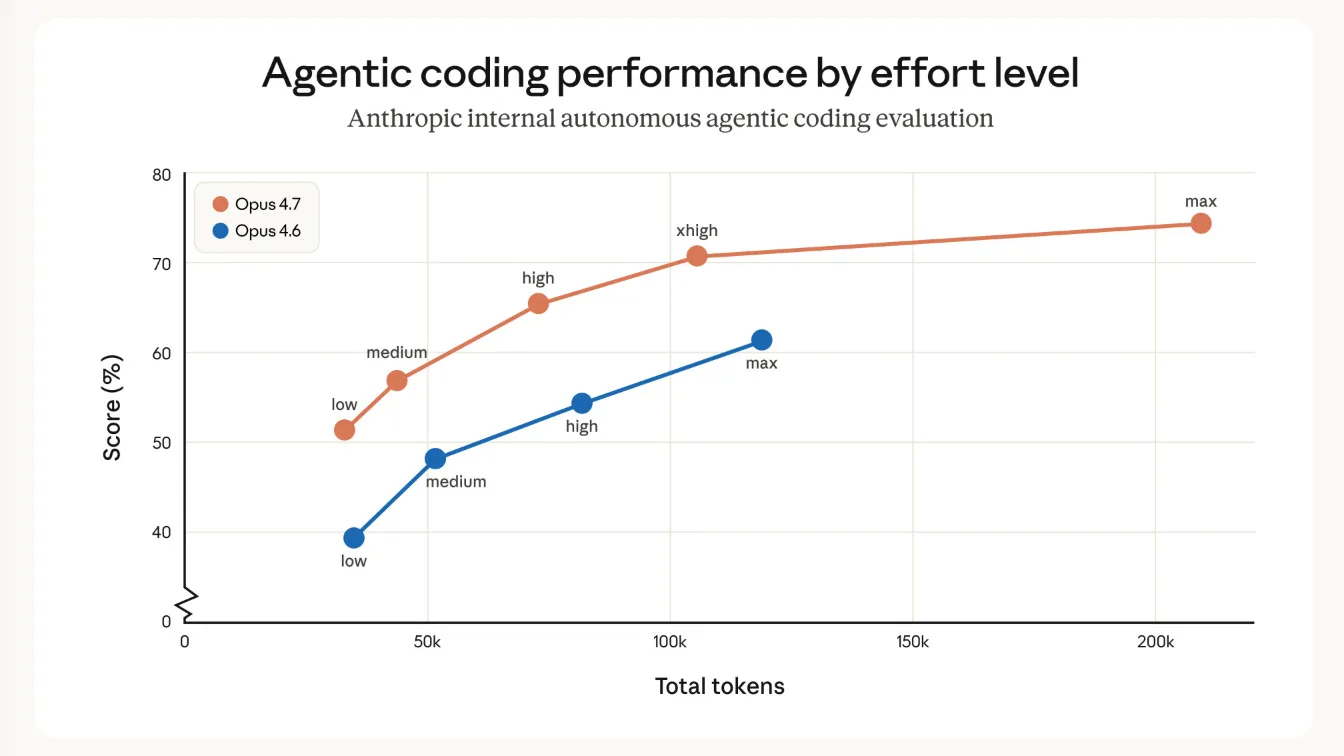

El primer problema data del 4 de marzo. Anthropic redujo el esfuerzo de razonamiento por defecto de "alto" a "medio" porque algunos usuarios experimentaban una latencia extrema en el modo alto. Las pruebas internas indicaban que el modo medio producía resultados solo ligeramente peores en la mayoría de las tareas, mientras reducía la latencia de forma significativa. El compromiso no funcionó: los usuarios reportaron rápidamente que Claude Code se sentía menos inteligente. El 7 de abril, Anthropic revirtió el cambio de forma permanente.

El segundo problema fue un bug en una optimización de caché lanzada el 26 de marzo. El plan era eliminar las secciones de razonamiento más antiguas tras una hora de inactividad para reducir la latencia al retomar una sesión. Un error de codificación hizo que el historial de razonamiento se borrara en cada turno subsiguiente en lugar de solo una vez.

Claude fue perdiendo progresivamente el contexto sobre sus propias decisiones. Los usuarios notaron olvidos, repeticiones y elecciones extrañas de herramientas. Además, los fallos de caché resultantes consumieron los límites de uso más rápido de lo esperado. Según Anthropic, el bug pasó desapercibido durante las revisiones y no fue corregido hasta el 10 de abril.

Un tercer problema apareció el 16 de abril: una instrucción en el system prompt diseñada para frenar la conocida verbosidad de Opus 4.7. La línea decía: "Límites de longitud: mantén el texto entre llamadas a herramientas en ≤25 palabras. Mantén las respuestas finales en ≤100 palabras a menos que la tarea requiera más detalle". Pruebas posteriores con un conjunto de evaluación más amplio revelaron una caída de calidad del 3%. Anthropic revirtió el cambio el 20 de abril.

Anthropic refuerza los controles de calidad

Como cada cambio afectó a grupos de usuarios distintos en momentos distintos, el efecto combinado se percibió como un deterioro vago y gradual, difícil de distinguir al principio de la variación normal.

De cara al futuro, Anthropic anuncia que más empleados usarán la versión pública exacta de Claude Code en lugar de versiones de prueba internas. Todo cambio en el system prompt tendrá que superar un conjunto de evaluación amplio y específico para el modelo.

Para los cambios que puedan afectar la inteligencia, Anthropic planea introducir períodos de prueba ("soak periods") y despliegues graduales. Como compensación, la empresa restableció los límites de uso de todos los suscriptores.

Anthropic también creó la cuenta de X @ClaudeDevs para comunicar las decisiones de producto con mayor transparencia.

Las caídas de calidad percibidas siguen siendo un tema recurrente en la industria

No es la primera vez que los usuarios se quejan de una caída de calidad en la IA. En la segunda mitad de 2023, los usuarios acusaron a OpenAI de hacer que GPT-4 fuera "más tonto" con el tiempo. OpenAI negó haber realizado cambios significativos en sus modelos tras el lanzamiento.

Claude ya había enfrentado quejas similares, con bugs de infraestructura como causa. El caso actual refuerza un patrón: lo que los usuarios perciben como regresiones del modelo a menudo resulta ser cambios en la capa de herramientas o infraestructura, y no en los propios modelos. En uso real, los usuarios se benefician del scaffolding como Claude Code porque orienta las capacidades del modelo y proporciona el contexto adecuado. Cuando ese scaffolding falla, ocurre lo contrario. Si a eso se añaden ajustes del proveedor como el cambio de profundidad de razonamiento de Anthropic, el efecto se amplifica.

La motivación detrás de estos cambios está cada vez más relacionada con una escasez de cómputo que afecta a toda la industria. La disponibilidad de la API de Anthropic estuvo recientemente en solo el 98,95%, muy por debajo del estándar del sector cloud del 99,99%. Los precios por hora de GPU en el mercado spot subieron un 48% según el Índice de Precios de Cómputo de Ornn, y los analistas de Bank of America esperan que la demanda supere a la oferta al menos hasta 2029. OpenAI cerró su aplicación de generación de vídeo Sora para liberar cómputo destinado a productos de codificación y empresas. GitHub también pausó los nuevos registros en varios niveles de Copilot.

Esta presión también está alterando los modelos de precios. El responsable de crecimiento de Anthropic reconoció recientemente que los planes Pro y Max actuales no fueron diseñados para las cargas de trabajo agénticas actuales, ya que se crearon antes de que existieran herramientas de uso intensivo de cómputo como Claude Code. La empresa incluso probó brevemente eliminar el acceso a Claude Code para los nuevos suscriptores Pro, pero dio marcha atrás tras las críticas.

OpenAI, por su parte, duplicó los precios de la API con GPT-5.5 respecto a su predecesor, cobrando 5 dólares por millón de tokens de entrada y 30 dólares por millón de tokens de salida. La era de las tarifas planas baratas para las herramientas de IA agéntica más potentes parece estar llegando a su fin.