Correr modelos de lenguaje de manera local exige VRAM, y en plena demanda por GPUs de IA el costo de una placa nueva con 16 GB se disparó. La alternativa más viable hoy pasa por silicio antiguo. El youtuber Hardware Haven documentó la conversión de una Nvidia Tesla V100 de servidor, originalmente diseñada para despliegues rack-scale con socket SMX, a una placa de formato PCIe estándar capaz de funcionar en cualquier motherboard de consumidor.

¿Qué es una V100 con socket SMX y cómo se adapta a PCIe?

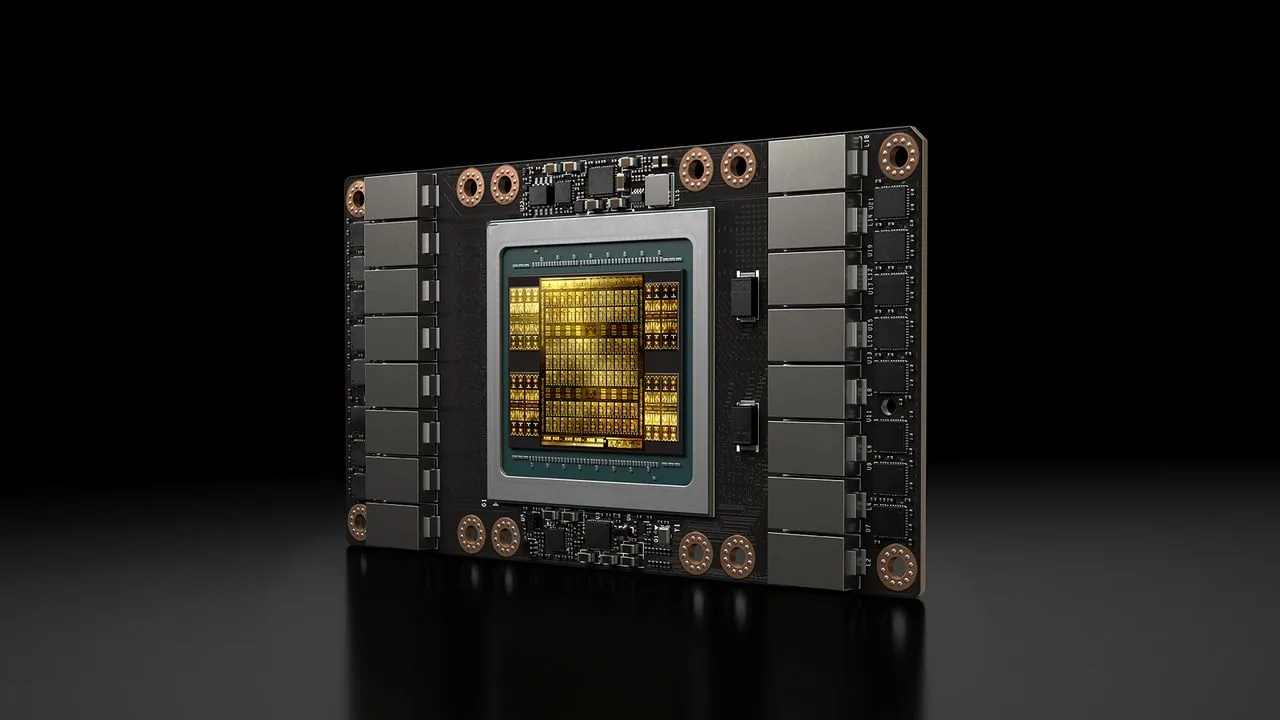

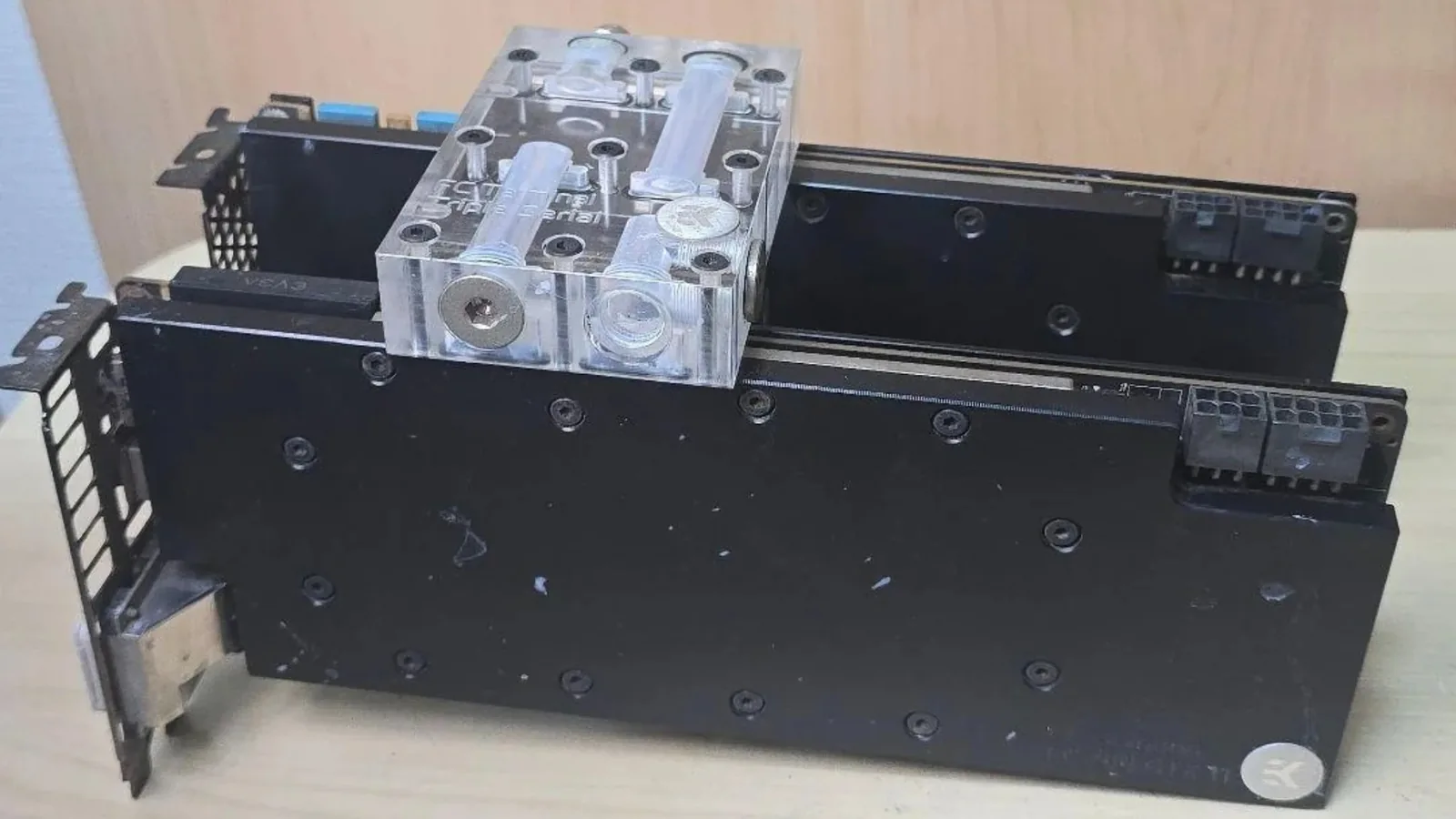

El SMX es un conector mezzanine: la GPU se atornilla plana contra un baseboard especializado, similar a un socket de CPU. Para aprovechar unidades descartadas de centros de datos hace falta un adaptador SMX-a-PCIe x16. Hardware Haven consiguió la V100 por USD 100 en eBay y el adaptador por otros USD 100, dejando el conjunto en USD 200. La placa trae 16 GB de HBM2 con 900 GB/s de ancho de banda. El adaptador exige dos conectores PCIe de 8 pines y expone tres headers PWM de 4 pines, pero no incluye un segundo socket SMX para NVLink (las versiones que sí lo permiten son bastante más caras).

Como el formato SMX es esencialmente un disipador atornillado a un PCB sin carcasa, el youtuber diseñó e imprimió en 3D un ducto que canaliza aire desde un ventilador Noctua de 80 mm hacia las aletas. El adaptador no trae cooling propio, así que sin esa pieza la GPU quedaría termalmente expuesta.

¿Cuánto rinde frente a una GPU moderna?

Una vez montada en un sistema Ryzen estándar, la V100 corrió gpt-oss-20b en Ollama a 130 tokens por segundo. Para comparar, la Radeon RX 7800 XT del PC principal del propio youtuber, con los mismos 16 GB de VRAM, alcanzó 90 tokens por segundo. Para descartar diferencias de stack de software (Nvidia mantiene mejor soporte en estos benchmarks), repitió la prueba contra una RTX 3060 de 12 GB con el modelo gemma4:e4b:

- V100: 108 tokens/s consumiendo 293 W.

- RTX 3060 12 GB: 76 tokens/s consumiendo 235 W.

La eficiencia bruta queda en 0,37 tokens/W para la V100 contra 0,33 tokens/W de la 3060. Al limitar ambas placas a 100 W (la V100 viene de fábrica con un techo de 300 W), la brecha crece: la V100 acaba en 170 W para entregar 95 tokens/s, mientras que la 3060 queda en 171 W con 68 tokens/s. Es decir, 0,55 tokens/W contra 0,39 tokens/W: la GPU de 2017 termina siendo 41% más eficiente que la Ampere reciente bajo el mismo techo de consumo.

El punto débil: idle y cargas ligeras

No todo le favorece a la V100. En reposo consume 45 W, contra 35 W de la RTX 3060. Para uso 24/7 esa diferencia se acumula. En la prueba con Frigate NVR (detección de objetos para CCTV) la V100 superó a la 3060 reconociendo al perro del youtuber en mobilenetv2 al instante, donde el Intel N100 mini PC que usaba antes nunca lograba detectarlo. Pero con solo dos cámaras la V100 ya pasaba los 100 W, mientras que el N100 sostenía seis cámaras con apenas 26 W. La conclusión es nítida: la V100 brilla en cargas pesadas y pierde fuerte cuando el trabajo es liviano.

¿Vale la pena comprarla hoy?

La V100 de 16 GB rondaba los USD 100 en eBay antes del video viral; la variante de 32 GB sigue en USD 500. La pieza no tiene salida de video, así que el host del sistema necesita gráficos integrados en su CPU para usar el equipo de manera normal. Tampoco es candidata para gaming: la falta de drivers modernos y la ausencia de display output la dejan estrictamente como acelerador de cómputo. Para quien busque inferencia local de LLMs medianos sin estirar al máximo el presupuesto, la combinación V100 más adaptador SMX queda como una de las opciones más interesantes de 2026, al menos hasta que el efecto viral termine de subir los precios del secundario.