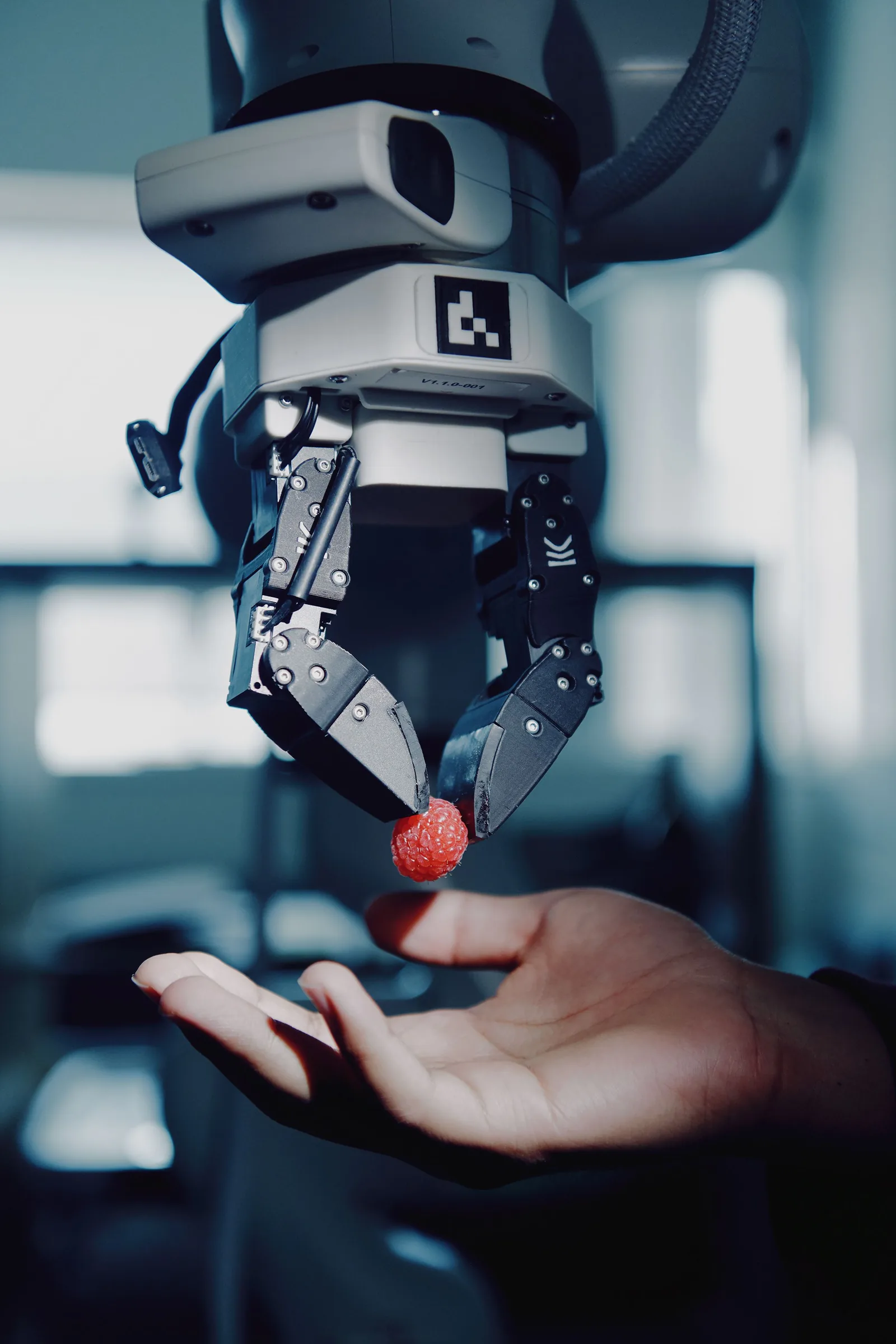

La pinza de un robot se acerca a toda velocidad a una ampolleta apoyada sobre una mesa. Hago una mueca, esperando el crujido. Pero la pinza desacelera de pronto. Empieza a tantear la mesa con suavidad, como si buscara los lentes en la mesita de noche. Posiciona delicadamente la ampolleta entre sus dos pinzas. La ampolleta rueda. La pinza la sigue por la mesa. Tras unos pellizcos, la tiene de vuelta entre sus dedos. El robot la enrosca con precisión en un casquillo cercano e ilumina su zona de trabajo.

En más de una década escribiendo sobre robots, nunca había visto a uno moverse con tanta naturalidad. La mayoría son torpes, incluso cuando los maneja una persona a control remoto. De las pocas docenas de brazos robóticos que existen hoy en el mercado, ni uno solo puede enroscar una ampolleta.

Vine a visitar a Eka, una startup ubicada en Kendall Square, Cambridge, Massachusetts, a unos pasos del MIT y a un trayecto en bici de mi casa. La oficina queda unos pisos arriba de uno de mis restaurantes favoritos, llamado Shy Bird, donde voy seguido a trabajar con mis propias pinzas, escribiendo historias para WIRED.

La oficina es chica y está repleta de brazos robóticos distintos, pinzas y manos surtidas, y mesas cubiertas de objetos raros de distintas formas, tamaños y texturas: guantes, cajitas de tapones para los oídos, cepillos de pelo, llaveros y más.

Pruebo poner algunas cosas debajo del robot. Primero la caja de tapones, después un cepillo y, finalmente, mis llaves desordenadas con un llavero de peluche, en un intento por hacerlo fallar. Cada vez, el robot baja en picada, da unos pellizcos suaves al objeto y lo levanta. Cuando intento sacarle las llaves, resiste un instante, las suelta e inmediatamente vuelve la atención a la mesa, buscando algo más que recoger. Su dedicación al picking impresiona. Y también da un poco de impresión.

Ver al robot de Eka en acción me recuerda la primera vez que probé hablar con ChatGPT. Los robots se mueven de forma tan fluida y natural que no puedo evitar sentir que detrás hay algo genuinamente inteligente, aunque no del todo humano.

Una apuesta por la destreza física

En una sala de conferencias cerca de los robots, los cofundadores de Eka, Pulkit Agrawal, profesor del MIT, y Tuomas Haarnoja, ex investigador de robótica en Google DeepMind, exponen su visión para esta nueva máquina.

"Hace un par de años nos dimos cuenta de que la destreza por fin se puede resolver", dice Agrawal. Las demos de Eka sugieren que el enfoque de la compañía debería habilitar destreza real con más entrenamiento. Si eso se confirma, podría revolucionar el uso de los robots no solo en fábricas y bodegas, sino también en tiendas, restaurantes y hasta hogares.

"Por la mano humana pasan billones de dólares", afirma Agrawal. "Para mí, este es el problema más grande del mundo por resolver".

Los dos creen estar a la mitad del camino. Resolver la destreza, dicen, es ahora cuestión de escalar el enfoque.

El sim-to-real gap, otra vez

Los humanos más rápidos pueden resolver un cubo de Rubik en unos tres segundos. En esos mismos tres segundos, una computadora con un cubo virtual puede resolver miles de variantes del rompecabezas. Como observó famosamente el científico computacional austríaco Hans Moravec a fines de los ochenta, las tareas que parecen más difíciles para un humano son juego de niños para una máquina, mientras que las cosas que un niño hace sin pensar suelen ser un calvario para los robots.

En octubre de 2018, unos cuatro años antes de lanzar ChatGPT, OpenAI creó Dactyl, una mano robótica que después usó IA para resolver un cubo Rubik. La firma tomó una mano de Shadow Robot lista de fábrica y construyó una simulación detallada de sus articulaciones, servos y motores. Con aprendizaje por refuerzo, entrenó una red neuronal para manipular el cubo digital.

OpenAI sugirió en un comunicado que Dactyl había alcanzado "destreza cercana al nivel humano". En la práctica, al robot le faltaban elementos de inteligencia física que damos por hecho. Si el cubo se le empezaba a escapar, no podía recuperarlo. Bajo condiciones perfectas, el único objeto que podía manipular era un cubo Rubik, y ni siquiera era un cubo estándar: tenía sensores que entregaban feedback al sistema.

Unos años después, OpenAI desistió de su trabajo en robótica para enfocarse en grandes modelos de lenguaje y chatbots. Agrawal, que sigue en contacto con miembros de Dactyl, cuenta que el enfoque por simulación se consideraba un camino sin salida por el llamado sim-to-real gap. Pero tanto él como Haarnoja, trabajando en laboratorios distintos, siguieron convencidos de que el gap se podía cerrar haciendo que la simulación se acercara a la realidad.

El modelo visión-fuerza-acción

Agrawal y Haarnoja, que se conocieron como estudiantes de doctorado en UC Berkeley, se asociaron para perseguir en Eka un enfoque distinto al del resto de la industria. En lugar de hacer que humanos provean datos de entrenamiento, la compañía quiere que los robots aprendan a hacer las cosas por sí solos. Pasan miles de horas de cómputo practicando movimientos en mundos simulados e inventando sus propias soluciones. En ese sentido, el bot de Eka se parece más a AlphaZero, el programa de Google DeepMind que aprendió a jugar distintos juegos de tablero con habilidad sobrehumana descubriendo estrategias por su cuenta.

Los fundadores de Eka aseguran que sus robots transfieren el aprendizaje del simulador al mundo real con más confiabilidad que cualquier otro, aunque no quieren explicar exactamente cómo. Agrawal se ve optimista respecto a que su enfoque pueda escalar a capacidades cada vez mayores.

"Algunas personas quieren robots a nivel humano", dice Agrawal. "Para nosotros la meta es sobrehumana".

Agrawal y Haarnoja declinaron dar detalles sobre cómo entrenan a sus robots, ya que es la ventaja comercial de la compañía. Pero sí revelaron que crearon pinzas robóticas a medida que incorporan sentido del tacto. También afirman haber desarrollado un nuevo tipo de algoritmo de IA llamado modelo de visión-fuerza-acción. Este modelo aprende de una simulación que incorpora no solo articulaciones y motores realistas, sino principios físicos como masa e inercia. Aprende tanto cómo el movimiento afecta los píxeles en pantalla como cómo el peso y la velocidad interactúan con los objetos que tiene en su agarre.

Nuggets de pollo y el caso comercial

Quizás la demo más interesante de Eka involucra nuggets de pollo. Los ingenieros montan una estación con nuggets esparcidos sobre una mesa y una correa transportadora con cajas plásticas a un costado. El robot tiene que tomar los nuggets y ponerlos en las cajas. Lo hace con velocidad notable y con improvisación de aspecto humano: a veces los acomoda con cuidado, a veces, si la caja se aleja, casi los lanza desde corta distancia.

El manejo de alimentos sigue dependiendo fuertemente de humanos. Frutas, verduras, carne y otros alimentos requieren manipulación rápida pero suave. Y es difícil de automatizar porque no hay dos piezas de fruta, verdura o nuggets que se vean exactamente iguales.

Las demos de Eka sugieren que la compañía puede estar dando con algo grande. La autora del reportaje termina comparándolas con GPT-1, el primer gran modelo de lenguaje de OpenAI desarrollado cuatro años antes de ChatGPT: incoherente a ratos, pero con destellos de inteligencia general.