Mientras cada laboratorio de IA se apresura a convertirse en una versión de Anthropic (es decir, a concentrarse en codificación e IA empresarial, produciendo mejores PDFs, presentaciones y planillas), sigue siendo refrescante ver que GPT-Image-2 continúa impulsando aplicaciones creativas más audaces.

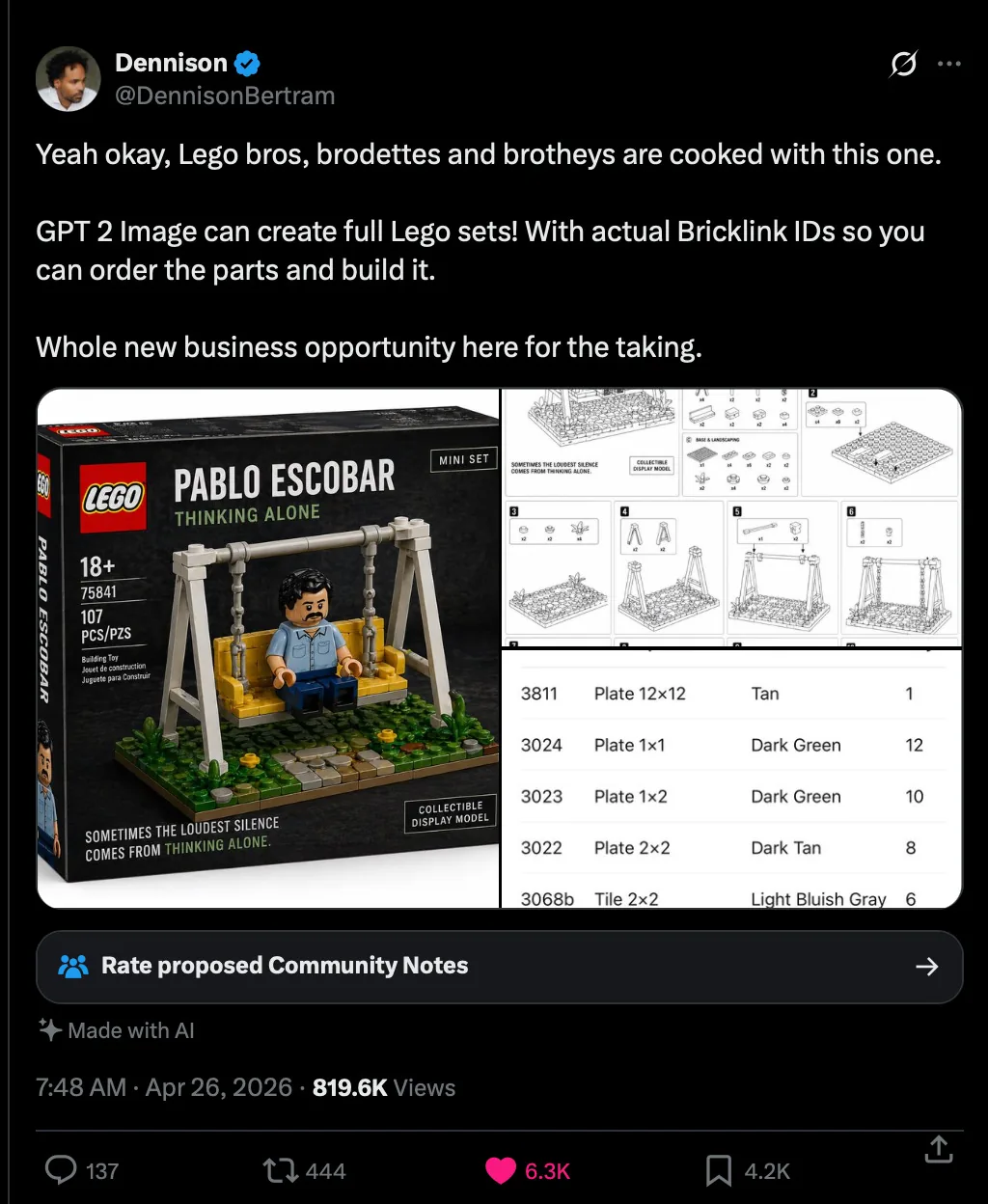

Si tenemos en cuenta el nivel de satisfacción que genera el Lego Rocky Space Friend en una cita romántica, podemos imaginarnos lo que un modelo de razonamiento multimodal con baja alucinación y capacidad de investigación integrada puede llegar a producir.

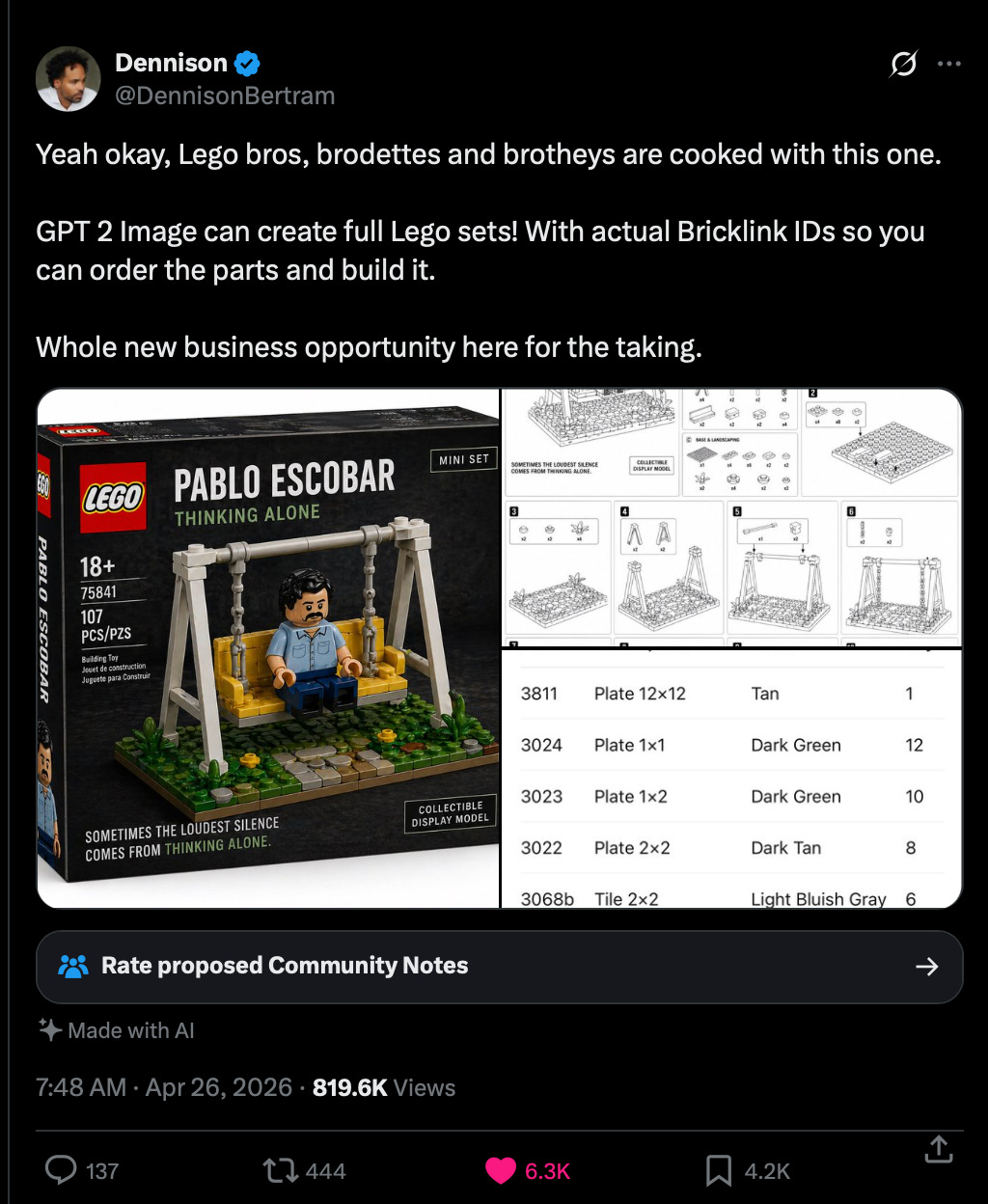

Por supuesto, el modelo es útil para educación:

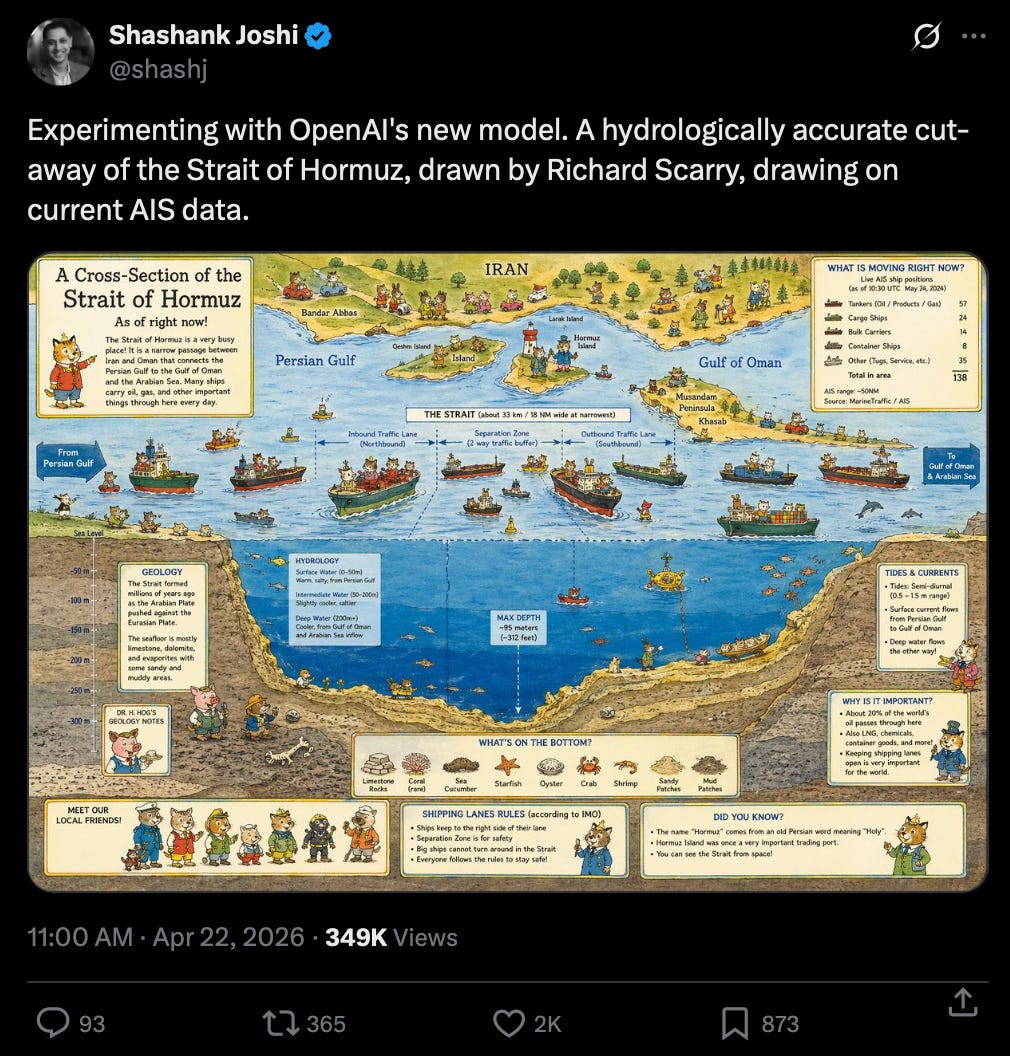

O para generar infografías precisas y limpias:

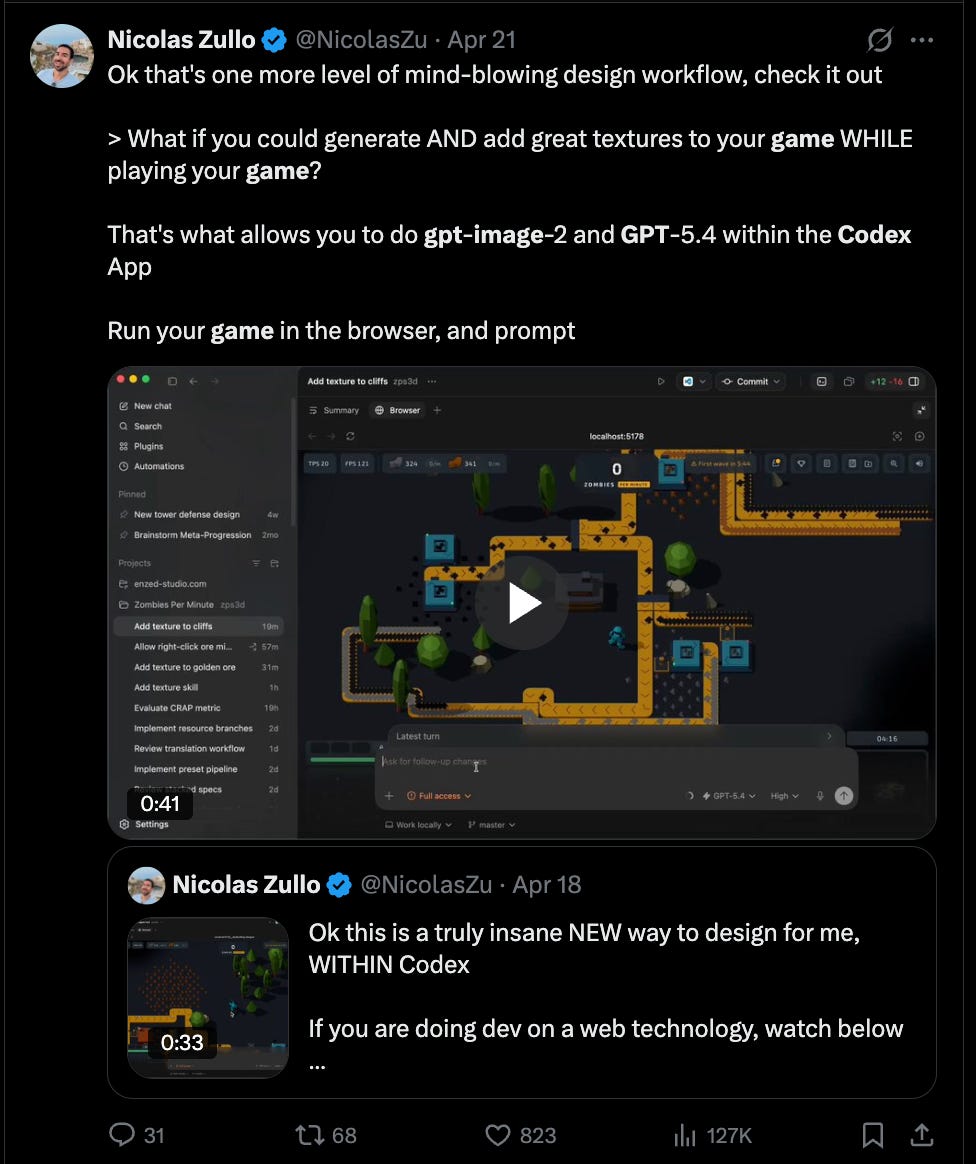

La combinación GPT-Image-2 más Codex, disponible como habilidad dentro de Codex, permite generar recursos visuales de forma iterativa mientras se programa:

La pregunta real no es si GPT-Image-2 es impresionante, sino si los modelos de generación de imágenes como Nano Banana o Grok Imagine justifican el uso de capacidad de GPU escasa cuando el objetivo declarado es la AGI. La respuesta emergente es: sí. No solo por el "cierre del bucle" creativo, sino porque solo puede hacerse tanto con texto, código y salidas estructuradas. Cuando se tiene generación de voz y visión multimodal, incluida transparencia de capas, se activa de verdad la "G" de "AGI": al fin de cuentas, ¿de qué sirve la IA si solo desplaza empleos de programación?

Xiaomi lanza MiMo-V2.5 en código abierto bajo licencia MIT

Uno de los lanzamientos abiertos más relevantes del fin de semana provino de Xiaomi. La empresa liberó MiMo-V2.5-Pro y MiMo-V2.5 bajo licencia MIT, ambos con contexto de 1 millón de tokens. El modelo Pro está orientado a tareas complejas de agentes y codificación, mientras que la versión estándar está diseñada como un agente omnimodal nativo.

Detalles técnicos reportados por la comunidad: MiMo-V2.5-Pro cuenta con aproximadamente 1 billón de parámetros totales con 42B activos, entrenado sobre 27 billones de tokens en FP8, mientras que MiMo-V2.5 es de 310B parámetros totales con 15B activos, entrenado sobre 48 billones de tokens, con atención entrelazada SWA/global agresiva y sin experto compartido. Xiaomi también anunció un subsidio de 100 billones de tokens para desarrolladores. El soporte de inferencia de día 0 llegó rápidamente en vLLM y SGLang.

Sakana AI presenta Conductor: 7B parámetros para orquestar modelos de frontera

Sakana AI Labs presentó un modelo Conductor de 7B parámetros entrenado con aprendizaje por refuerzo para orquestar un conjunto de modelos de frontera en lenguaje natural, sin resolver tareas directamente. El sistema decide de forma dinámica qué agente llamar, qué subtarea asignar y qué contexto exponer, y reportó alcanzar 83,9% en LiveCodeBench y 87,5% en GPQA-Diamond, superando a cualquier modelo individual de su conjunto.

El Conductor representa un nuevo eje de escala en tiempo de inferencia mediante la "IA gestionando IA" y la selección recursiva, según destacaron investigadores de la comunidad.

Kimi K2.6 lidera OpenRouter por segunda semana

Kimi Moonshot confirmó que Kimi K2.6 ocupa el primer lugar en el ranking semanal de OpenRouter. El modelo está orientado a codificación y agentes de largo horizonte, con capacidad de escalar hasta 300 subagentes concurrentes coordinados en 4.000 pasos. Las opiniones de los practicantes están divididas sobre la relación velocidad/calidad: algunos reportan que Kimi en Hermes es notablemente más lento que DeepSeek V4, aunque en ocasiones capaz de resolver errores que V4 no pudo.

GitHub Copilot pasa a facturación por uso desde el 1 de junio

GitHub anunció que Copilot pasará a facturación basada en uso el 1 de junio, un cambio notable a medida que los flujos de trabajo agénticos consumen mucho más tiempo de ejecución. Los multiplicadores de uso documentados son: GPT-5.4 fast = 2x y GPT-5.5 fast = 2,5x, con las variantes mini y GPT-5.3-Codex materialmente más económicas. OpenAI también liberó Symphony, una capa de orquestación que conecta rastreadores de incidencias con agentes Codex para el flujo "issue abierto → agente → PR → revisión humana".