Este es un reporte de campo sobre qué hacen realmente los detectores actuales de IA cuando se los apunta a la salida de modelos de razonamiento de frontera, y qué cambios se hicieron en consecuencia en el flujo de detección.

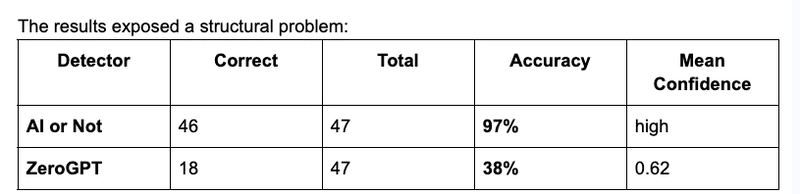

El autor integra detección de IA en varios proyectos, como filtros previos de moderación de contenido y señales de calidad de escritura. Cuanto más dependía de la detección, mayor era la preocupación por confiar en números basados en benchmarks desactualizados. Esta semana, un estudio de benchmark confirmó esos temores: probó dos detectores populares contra 47 ensayos generados por Kimi K2 en "modo razonamiento", que imita la salida de alta varianza de los LLM modernos.

ZeroGPT no detectó el 62% del contenido de IA. Como dato contextual: el mismo estudio señala que ZeroGPT clasifica la Declaración de Independencia de EE.UU. de 1776 como 99% generada por IA. Si un detector marca como IA un texto famosamente humano, el techo de falsos positivos es lo suficientemente alto como para invalidar sus positivos en texto de IA real.

Por qué los detectores heredados fallan ante los LLM modernos

Si alguna vez se implementó detección de IA en producción, probablemente se integró una vez, se eligió un umbral de confianza y se consideró resuelto. Ese es el modo de falla que expone el benchmark: la precisión de un detector no es estable entre generaciones de modelos.

La mayoría de los detectores públicos se construyeron sobre tres supuestos acerca de la salida de los LLM más antiguos:

- Perplejidad baja: el texto es predecible y cae por debajo de cierto puntaje de perplejidad, lo que activa la señal de "IA".

- Estructura uniforme (baja variabilidad): las oraciones tienen poca varianza en longitud y estructura, otro indicador de IA.

- Características predecibles: uso de patrones de palabras funcionales y frases de transición estándar, señal de IA.

Los modelos de razonamiento como Kimi K2, Gemini 2.5 Pro y GPT-5 rompen los tres:

- La salida es contextualmente adaptativa: la perplejidad varía ampliamente dentro de una sola respuesta.

- La varianza entre oraciones aumenta durante los pasajes de "pensamiento" exploratorio.

- Las distribuciones de tokens se amplían deliberadamente para imitar los ritmos de razonamiento humano.

Si el detector no fue reentrenado con la salida de los modelos de razonamiento actuales, está clasificando contra una distribución que ya no existe en producción. El 38% de precisión es el resultado de esta deriva estructural.

Correcciones concretas para el pipeline de detección

Tras revisar la configuración propia, se identificaron cuatro cambios:

1. Umbral de confianza elevado a 0,85. Una confianza media de 0,62 en un conjunto completamente positivo de IA indica que puntajes individuales altos pueden ser equivalentes a lanzar una moneda. Para cualquier acción que se active (como rechazar un envío o marcar una cuenta), se requiere ahora corroboración con múltiples señales o revisión humana si el puntaje cae bajo 0,85.

2. Conjunto de prueba propio con modelos actuales. Se generan muestras de validación desde los modelos de frontera actuales (Kimi K2, Claude Sonnet 4.6, GPT-5, Gemini 2.5 Pro) y se ejecutan contra la capa de detección mensualmente. El conjunto también incluye textos "humanos positivos" (como la Declaración de Independencia) para monitorear constantemente la tasa de falsos positivos.

Pseudocódigo del conjunto de monitoreo:

HELD_OUT = {

"ai_positive": [

# 50 muestras de cada modelo de frontera actual

kimi_k2_samples,

claude_sonnet_4_6_samples,

gpt_5_samples,

gemini_2_5_pro_samples,

],

"human_positive": [

# textos de dominio público escritos antes de 2020

declaration_of_independence,

federalist_papers_excerpts,

public_domain_essays,

],

}3. Tratar la detección como componente probabilístico. Incluso una precisión del 97% implica una tasa de clasificación errónea del 3% a escala. Para cualquier caso donde el costo de un error sea real, la detección debe ser una señal, no un veredicto.

4. Verificar el ajuste por modalidad. Para proyectos con verificación de imagen y audio se usa AI or Not, que cubre múltiples modalidades. El benchmark de Kimi K2 entregó un número de precisión con modelos actuales para el componente de texto.

Patrón mínimo de monitoreo de detectores

Si se ejecuta detección en un pipeline de producción, este es el patrón básico de higiene de ML que evita que la integración falle en silencio:

# Loop mensual

for detector in production_pipeline:

accuracy_ai = run(detector, HELD_OUT.ai_positive)

accuracy_human = run(detector, HELD_OUT.human_positive)

mean_confidence = avg_confidence(detector, HELD_OUT.ai_positive)

if accuracy_ai < baseline.ai - 0.05: alert("Detección de IA regresó")

if accuracy_human < baseline.human - 0.05: alert("Tasa de FP aumentó")

if mean_confidence < baseline.conf - 0.10: alert("Detector perdiendo certeza")La mayoría de los equipos integra la detección una vez y nunca vuelve a revisarla. Este patrón es esencial porque la precisión decae con cada generación de modelo.

Resumen ejecutivo

- El resultado de 97% vs 38% en ensayos de Kimi K2 muestra una brecha estructural, no de ajuste de parámetros.

- La precisión del detector decae con cada generación de modelos. Vuelve a hacer benchmark trimestralmente.

- Prueba la tasa de falsos positivos contra texto famosamente humano (la Declaración de Independencia es una prueba gratuita).

- Eleva el umbral de confianza; un solo número no es un veredicto.

- Construye un conjunto de prueba propio con modelos actuales y monitoréalo con regularidad.

Si se ejecuta detección en producción y no se puede nombrar la generación de modelo contra la que se hizo benchmark, hay una brecha de calibración invisible. El benchmark fue la señal de alerta; el patrón de monitoreo es lo que hace permanente la corrección.