La industria de yacimientos petrolíferos vive un momento crítico en su evolución digital. Durante décadas, desbloquear el potencial de los reservorios dependió de expertos realizando flujos de trabajo manuales esenciales pero intensivos en tiempo.

A medida que crece la complejidad de los datos, la brecha entre la velocidad de las máquinas y el ancho de banda humano se convirtió en el principal cuello de botella. Los flujos de trabajo de simulación bajo demanda están frenados tanto por la carga manual de datos como por la latencia operacional inherente: cuando las simulaciones terminan o fallan durante horas no laborables o mientras los ingenieros manejan prioridades en competencia, se acumula tiempo muerto. Lo que debería ser un proceso estándar de 24 horas se convierte con frecuencia en retrasos de varios días, estancando el progreso de equipos globales.

El giro agéntico

La IA agéntica transforma este escenario al liberar a los ingenieros de los obstáculos técnicos repetitivos, permitiéndoles explorar un espacio de soluciones más amplio y generar mayor valor de los activos. En este paradigma, el ingeniero pasa a un rol supervisor estratégico, mientras los agentes se encargan de la ejecución.

NVIDIA explica en su blog de desarrolladores cómo construir este tipo de sistema. Aunque los ejemplos se centran en simulación de reservorios, el marco es agnóstico respecto a la herramienta y aplicable a cualquier industria que dependa de flujos complejos de simulación.

La arquitectura integra un agente central de orquestación con agentes especializados diseñados para la interacción con el simulador y la gestión del flujo de trabajo.

El asistente de simulación de reservorios

El asistente de simulación actúa como un experto digital de dominio que conecta al ingeniero, la documentación técnica y el simulador. Funciona como una vía rápida complementaria que maneja tareas repetitivas y obstáculos técnicos. Sus capacidades principales son:

- Interacción instantánea: Reemplaza la búsqueda tediosa en menús anidados con resultados inmediatos. Desde lanzar una corrida arrastrando un deck de simulación al chat hasta preguntar "¿cuál es el factor de skin para el Pozo-X?", el sistema maneja las búsquedas manuales y configuraciones en segundos.

- Análisis rápido: Va más allá de graficar curvas temporales para ofrecer diagnósticos inmediatos. Puede responder preguntas complejas como "¿por qué veo una irrupción temprana de agua en el Pozo-X?", lo que normalmente requeriría horas de referencias cruzadas manuales.

- Iteración "what-if" sin fricción: Permite pruebas ágiles de escenarios sin los dolores de cabeza de la sintaxis. El agente maneja la edición tediosa de palabras clave y las comparaciones con la línea base, con lógica de autocorrección que detecta y repara proactivamente problemas de convergencia y errores de entrada para mantener las simulaciones corriendo las 24 horas.

Equipos multiagente para estudios complejos

Mientras el asistente de simulación mejora las tareas diarias, los flujos de trabajo más complejos como el ajuste histórico y la optimización del desarrollo de campo son los principales generadores de tiempo muerto. Estos estudios requieren una "pausa heurística": tras cada ciclo, un experto debe sintetizar manualmente datos de alta dimensión para decidir cómo ajustar los parámetros para la siguiente corrida. Este nivel de expertise suele demandar años de experiencia o recurrir a consultoras externas, donde esos recursos especializados son escasos por naturaleza.

Para resolver esto, se implementa un equipo multiagente que imita a un grupo especializado de ingenieros de reservorios, utilizando un conjunto de ingenieros junior digitales para realizar y monitorear trabajos de optimización a alta escala. El sistema garantiza que apenas termine un ciclo, los datos se sinteticen, se propongan los siguientes parámetros y se lance la siguiente corrida de inmediato, eliminando el tiempo muerto entre iteraciones.

Principios clave del flujo agéntico

- Humano en el bucle (HITL): A pesar del alto nivel de autonomía, los ingenieros mantienen control supervisor total. Revisan y aprueban los planes propuestos por los agentes antes de lanzar flujos de trabajo con cientos de trabajos de simulación.

- Ecosistemas de confianza: Los agentes utilizan software de simulación y orquestación estándar de la industria. Aceleran la entrega no reemplazando la física, sino eliminando las tareas manuales y repetitivas que causan cuellos de botella.

- Agnóstico y preparado para el futuro: Aunque la implementación usa OPM Flow y código Python propio, el marco está diseñado para ser modular, permitiendo integración con simuladores comerciales estándar o bases de código propietarias.

Caso de estudio: optimización de ubicación de pozos

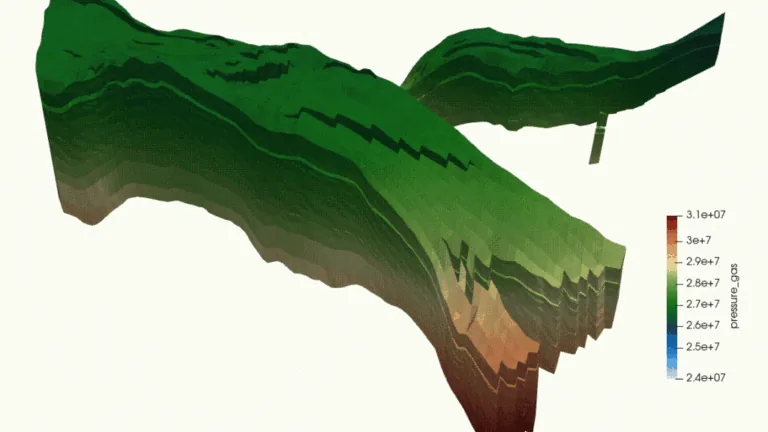

Para demostrar el sistema en acción, el equipo multiagente se aplicó a la optimización de ubicación de pozos en el modelo de referencia Brugge, maximizando el valor presente neto (VPN) mediante la optimización de la ubicación de 30 pozos.

- Planificación colaborativa: Un agente proponedor sugiere estrategias de optimización, mientras un agente crítico las refina mediante un bucle de debate.

- Orquestación dinámica: Los agentes ajustan los parámetros de ajuste en tiempo real basándose en métricas de rendimiento y conocimiento del dominio.

- Estabilidad operacional: Un gestor de trabajos monitorea la salud del sistema para eliminar el tiempo muerto por fallos inesperados.

- Síntesis de datos automatizada: Un analista de resultados traduce los datos crudos de alta dimensión en información accionable.

Infraestructura: NVIDIA Inference Microservices

La inteligencia que impulsa estos agentes se basa en NVIDIA Inference Microservices (NIM), que proporciona la inferencia de baja latencia y lista para producción necesaria para el razonamiento de ingeniería en tiempo real:

- Razonamiento avanzado: Los agentes usan Llama-3.3-Nemotron-Super-49B-v1.5, diseñado para razonamiento complejo, planificación y flujos agénticos de múltiples turnos.

- Inteligencia contextual: La generación aumentada por recuperación (RAG) está habilitada por Llama-3.2-NeMo-Retriever-300M-Embed-v2, asegurando que las respuestas se basen en documentación técnica propietaria.

- Arquitectura modular: El sistema integra ChatNVIDIA, la interfaz compatible con LangChain, para orquestación estructurada con LangGraph.

El código del sistema está disponible en el repositorio abierto en GitHub, donde la comunidad puede acceder al flujo de trabajo de múltiples agentes de extremo a extremo y personalizarlo para casos de uso específicos.