Con BioMysteryBench, Anthropic busca demostrar que Claude resuelve problemas reales de bioinformática a nivel experto. Los resultados son prometedores, pero vienen con matices importantes.

Medir qué tan bien rinden los modelos de IA en investigación biológica es difícil. Según Anthropic, los benchmarks existentes tienen puntos ciegos: pruebas de conocimiento como MMLU-Pro o GPQA revisan conocimiento factual pero no habilidades prácticas de investigación. Otros como BixBench, que usan datasets reales, evalúan al modelo contra las conclusiones de científicos individuales, conclusiones que de por sí son subjetivas y dependen de decisiones metodológicas. Y entornos de laboratorio simulados como SciGym tienen respuestas claras, pero no capturan la suciedad inherente de los datos biológicos reales.

¿Qué hace distinto a BioMysteryBench?

Por ese motivo Anthropic desarrolló BioMysteryBench: 99 preguntas que cubren múltiples dominios de bioinformática, escritas por especialistas y basadas en datasets reales con ruido. La clave del diseño está en que las respuestas no se derivan de interpretaciones científicas, sino de propiedades controlables y objetivamente verificables de los datos, o de metadata validada de forma independiente.

Cada autor de pregunta debió entregar un notebook de validación que demostrara que la señal realmente existe en los datos. Este enfoque permite además formular preguntas que ningún humano logra resolver con seguridad.

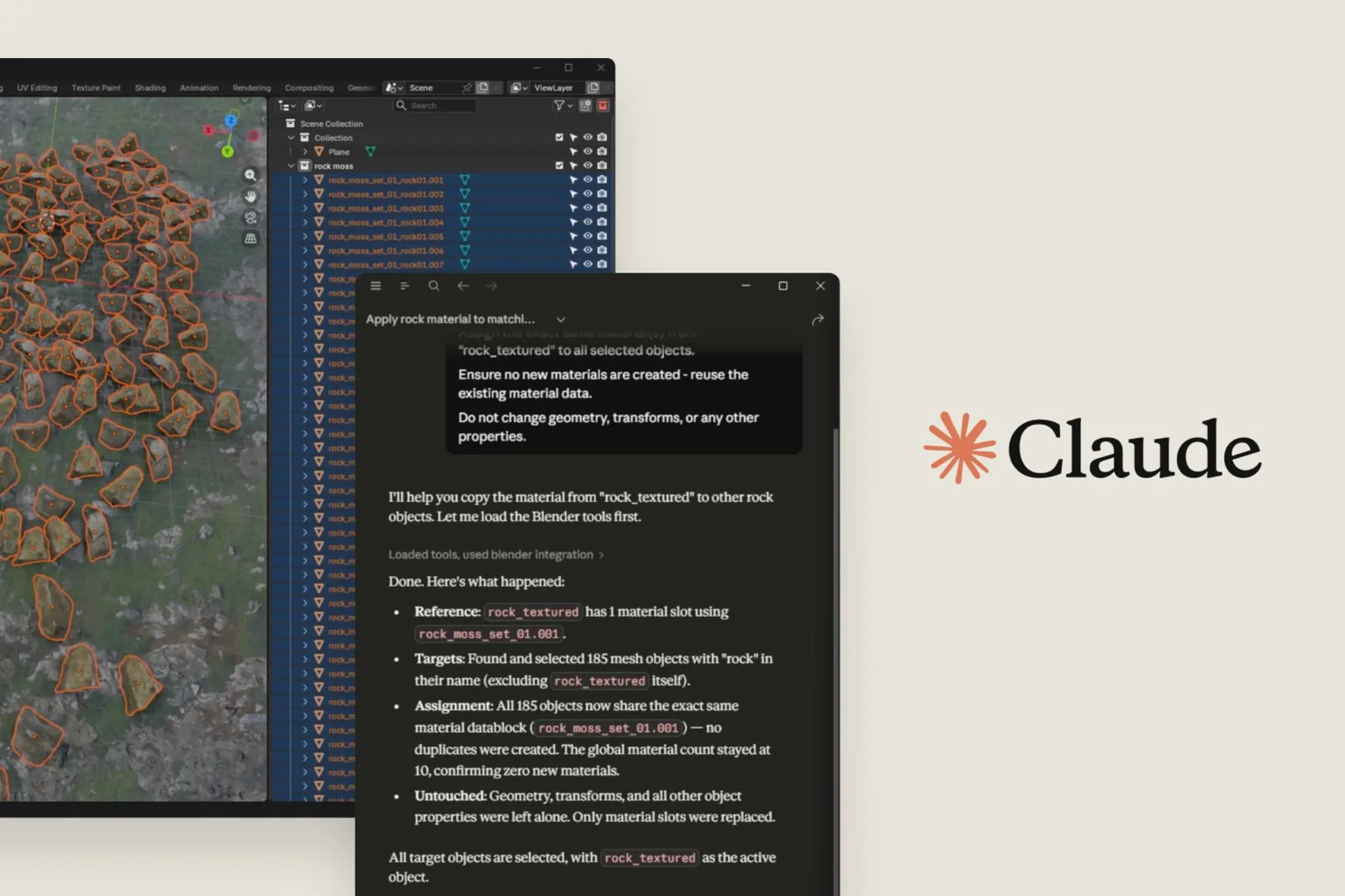

Tareas típicas incluyen identificar de qué órgano proviene un dataset de RNA-seq de célula única, o averiguar qué gen fue noqueado en muestras experimentales. A Claude se le entrega un contenedor con herramientas de bioinformática, acceso a bases de datos como NCBI y Ensembl, y libertad total para elegir sus métodos de análisis. Solo se evalúa la respuesta final, no el camino para llegar a ella.

¿Qué tan bien rinde Claude en problemas resolubles?

Anthropic dividió las tareas en dos grupos. 76 se consideraron "resolubles por humanos" porque al menos uno de hasta cinco expertos consultados entregó la respuesta correcta. Otras 23 dejaron a todos los expertos sin respuesta. Cuatro preguntas originalmente planeadas tuvieron que retirarse por formulaciones defectuosas. Sobre las 23 difíciles, Anthropic admite que no está claro si son fundamentalmente irresolubles o solo extremadamente difíciles, y queda abierta la pregunta de si un panel mayor o distinto habría logrado resolverlas.

En los problemas resolubles, Claude ya iguala el desempeño de los expertos humanos, según Anthropic.

En los problemas duros que ningún experto seleccionado pudo resolver, Claude Mythos Preview consigue una tasa de éxito de 30%.

¿Cómo se ve la consistencia entre intentos?

Sin embargo, un análisis de consistencia que Anthropic le hizo correr al propio Claude Mythos Preview ofrece una imagen más matizada. Cada tarea se intentó cinco veces. En los problemas resolubles, Claude casi siempre acierta las cinco veces o falla las cinco. En los problemas difíciles, los aciertos suelen aparecer en solo uno o dos intentos de los cinco. El modelo tropieza con una solución afortunada en lugar de seguir una estrategia reproducible.

Anthropic identifica dos estrategias que distinguen a Claude de los testers humanos: el modelo se apoya en una base de conocimiento amplia y combina información directamente con su análisis en curso. Cuando hay incertidumbre, Claude además superpone varios métodos y escoge la respuesta en la que distintos enfoques convergen.

¿Qué dice la confirmación independiente?

Una confirmación independiente proviene de CompBioBench, un benchmark con diseño similar desarrollado en paralelo por Genentech y Roche, que muestra resultados comparables. BioMysteryBench está disponible en Hugging Face.

Lectura desde Latinoamérica

Para los grupos de bioinformática chilenos y latinoamericanos, especialmente los que trabajan en genómica de cáncer en Fundación Ciencia & Vida, el INTA o las redes asociadas al programa Iniciativa Genómica para Chile, BioMysteryBench abre una pregunta concreta: ¿en qué tipo de pipeline tiene sentido sumar un agente de IA con acceso a NCBI y Ensembl, antes de un revisor humano experto? El 82.6% de Claude Mythos Preview no significa que pueda firmar un análisis. Significa que en tareas bien acotadas (identificar tejido de origen, gen noqueado, perfil celular) puede ser un primer pase razonable, liberando a los pocos bioinformáticos seniors disponibles para el subconjunto realmente difícil.

La advertencia editorial es la consistencia: si en problemas duros el éxito aparece en uno o dos de cinco intentos, agregar a Claude al pipeline exige al menos correr cada análisis varias veces y solo confiar en respuestas convergentes. Es trabajo extra, pero alcanzable a costo bajo si se compara con el costo de no hacer ese análisis del todo.