La revolución de la codificación asistida por inteligencia artificial viene con un inconveniente importante: es costosa.

Claude Code, el agente de IA basado en terminal de Anthropic que puede escribir, depurar y desplegar código de forma autónoma, ha capturado la imaginación de los desarrolladores de software en todo el mundo. Sin embargo, su esquema de precios —que oscila entre los $20 y los $200 dólares mensuales dependiendo del uso— ha desatado una creciente rebelión entre los mismos programadores a los que pretende servir.

Ahora, una alternativa gratuita está ganando terreno. Goose, un agente de IA de código abierto desarrollado por Block (la compañía de tecnología financiera anteriormente conocida como Square), ofrece una funcionalidad casi idéntica a Claude Code, pero se ejecuta íntegramente en la máquina local del usuario. Sin cuotas de suscripción. Sin dependencia de la nube. Sin límites de tasa de uso que se reinician cada cinco horas.

"Tus datos se quedan contigo, punto final", afirmó Parth Sareen, un ingeniero de software que demostró la herramienta durante una transmisión reciente. El comentario captura el atractivo central: Goose otorga a los desarrolladores un control total sobre su flujo de trabajo impulsado por IA, incluyendo la capacidad de trabajar sin conexión, incluso en un avión.

El proyecto ha explotado en popularidad. Goose cuenta ahora con más de 26,100 estrellas en GitHub, la plataforma para compartir código, con 362 colaboradores y 102 lanzamientos desde su inicio. La versión más reciente, 1.20.1, fue enviada el 19 de enero de 2026, reflejando un ritmo de desarrollo que compite con los productos comerciales.

Para los desarrolladores frustrados por la estructura de precios de Claude Code y sus topes de uso, Goose representa algo cada vez más raro en la industria de la IA: una opción genuinamente gratuita y sin ataduras para el trabajo serio.

Los nuevos límites de Anthropic provocan una revuelta de desarrolladores

Para entender por qué Goose es importante, es necesario comprender la controversia por los precios de Claude Code.

Anthropic, la empresa de inteligencia artificial de San Francisco fundada por exejecutivos de OpenAI, ofrece Claude Code como parte de sus niveles de suscripción. El plan gratuito no ofrece acceso de ningún tipo. El plan Pro, de $17 dólares al mes con facturación anual (o $20 mensuales), limita a los usuarios a solo 10 o 40 prompts cada cinco horas, una restricción que los desarrolladores serios agotan en cuestión de minutos durante un trabajo intensivo.

Los planes Max, de $100 y $200 dólares al mes, ofrecen más margen de maniobra: de 50 a 200 prompts y de 200 a 800 prompts respectivamente, además del acceso al modelo más potente de Anthropic, Claude 4.5 Opus. Pero incluso estos niveles premium vienen con restricciones que han enfurecido a la comunidad de desarrollo.

A finales de julio, Anthropic anunció nuevos límites de tasa semanales. Bajo este sistema, los usuarios Pro reciben de 40 a 80 horas de uso de Sonnet 4 por semana. Los usuarios Max en el nivel de $200 obtienen de 240 a 480 horas de Sonnet 4, más 24 a 40 horas de Opus 4. Casi cinco meses después, la frustración no ha disminuido.

¿El problema? Esas "horas" no son horas reales. Representan límites basados en tokens que varían drásticamente según el tamaño de la base de código, la longitud de la conversación y la complejidad del código que se está procesando. Análisis independientes sugieren que los límites reales por sesión se traducen en aproximadamente 44,000 tokens para usuarios Pro y 220,000 tokens para el plan Max de $200.

"Es confuso y vago", escribió un desarrollador en un análisis ampliamente compartido. "Cuando dicen '24-40 horas de Opus 4', eso realmente no te dice nada útil sobre lo que estás obteniendo de verdad".

La reacción en Reddit y en foros de desarrolladores ha sido feroz. Algunos usuarios informan haber alcanzado sus límites diarios a los 30 minutos de codificación intensiva. Otros han cancelado sus suscripciones por completo, calificando las nuevas restricciones como "una broma" e "inutilizables para el trabajo real".

Anthropic ha defendido los cambios, afirmando que los límites afectan a menos del cinco por ciento de los usuarios y se dirigen a personas que ejecutan Claude Code "continuamente en segundo plano, las 24 horas del día, los 7 días de la semana". Sin embargo, la empresa no ha aclarado si esa cifra se refiere al cinco por ciento de los suscriptores Max o al cinco por ciento de todos los usuarios, una distinción que importa enormemente.

Cómo Block construyó un agente de programación por IA gratuito que funciona offline

Goose adopta un enfoque radicalmente diferente para el mismo problema.

Construido por Block, la empresa de pagos liderada por Jack Dorsey, Goose es lo que los ingenieros llaman un "agente de IA en la máquina". A diferencia de Claude Code, que envía tus consultas a los servidores de Anthropic para su procesamiento, Goose puede ejecutarse completamente en tu computador local utilizando modelos de lenguaje de código abierto que tú mismo descargas y controlas.

La documentación del proyecto lo describe como algo que va "más allá de las sugerencias de código" para "instalar, ejecutar, editar y probar con cualquier LLM". Esa última frase —"cualquier LLM"— es el diferenciador clave. Goose es agnóstico al modelo por diseño.

Puedes conectar Goose a los modelos Claude de Anthropic si tienes acceso a la API. Puedes usar GPT-5 de OpenAI o Gemini de Google. Puedes enrutarlo a través de servicios como Groq o OpenRouter. O —y aquí es donde las cosas se ponen interesantes— puedes ejecutarlo de forma totalmente local utilizando herramientas como Ollama, que te permiten descargar y ejecutar modelos de código abierto en tu propio hardware.

Las implicaciones prácticas son significativas. Con una configuración local, no hay cuotas de suscripción, ni topes de uso, ni límites de tasa, ni preocupaciones de que tu código sea enviado a servidores externos. Tus conversaciones con la IA nunca salen de tu máquina.

"Uso Ollama todo el tiempo en los aviones; ¡es muy divertido!", señaló Sareen durante una demostración, destacando cómo los modelos locales liberan a los desarrolladores de las limitaciones de la conectividad a internet.

Lo que Goose puede hacer y los asistentes de código tradicionales no

Goose opera como una herramienta de línea de comandos o una aplicación de escritorio que puede realizar de forma autónoma tareas de desarrollo complejas. Puede construir proyectos enteros desde cero, escribir y ejecutar código, depurar fallos, orquestar flujos de trabajo en múltiples archivos e interactuar con APIs externas, todo sin supervisión humana constante.

La arquitectura se basa en lo que la industria de la IA llama "tool calling" o "function calling": la capacidad de un modelo de lenguaje para solicitar acciones específicas de sistemas externos. Cuando le pides a Goose que cree un nuevo archivo, ejecute una suite de pruebas o verifique el estado de un pull request en GitHub, no solo genera texto describiendo lo que debería suceder. Realmente ejecuta esas operaciones.

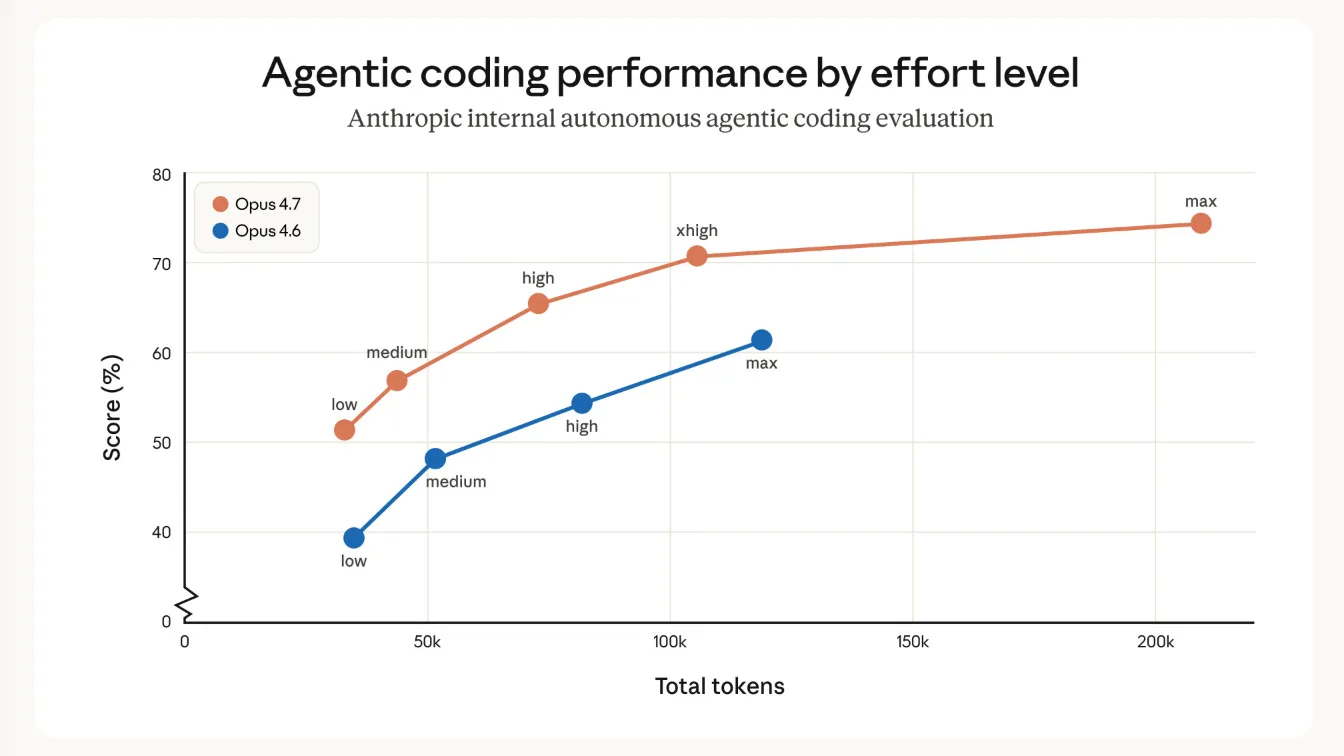

Esta capacidad depende en gran medida del modelo de lenguaje subyacente. Los modelos Claude 4 de Anthropic actualmente tienen el mejor desempeño en tool calling, según el Berkeley Function-Calling Leaderboard, que clasifica a los modelos según su capacidad para traducir solicitudes en lenguaje natural en código ejecutable y comandos del sistema.

Pero los nuevos modelos de código abierto se están poniendo al día rápidamente. La documentación de Goose destaca varias opciones con un sólido soporte para tool calling: la serie Llama de Meta, los modelos Qwen de Alibaba, las variantes Gemma de Google y las arquitecturas enfocadas en razonamiento de DeepSeek.

La herramienta también se integra con el Model Context Protocol, o MCP, un estándar emergente para conectar agentes de IA a servicios externos. A través de MCP, Goose puede acceder a bases de datos, motores de búsqueda, sistemas de archivos y APIs de terceros, extendiendo sus capacidades mucho más allá de lo que proporciona el modelo de lenguaje base.

Configuración de Goose con un modelo local

Para los desarrolladores interesados en una configuración completamente gratuita y que preserve la privacidad, el proceso involucra tres componentes principales: el propio Goose, Ollama (una herramienta para ejecutar modelos de código abierto localmente) y un modelo de lenguaje compatible.

Paso 1: Instalar Ollama

Ollama es un proyecto de código abierto que simplifica drásticamente el proceso de ejecutar grandes modelos de lenguaje en hardware personal. Maneja el complejo trabajo de descargar, optimizar y servir modelos a través de una interfaz sencilla.

Descarga e instala Ollama desde ollama.com. Una vez instalado, puedes obtener modelos con un solo comando. Para tareas de programación, Qwen 2.5 ofrece un fuerte soporte para tool calling.

El modelo se descarga automáticamente y comienza a ejecutarse en tu máquina.

Paso 2: Instalar Goose

Goose está disponible tanto como aplicación de escritorio como interfaz de línea de comandos (CLI). La versión de escritorio ofrece una experiencia más visual, mientras que la CLI atrae a los desarrolladores que prefieren trabajar íntegramente en la terminal.

Las instrucciones de instalación varían según el sistema operativo, pero generalmente implican la descarga desde la página de lanzamientos en GitHub de Goose o el uso de un gestor de paquetes. Block proporciona binarios precompilados para macOS (tanto Intel como Apple Silicon), Windows y Linux.

Paso 3: Configurar la conexión

En Goose Desktop, navega a Settings, luego a Configure Provider y selecciona Ollama. Confirma que el API Host esté configurado en http://localhost:11434 (el puerto predeterminado de Ollama) y haz clic en Submit.

Para la versión de línea de comandos, ejecuta goose configure, selecciona "Configure Providers", elige Ollama e ingresa el nombre del modelo cuando se te solicite.

Eso es todo. Goose ahora está conectado a un modelo de lenguaje que se ejecuta íntegramente en tu hardware, listo para ejecutar tareas de programación complejas sin cuotas de suscripción ni dependencias externas.

Memoria RAM, potencia de procesamiento y compensaciones que debes conocer

La pregunta obvia es: ¿qué tipo de computador necesitas?

Ejecutar grandes modelos de lenguaje localmente requiere sustancialmente más recursos computacionales que el software típico. La restricción clave es la memoria, específicamente la RAM en la mayoría de los sistemas, o la VRAM si se utiliza una tarjeta gráfica dedicada para la aceleración.

La documentación de Block sugiere que 32 gigabytes de RAM proporcionan "una base sólida para modelos y resultados más grandes". Para los usuarios de Mac, esto significa que la memoria unificada del computador es el principal cuello de botella. Para los usuarios de Windows y Linux con tarjetas gráficas NVIDIA discretas, la memoria de la GPU (VRAM) es más importante para la aceleración.

Vía VentureBeat AI.