NVIDIA y Google Cloud han colaborado por más de una década, co-diseñando una plataforma de IA de stack completo que abarca cada capa tecnológica, desde bibliotecas y frameworks optimizados para el rendimiento hasta servicios en la nube de grado empresarial.

Esta base permite a desarrolladores, startups y empresas llevar la IA agéntica y física fuera del laboratorio y hacia la producción, desde agentes que gestionan flujos de trabajo complejos hasta robots y gemelos digitales en el piso de la fábrica.

En Google Cloud Next esta semana en Las Vegas, la asociación alcanza un nuevo hito, con avances para expandir Google Cloud AI Hypercomputer para fábricas de IA que impulsarán la próxima frontera de la IA agéntica y física.

Estos incluyen las nuevas instancias bare-metal A5X potenciadas por NVIDIA Vera Rubin; una vista previa (preview) de Google Gemini en Google Distributed Cloud ejecutándose en NVIDIA Blackwell y GPUs NVIDIA Blackwell Ultra; VMs confidenciales con GPUs NVIDIA Blackwell; e IA agéntica en Gemini Enterprise Agent Platform con modelos abiertos NVIDIA Nemotron y el framework NVIDIA NeMo.

Infraestructura de próxima generación: De NVIDIA Blackwell a Vera Rubin

En Google Cloud Next, Google anunció A5X potenciado por los sistemas a escala de rack NVIDIA Vera Rubin NVL72, los cuales — a través de un co-diseño extremo entre chips, sistemas y software — ofrecen un costo de inferencia por token hasta 10 veces menor y un rendimiento de tokens por megavatio 10 veces mayor que la generación anterior.

A5X utilizará NVIDIA ConnectX-9 SuperNICs, combinados con la red Google Virgo de próxima generación, escalando hasta 80,000 GPUs NVIDIA Rubin dentro de un clúster de sitio único y hasta 960,000 GPUs NVIDIA Rubin en un clúster de múltiples sitios, permitiendo a los clientes ejecutar sus cargas de trabajo de IA más grandes en infraestructura optimizada por NVIDIA.

“En Google Cloud, creemos que la próxima década de la IA estará definida por la capacidad de los clientes para ejecutar sus cargas de trabajo más exigentes en un stack de infraestructura verdaderamente integrado y optimizado para la IA”, afirmó Mark Lohmeyer, vicepresidente y gerente general de infraestructura de cómputo e IA en Google Cloud. “Al combinar la infraestructura escalable y los servicios de IA gestionados de Google Cloud con las plataformas, sistemas y software líderes de la industria de NVIDIA, estamos brindando a los clientes la flexibilidad para entrenar, ajustar y servir desde modelos de frontera y abiertos hasta cargas de trabajo de IA agéntica y física, optimizando al mismo tiempo el rendimiento, el costo y la sostenibilidad”.

El amplio portafolio de NVIDIA Blackwell en Google Cloud abarca desde VMs A4 con sistemas NVIDIA HGX B200 hasta VMs A4X a escala de rack con NVIDIA GB200 NVL72 y sistemas A4X Max NVIDIA GB300 NVL72, llegando incluso a VMs G4 fraccionadas con GPUs NVIDIA RTX PRO 6000 Blackwell Server Edition.

Los clientes pueden dimensionar correctamente sus capacidades de aceleración, ya sea utilizando múltiples racks NVL72 interconectados que escalan a decenas de miles de GPUs NVIDIA Blackwell, un solo rack que puede escalar hasta 72 GPUs Blackwell con NVIDIA NVLink de quinta generación y NVLink 5 Switch, o simplemente un octavo de una GPU.

Esta plataforma integral ayuda a los equipos a optimizar cada carga de trabajo, desde el razonamiento de mixture-of-experts, la inferencia multimodal y el procesamiento de datos hasta simulaciones complejas para la próxima frontera de la IA física y la robótica.

Laboratorios de IA de frontera líderes ya están poniendo esta infraestructura a trabajar. Thinking Machines Lab está escalando su interfaz de programación de aplicaciones (API) Tinker en VMs A4X Max con sistemas GB300 NVL72 para acelerar el entrenamiento, mientras que OpenAI está ejecutando inferencia a gran escala en sistemas NVIDIA GB300 (VMs A4X Max) y GB200 NVL72 (VMs A4X) en Google Cloud para algunas de sus cargas de trabajo de inferencia más exigentes, incluyendo ChatGPT.

IA segura donde sea que necesite ejecutarse: Soberana y Confidencial

Los modelos Google Gemini que se ejecutan en GPUs NVIDIA Blackwell y Blackwell Ultra ahora están en vista previa en Google Distributed Cloud, para que los clientes puedan llevar los modelos de frontera de Google a donde residan sus datos más sensibles.

La Computación Confidencial de NVIDIA con la plataforma NVIDIA Blackwell permite que los modelos Gemini se ejecuten en un entorno protegido donde los prompts y los datos de fine-tuning permanecen cifrados y no pueden ser vistos ni alterados por partes no autorizadas, incluidos los operadores de la infraestructura.

En la nube pública, la vista previa de las VMs G4 Confidenciales con GPUs NVIDIA RTX PRO 6000 Blackwell lleva estas protecciones a entornos multi-tenant, ayudando a salvaguardar prompts, modelos de IA y datos para que los clientes en industrias reguladas puedan acceder al poder de la IA sin comprometer la seguridad o el rendimiento.

Esta es la primera oferta de computación confidencial de GPUs NVIDIA Blackwell en la nube, brindando a los clientes de Google Cloud una nueva base para una IA segura y de alto rendimiento.

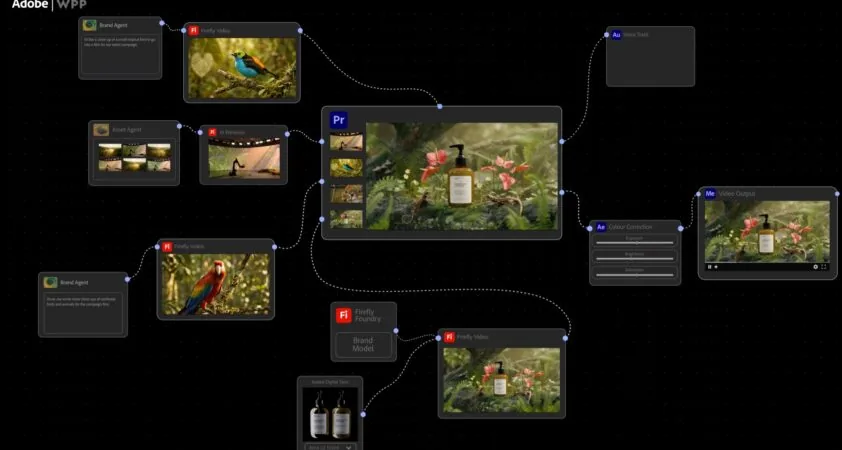

Modelos abiertos y APIs para IA agéntica

La plataforma NVIDIA en Google Cloud está optimizada para ejecutar todo tipo de modelos, desde las familias de frontera Gemini y Gemma de Google hasta los modelos abiertos NVIDIA Nemotron y el ecosistema más amplio de pesos abiertos (open weights), equipando a los desarrolladores para construir sistemas de IA agéntica que razonan, planifican y actúan.

NVIDIA Nemotron 3 Super está disponible en Gemini Enterprise Agent Platform, brindando a los desarrolladores un camino directo para descubrir, personalizar y desplegar modelos de razonamiento y multimodales optimizados por NVIDIA para flujos de trabajo agénticos.

Google Cloud y NVIDIA también están facilitando el entrenamiento y la personalización de modelos abiertos a escala. Los Managed Training Clusters en Gemini Enterprise Agent Platform introdujeron una nueva API de aprendizaje por refuerzo (RL) gestionada, construida con NVIDIA NeMo RL para acelerar el entrenamiento de RL a escala mientras se automatiza el dimensionamiento de clústeres, la recuperación de fallas y la ejecución de trabajos, de modo que los equipos puedan enfocarse en el comportamiento del agente y la calidad del modelo en lugar de la gestión de la infraestructura.

El líder en ciberseguridad CrowdStrike utiliza bibliotecas abiertas de NVIDIA NeMo como NeMo Data Designer, NeMo Automodel y NeMo Megatron Bridge para generar datos sintéticos y realizar el fine-tuning de Nemotron y otros grandes modelos de lenguaje (LLM) abiertos para ciberseguridad específica de dominio. Al ejecutarse en Managed Training Clusters en Gemini Enterprise Agent Platform con GPUs NVIDIA Blackwell, estas capacidades aceleran la detección, investigación y respuesta ante amenazas.

Construyendo el futuro de la IA industrial y física

Construir IA industrial y física a escala exige un hardware potente y una combinación de modelos abiertos, bibliotecas y frameworks para desarrollar estos complejos flujos de trabajo de extremo a extremo.

La infraestructura de IA de NVIDIA, los modelos abiertos y las bibliotecas de IA física disponibles en Google Cloud están masificando las aplicaciones de IA industrial y física, permitiendo a los clientes simular, optimizar y automatizar flujos de trabajo del mundo real.

Soluciones de proveedores líderes de software industrial, incluidos Cadence y Siemens Digital Industries Software, ahora están disponibles en Google Cloud, aceleradas en la infraestructura de IA de NVIDIA. Estas aplicaciones están impulsando el diseño, la ingeniería y la fabricación de próxima generación de todo, desde chips hasta vehículos autónomos, robótica, plataformas aeroespaciales, maquinaria pesada y sistemas de producción a gran escala.

Con las bibliotecas de NVIDIA Omniverse y el framework de simulación robótica de código abierto NVIDIA Isaac Sim disponibles en Google Cloud Marketplace, los desarrolladores pueden construir gemelos digitales físicamente precisos y desarrollar pipelines de simulación robótica personalizados para entrenar, simular y validar robots antes de su despliegue en el mundo real.

Los microservicios NVIDIA NIM para modelos como NVIDIA Cosmos Reason 2 pueden desplegarse en Google Vertex AI y Google Kubernetes Engine. Esto permite que los robots y los agentes de IA de visión vean, razonen y actúen en el mundo físico como humanos, potenciando casos de uso como la curación y anotación automatizada de datos, la planificación y razonamiento avanzado de robots, y agentes de análisis de video inteligentes para obtener información y tomar decisiones en tiempo real.

Juntas, estas tecnologías ayudan a los desarrolladores a pasar sin problemas del diseño asistido por computadora a gemelos digitales industriales vivos y robots impulsados por IA, acelerando los procesos desde la aprobación del diseño hasta la optimización de la fábrica en la plataforma NVIDIA ejecutándose en Google Cloud.

Impacto comprobado: Desde startups hasta empresas globales

Empresas globales, laboratorios de IA y startups de alto crecimiento están utilizando la plataforma co-diseñada por NVIDIA y Google Cloud para pasar del prototipado a la producción más rápido, incluyendo a Snap, Schrödinger y Salesforce. Snap está reduciendo el costo de las pruebas A/B a gran escala al trasladar los pipelines de datos a Spark acelerado por GPU en Google Cloud. Schrödinger está reduciendo simulaciones de descubrimiento de fármacos que duraban semanas a solo horas con la computación acelerada de NVIDIA en Google Cloud.

Las startups están orquestando la próxima ola de innovación en IA, construyendo nuevos agentes y aplicaciones nativas de IA utilizando la computación acelerada de NVIDIA en Google Cloud.

Como parte de un ecosistema más amplio destacado a través de NVIDIA Inception y Google for Startups, CodeRabbit y Factory están utilizando modelos basados en NVIDIA Nemotron en Google Cloud para potenciar agentes de revisión de código y desarrollo de software autónomo, mientras que Aible, Mantis AI, Photoroom y Baseten están construyendo soluciones de datos empresariales, inteligencia de video, imágenes generativas e inferencia gestionada en la plataforma de stack completo de NVIDIA en Google Cloud.

Vía NVIDIA Blog.