NVIDIA actualizó su Blueprint Metropolis para búsqueda y resumen de video (VSS) con una arquitectura modular y un nuevo paquete de skills pensado para integrarse con agentes de programación autónomos. La pieza permite transformar millones de streams de video en vivo o cientos de horas grabadas en información buscable y accionable en tiempo real, según la documentación de NVIDIA.

VSS funciona como arquitectura de referencia para construir agentes de IA de análisis de video que perciben, razonan y actúan sobre grandes volúmenes de material audiovisual. Combina microservicios acelerados de visión, vision-language models (VLMs), large language models (LLMs) y retrievers para habilitar búsqueda agéntica y reportes automatizados.

¿Qué cambia con VSS 3?

La novedad principal es el paso de un setup manual a uno controlado por agente. Hasta ahora los desarrolladores tenían que configurar, desplegar e integrar el conjunto completo de microservicios de VSS a mano para construir una aplicación de análisis de video. Con VSS 3, esos pasos se delegan en coding agents que reciben los skills publicados en el repositorio oficial en GitHub y siguen la especificación agentskills.io.

NVIDIA confirma compatibilidad inmediata con Codex de OpenAI, Claude Code de Anthropic, OpenClaw y NemoClaw. La instalación es declarativa: un único prompt indica al agente que lea los archivos SKILL.md del repo y registre cada skill en la carpeta estándar del host (~/.claude/skills/, ~/.codex/skills/, o el path universal ~/.agents/skills/). El agente además crea symlinks en vez de copias, así un git pull mantiene todo al día.

¿Cómo es el flujo de trabajo extremo a extremo?

NVIDIA propone dos pasos. Primero, desplegar el perfil de búsqueda de VSS con Codex desde VSCode conectado por SSH a una instancia Brev de NVIDIA. El agente planifica el despliegue, configura variables de entorno y levanta los contenedores necesarios para habilitar la búsqueda. Segundo, integrar OpenClaw como agente autónomo para consultar el sistema desde una interfaz de chat.

El ejemplo que entrega NVIDIA es elocuente. Frente a un set de tres videos de 10 minutos grabados en una bodega, el operador pide a OpenClaw: "Necesito encontrar instancias de un trabajador subiendo una escalera y verificar que use casco y chaleco de seguridad". El agente identifica los skills relevantes, sube los archivos a VIOS, los ingesta a través de los microservicios de embeddings, genera índices buscables y usa la capacidad de fusion search para devolver los clips exactos donde aparece el escenario consultado, con capturas adjuntas.

Arquitectura: ¿por qué fusion search y no embedding único?

La búsqueda de video a gran escala sigue siendo una de las fronteras más difíciles de la recuperación de información moderna. Las queries son inherentemente ambiguas: capturar la intención semántica completa dentro de un único embedding visual es insuficiente cuando objetos y eventos cargan atributos multinivel que resisten una representación vectorial simple. A escala masiva, encontrar un momento específico entre millones de horas de material se convierte en un problema literal de aguja en un pajar, y la búsqueda por vecinos cercanos sobre un espacio de embeddings monolítico degrada rápidamente tanto en precisión como en recall.

La respuesta arquitectónica de VSS 3 combina dos capacidades: extracción y recuperación de embeddings de múltiples tipos, con filtrado de relevancia y deduplicación semántica; y un módulo de fusión que cruza señales heterogéneas (texto, audio, atributos detectados) antes de devolver resultados.

Disponibilidad y costos

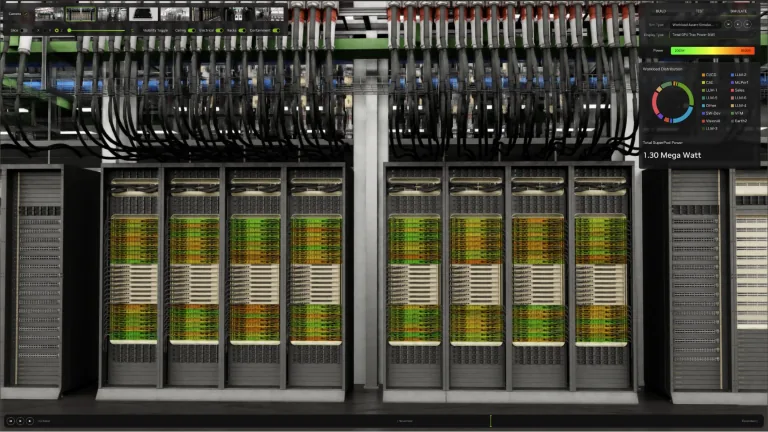

VSS corre sobre infraestructura NVIDIA acelerada por GPU. El path de menor fricción es el NVIDIA Brev Launchable documentado aquí: clic en "Launch Blueprint", "Deploy Launchable" y luego ejecutar el notebook deploy_vss_launchable.ipynb con la clave de API de NGC. El blueprint en sí es gratuito; el costo va por el tiempo de GPU consumido en Brev. Los skills son open source y siguen la especificación pública de agentskills.io, así que pueden adaptarse a otros stacks de video sin atarse al ecosistema NVIDIA.

Contexto para integradores LatAm

Para empresas chilenas que ya operan con CCTV o cámaras IP en plantas, bodegas o retail, el ángulo más concreto es de cumplimiento: la verificación automática de elementos de protección personal (EPP) sobre video grabado es uno de los casos de uso que la Superintendencia de Seguridad Social y las mutualidades chilenas vienen empujando hace años, hoy resuelto a mano por personal de prevención de riesgos. Replicar la demo de NVIDIA en Chile requiere acceso a una GPU compatible (H100 o A100 son el caso típico) y conocimientos básicos de despliegue de contenedores. La barrera de entrada baja sustantivamente respecto del flujo manual previo.