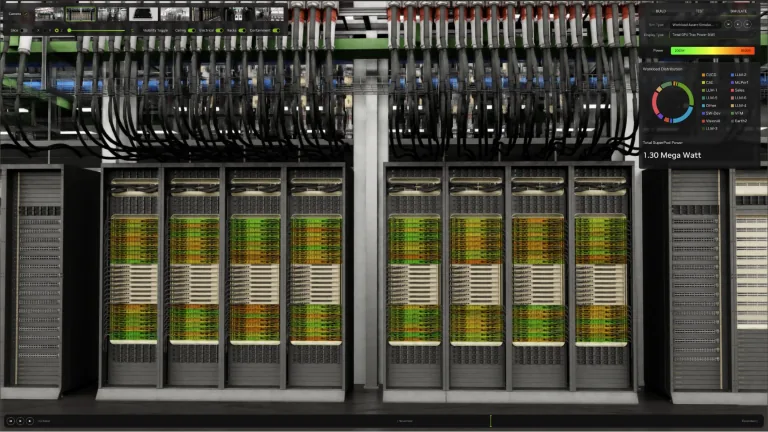

La estrategia que Nvidia y sus socios anunciaron para alimentar la próxima ola de cómputo de inteligencia artificial es desconcertantemente simple: en vez de construir un solo gigante de 5 GW que negocie su conexión a la red durante una década, levantar 25 instalaciones pequeñas, ubicadas al lado de subestaciones existentes, y mover la carga entre ellas según dónde haya electricidad disponible.

El piloto, desarrollado en alianza con la constructora InfraPartners, la propietaria de bienes raíces industriales Prologis y la organización sin fines de lucro EPRI (Electric Power Research Institute), construirá alrededor de 25 micro data centers de entre 5 y 20 megavatios cada uno, distribuidos entre cinco empresas eléctricas estadounidenses. Si una subestación queda saturada o sufre un corte, el cómputo se redirige a otro sitio con capacidad de sobra.

¿Por qué pegarse a una subestación?

Ben Sooter, director de iniciativas de IA agéntica y arquitectura distribuida de EPRI, lo explica con un dato concreto: las subestaciones individuales tienen "alrededor de 5 MW disponibles en promedio, con un máximo de 20 MW" sin uso. Es una cifra demasiado pequeña para atraer a un operador tradicional, pero suficiente para 25 nodos coordinados que actúan como una sola instalación lógica.

"Hay 55.000 subestaciones en Estados Unidos, y si cada una tiene 5, 10 o 20 MW de capacidad ociosa, el número suma rápido", agrega Marc Spieler, director senior de energía en Nvidia. La aritmética sugiere cientos de gigavatios teóricos repartidos en una red ya tendida, sin necesidad de nuevas líneas de transmisión.

Los números que hacen urgente la solución

Las cifras detrás de la urgencia son contundentes. EPRI proyecta que los data centers podrían consumir entre 9 y 17% de toda la generación eléctrica estadounidense para 2030, más del doble del nivel actual. Las instalaciones que entrenan modelos de frontera ya operan a escala de gigavatios, equivalentes al consumo de una ciudad estadounidense mediana.

El cuello de botella resultante deja a los desarrolladores esperando hasta una década por una conexión aprobada a la red. Eso ha llevado a decisiones extremas: construir centrales de gas en sitio, financiar líneas de transmisión nuevas o incluso invertir en startups de fusión y fisión avanzada para asegurar suministro a diez años.

Pero el reporte de 2025 del Nicholas Institute de la Universidad de Duke documentó algo distinto: la red estadounidense usa en promedio solo el 53% de su capacidad de generación. Está dimensionada para los peaks de verano, que duran menos de 200 horas al año. El resto del tiempo, plantas enteras quedan ociosas.

Un análisis de Brattle Group publicado en marzo estima que las redes estadounidenses podrían entregar 76 GW adicionales, cerca del 10% del peak, si las grandes cargas como los data centers redujeran su consumo apenas un 0,25% del tiempo.

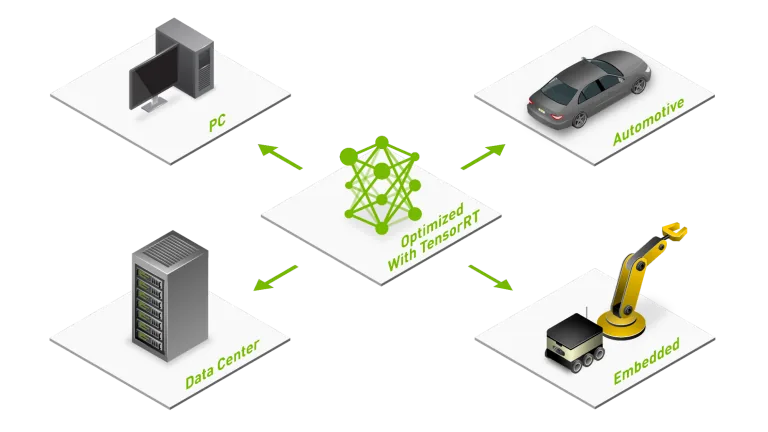

¿Por qué la inferencia y no el entrenamiento?

No todo workload de IA cabe en un mini centro. El entrenamiento exige GPUs densamente interconectadas. El modelo Llama 3.1 405B de Meta tardó cerca de dos meses y medio en entrenar sobre 16.000 GPUs, ajustando todos los pesos en cada paso mediante interconexiones de alta velocidad como NVLink o InfiniBand. Distribuir ese workload entre 25 nodos remotos sería un desastre de latencia.

La inferencia es otra historia. Una consulta del usuario entra al modelo, el modelo responde y no hay backpropagación que coordinar. "La inferencia es uno de los pocos workloads que se pueden enrutar dinámicamente", dice Valerie Crafton, vicepresidenta senior de estrategia en la firma de data centers modulares Mod42. "Significa que podés alinear el cómputo con el lugar donde la energía realmente está disponible."

Nvidia y EPRI llaman a esta estrategia "inferencia distribuida" y estiman que las cargas necesitarán ser movidas a una subestación distinta apenas el 0,1% del tiempo. El piloto fue anunciado en febrero y la construcción del lote inicial debería arrancar antes del cierre de 2026.

¿Qué viene después?

Sooter describe el momento actual como "la primera ola de cómputo, todos construyendo data centers gigantes de 5 GW". Pero anticipa una segunda ola distinta: instalaciones más pequeñas dedicadas a inferencia, donde la flexibilidad eléctrica vale más que la densidad bruta de GPUs. Las grandes tecnológicas, según sus contactos, ven la demanda de cómputo de inferencia despegando a partir de 2027.

Para mercados emergentes con redes más limitadas que la estadounidense, la lógica es aún más obvia: aprovechar la capacidad ociosa de subestaciones existentes evita el cuello de botella regulatorio que en países como Chile puede agregar entre tres y cinco años a un proyecto greenfield de data center.