Baidu liberó Ernie 5.1, un modelo de lenguaje construido sobre la base de pre-training de su antecesor Ernie 5.0 pero con aproximadamente un tercio de los parámetros totales y cerca de la mitad de los parámetros activos por consulta. El costo de pre-training equivalió al 6% del que requieren modelos comparables, según la empresa.

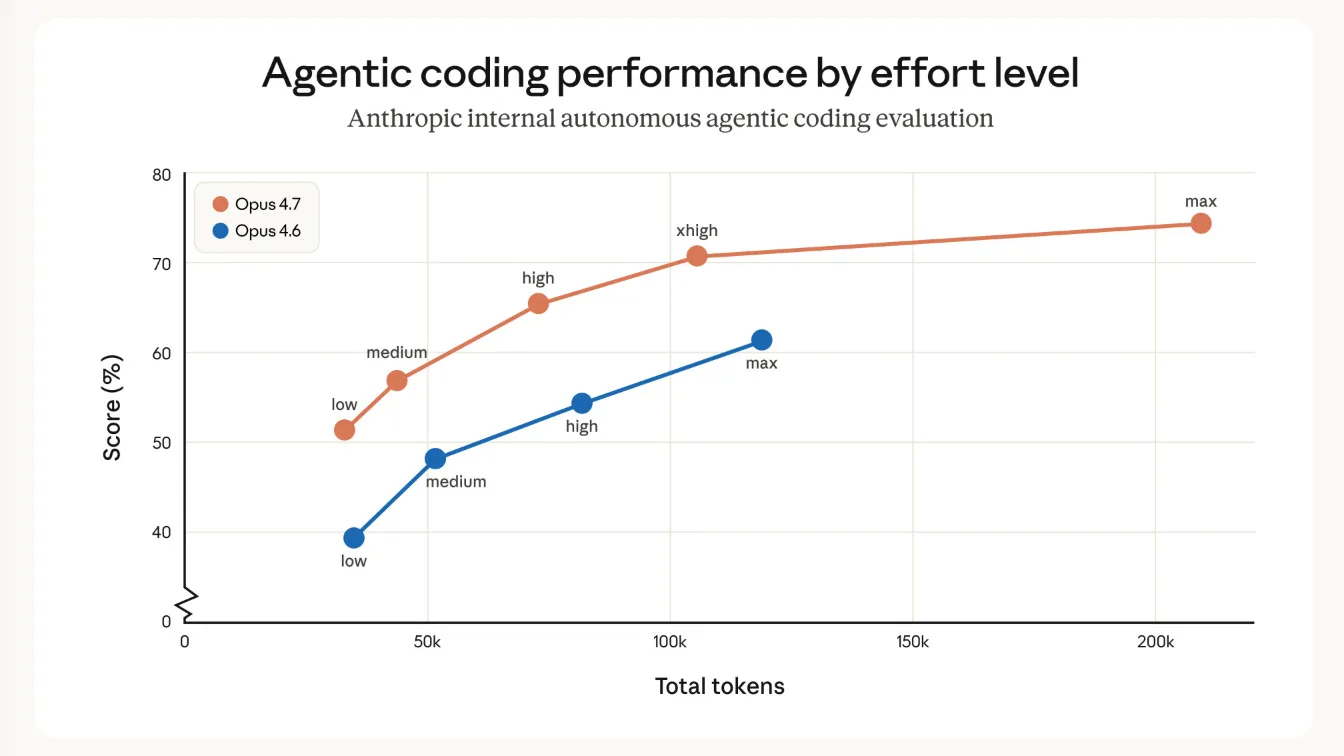

En el Search Arena Leaderboard, Ernie 5.1 marcó 1.223 puntos al 9 de mayo: 4° lugar global y 1° entre los modelos chinos, detrás de dos variantes de Claude Opus y de GPT-5.5 Search. En el Text Arena Leaderboard, la versión preliminar Ernie 5.1 Preview se ubica 13° con 1.476 puntos, también detrás de Claude Opus y Gemini 3.1 Pro.

¿Qué pruebas dice ganar Baidu?

Baidu afirma que Ernie 5.1 supera a DeepSeek-V4-Pro en tareas de agente autónomo (tau3-bench y SpreadsheetBench-Verified) y se acerca a Gemini 3.1 Pro en pruebas de conocimiento y razonamiento (GPQA y MMLU-Pro). En un benchmark de matemática difícil (AIME26) el modelo con acceso a herramientas queda apenas detrás de Gemini 3.1 Pro. Evaluaciones internas, agrega la compañía, lo muestran a la par de los modelos comerciales occidentales en escritura creativa.

El truco: "Once-For-All elastic training"

Baidu construyó Ernie 5.1 como un sub-modelo más pequeño extraído de Ernie 5.0 usando un marco que llama Once-For-All elastic training. En lugar de correr un pre-training separado y costoso para cada tamaño, la empresa optimiza una familia entera de modelos de distintos tamaños en una sola corrida, variando simultáneamente profundidad, cantidad de expertos y expertos activos por solicitud.

Los modelos comparten los pesos pero difieren en profundidad, ancho y cuántos bloques expertos especializados se activan ante una consulta. Baidu seleccionó lo que considera la mejor configuración de esa familia para Ernie 5.1, lo que explica el bajo costo de pre-training: el cómputo pesado ya estaba hecho para Ernie 5.0.

Además, Baidu rediseñó desde cero su infraestructura de reinforcement learning. Los componentes clave (actualización del modelo, generación de respuestas y evaluación) tradicionalmente corren acoplados; ahora se ejecutan como subsistemas independientes coordinados por un controlador central, de manera que un cuello de botella en una etapa no bloquea las demás.

¿Cómo combaten el "efecto sube y baja"?

Un problema conocido del entrenamiento multitarea es lo que Baidu denomina seesaw effect: cuando se entrena en muchas habilidades a la vez, las ganancias en una se pagan con caídas en otra. Código, lógica y creatividad terminan arrastrándose mutuamente hacia abajo.

La respuesta de la empresa es un pipeline de cuatro etapas:

- Etapa 1: entrenamiento supervisado estándar sobre un dataset amplio.

- Etapa 2: entrenamiento en paralelo de varios modelos expertos especializados, uno por código, razonamiento y tareas de agente, cada uno con sus propias señales de evaluación.

- Etapa 3: un único modelo estudiante aprende de todos esos profesores simultáneamente, generando sus propias respuestas y comparándolas con las salidas de los expertos.

- Etapa 4: reinforcement learning general para diálogo abierto y tareas creativas.

La última fase es necesaria, dice Baidu, porque la destilación profesor-estudiante tiende a producir respuestas demasiado pulidas y poco variadas.

¿Dónde se puede probar y qué falta verificar?

Ernie 5.1 ya está disponible en ernie.baidu.com y en un playground dentro de Baidu AI Studio. El modelo también se desplegará en más de diez plataformas creativas, incluyendo Isekai Zero (rol), Mulan AI (agente creativo), Diting Huanliu (canvas de IA) y Storymaster (drama corto).

Al igual que Ernie 5.0, Baidu no liberó los pesos, así que los puntajes de benchmark y las afirmaciones de eficiencia no se pueden verificar de manera independiente. Ernie 5.0 se lanzó en enero de 2026 con cerca de 2,4 billones de parámetros totales en una arquitectura mixture-of-experts, de los cuales menos del 3% se activa por consulta.