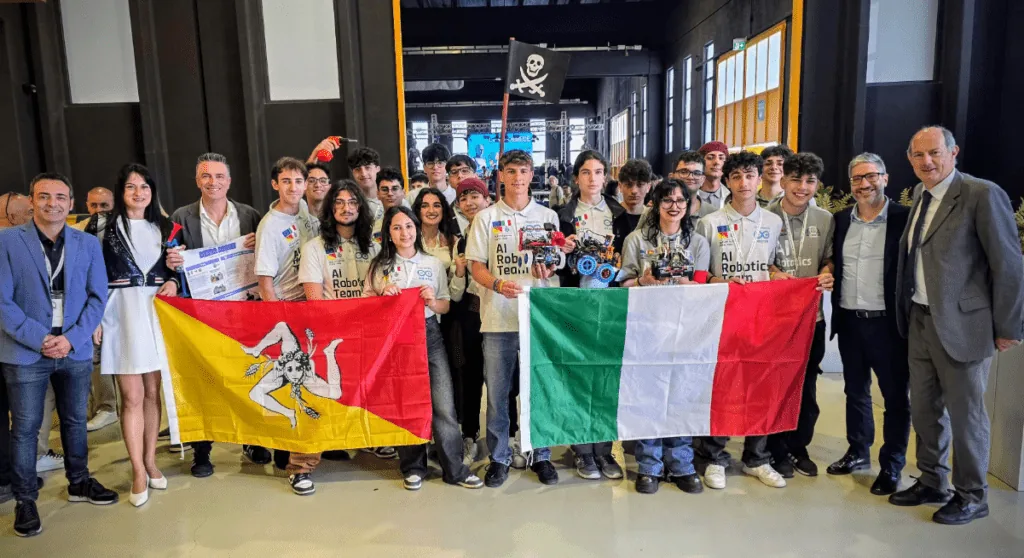

Los talleres de tarde dirigidos por estudiantes curiosos y motivados son donde ocurre parte de la ingeniería más interesante en la comunidad Arduino. Uno de los ejemplos más convincentes es FermiLabs, el hub de innovación del IIS "E. Fermi - R. Guttuso" en Giarre, Sicilia. El laboratorio ofrece a sus alumnos sesiones vespertinas de robótica, automatización y física experimental. Los resultados hablan por sí solos: equipos de FermiLabs ganaron varios podios en RoboCupJunior Europe, una de las competencias estudiantiles de robótica más exigentes del mundo.

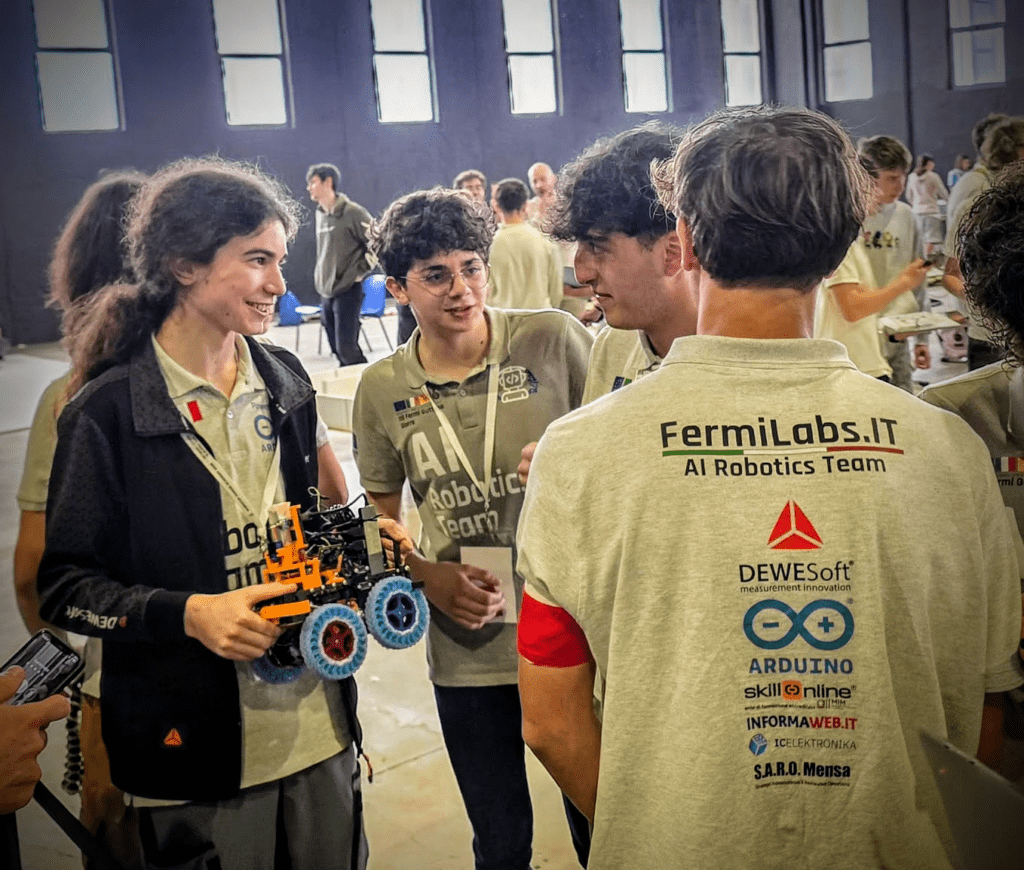

La modalidad RoboCupJunior Rescue desafía a los equipos a "diseñar, construir y programar robots completamente autónomos capaces de navegar escenarios de desastre": desde seguir líneas en terreno con obstáculos hasta explorar laberintos multinivel y asistir víctimas simuladas. Para la temporada 2026, dos equipos de FermiLabs llevan al límite lo que un robot estudiantil puede hacer, con Arduino al centro de ambas máquinas.

Team Tachyons: resolviendo el laberinto con Arduino GIGA R1 WiFi

El Rescue Maze exige a un robot explorar de forma autónoma un laberinto complejo y multinivel, identificar víctimas y desplegar kits de rescate con precisión. El reglamento 2026 subió el listón con la introducción de "cognitive targets": cinco círculos concéntricos de colores que el robot debe decodificar en tiempo real para clasificar tipos de víctima. El salto desde cuadrados de color simples a patrones visuales densos exige más poder de procesamiento e integración de sensores.

Team Tachyons, que mostró su trabajo en Arduino Days 2026 y es liderado por el youtuber y speaker TEDx Etto Fins, resolvió el problema centrando su robot en el Arduino GIGA R1 WiFi, aprovechando la capacidad de la placa de manejar tareas multi-thread complejas con la confiabilidad y baja latencia que la robótica competitiva demanda.

La inteligencia del robot vive en un shield Arduino diseñado por el equipo, que actúa como sistema nervioso central. Cuatro drivers dedicados de motor stepper entregan precisión submilimétrica de posicionamiento, mientras que una IMU de seis ejes, fusionada con datos de seis sensores ToF (Time-of-Flight), alimenta un PID que mantiene al robot centrado en cada baldosa, incluso en rampas y terreno irregular. Encima, el software construye una matriz 3D en vivo para mapear el laberinto en tiempo real, permitiendo backtracking y optimización autónoma de ruta.

El diseño mecánico es igual de cuidado. Las ruedas de silicona, moldeadas in-house con estructura airless, maximizan tracción y absorción de shock. El mecanismo de despliegue del kit de rescate usa un compliant mechanism con dos resortes para disparar cubelets a alta velocidad; los kits están diseñados con el menor coeficiente de restitución posible, para que caigan secos junto a la víctima en vez de rebotar.

Tras un buen desempeño en las selecciones regionales en Catania, Team Tachyons quedó segundo en los Nacionales Italianos con un modelo mejorado basado en placas UNO Q 4GB, ganando el pasaje a competir en Incheon, Corea del Sur, con los mejores 3.000 estudiantes de robótica del mundo.

Team Yellow Radiators: visión primero con Arduino UNO Q

El Rescue Line desafía a un robot completamente autónomo a seguir una línea negra a través de una arena modular de baldosas, superando obstáculos, escombros y terreno variable, hasta localizar y rescatar víctimas simuladas antes de navegar a una zona de extracción. Velocidad, confiabilidad y procesamiento visual en tiempo real lo son todo.

Team Yellow Radiators decidió abandonar los sensores tradicionales de seguidor de línea en favor de una arquitectura vision-first construida sobre Arduino UNO Q. En vez de correr la lógica de alto nivel y el control de motor de bajo nivel en placas separadas, los unificaron en una sola plataforma.

Una capa Python con OpenCV procesa los datos de la cámara en tiempo real para identificar la línea y leer los marcadores de intersección, mientras la parte Arduino maneja simultáneamente el loop de control de motor de alta frecuencia y la integración de sensores. Un puente de comunicación custom entre la capa Python de visión y la capa hardware del lenguaje Arduino hace posible esa operación de dos cerebros sin fricción.

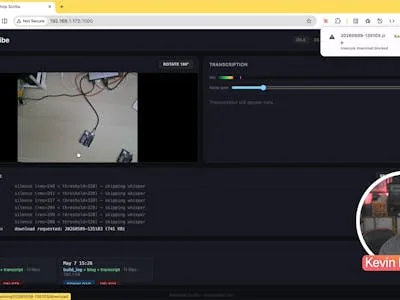

Para la competencia, el equipo construyó un panel web de control que transforma cómo se calibra el robot en sitio. Vía Wi-Fi local, los miembros pueden ver buffers de cámara en vivo, alternar entre máscaras de imagen para depurar detección de línea en tiempo real y ajustar calibración de color o umbrales de sensor con sliders, sin re-upload de código. El dashboard incluso permite llamadas remotas directas al core Arduino para probar manualmente subsistemas como el grabber del kit de rescate.

En el frente de IA, el equipo desplegó un modelo YOLO entrenado a medida sobre el runtime NCNN, optimizado para el SoC Arm de Qualcomm Technologies que monta la UNO Q. Su próximo hito: habilitar GPU passthrough para aprovechar aceleración Vulkan sobre la GPU Qualcomm Adreno integrada, reduciendo latencia de inferencia. El desarrollo se beneficia del Debian OS completo que corre la placa, lo que permite trabajar directamente desde VS Code vía Remote Development, un workflow profesional sobre un dispositivo edge compacto.

De Sicilia al mundial

Ambos proyectos ilustran algo que FermiLabs hizo costumbre: con las herramientas correctas, un equipo de liceo puede ingeniar soluciones que rivalizan con sistemas de grado profesional. El rol de Arduino en ambos robots no es incidental: es la plataforma que pone la iteración rápida, el control de hardware y la conectividad al alcance de estudiantes que quieren construir cosas que efectivamente funcionen bajo presión.

Tras múltiples éxitos en Catania durante abril, FermiLabs prepara dos equipos para el RoboCupJunior European Championships en Viena y otros dos para el RoboCup Federation Junior World Championships en Corea del Sur. Se puede seguir su progreso en fermilabs.it y en LinkedIn, o revisar su call for partners para sumar apoyo. El reportaje original aparece en el blog de Arduino.