Una vez que se baja el ruido del marketing y la mística que rodea al término, los modelos grandes de lenguaje (LLMs) resultan ser una aplicación fascinante de la estadística clásica. En la práctica son lo que se obtiene al subir un autocompletado básico al máximo: para analizar volúmenes monumentales de texto y devolver resultados coherentes hace falta una buena dosis de matemáticas. Una serie reciente de tres artículos del programador británico Giles Thomas, publicada entre agosto y septiembre de 2025, recorre los fundamentos del proceso de inferencia, es decir, el paso en que un modelo ya entrenado predice la siguiente palabra.

¿Qué son los logits y cómo se construye una respuesta?

El texto vive dentro del LLM como IDs numéricos en un espacio vectorial. Cada token, que puede ser una palabra completa o un fragmento de palabra, tiene una probabilidad asociada de aparecer después de otro ID. Pensemos en gatos sobre un escritorio: la frase es estadísticamente plausible porque los IDs de "gato" y "escritorio" coexisten muchas veces en los datos de entrenamiento.

Durante la inferencia, el modelo devuelve un vector con varios IDs candidatos, cada uno con una puntuación. Estos valores crudos se llaman logits y son los protagonistas del primer artículo de la serie. A partir de ellos, paso a paso, se arma una oración completa.

El espacio vectorial y los embeddings

El segundo artículo entra en el vocabulario y los embeddings. Cada token se representa como un vector de cientos o miles de dimensiones, donde palabras semánticamente cercanas quedan ubicadas en regiones cercanas del espacio. El procesamiento real consiste en operaciones matriciales sobre esos vectores, multiplicaciones que parecen aburridas en el papel pero que son la maquinaria que permite que el modelo "entienda" relaciones entre conceptos.

Para los modelos modernos los números son grandes: GPT-3 usaba embeddings de 12.288 dimensiones, Llama 3 70B trabaja con vectores de 8.192 dimensiones, y los chips H100 de Nvidia que ejecutan estas operaciones manejan hasta 3.958 TFLOPS en formato FP8 dedicados precisamente a este tipo de aritmética matricial.

¿Qué hace el mecanismo de atención?

El tercer artículo ata los cabos y explica los transformers, la arquitectura central de GPT (generative pretrained transformer). El componente decisivo es el mecanismo de atención, que permite a la red hacer pattern matching entre tokens distantes dentro de una misma secuencia. Sin atención, un LLM seguiría siendo un autocompletado glorificado. Con atención, la salida adquiere una estructura que parece comprensión real, aunque siga siendo, en estricto rigor, una predicción estadística.

Aquí entra una pregunta que el ingeniero o científica de datos debe hacerse cada vez que recibe una respuesta plausible de un modelo: ¿cuán correcta es esa salida? La fluidez no implica veracidad. Hay evidencia creciente de que el uso indiscriminado de LLMs puede degradar la capacidad crítica de quien los consulta, justamente porque la prosa coherente desactiva el reflejo de verificar.

Más allá de la inferencia básica

La serie de Thomas se queda en la base, pero sirve como puerta de entrada a temas más complejos. Para acelerar la inferencia en producción se usan técnicas como los cachés de clave-valor con cuantización vectorial, que recortan dramáticamente la memoria GPU necesaria. La cuantización a 4 bits, hoy estándar en modelos open source, reduce el footprint hasta 4x sin pérdida significativa de calidad para la mayoría de usos.

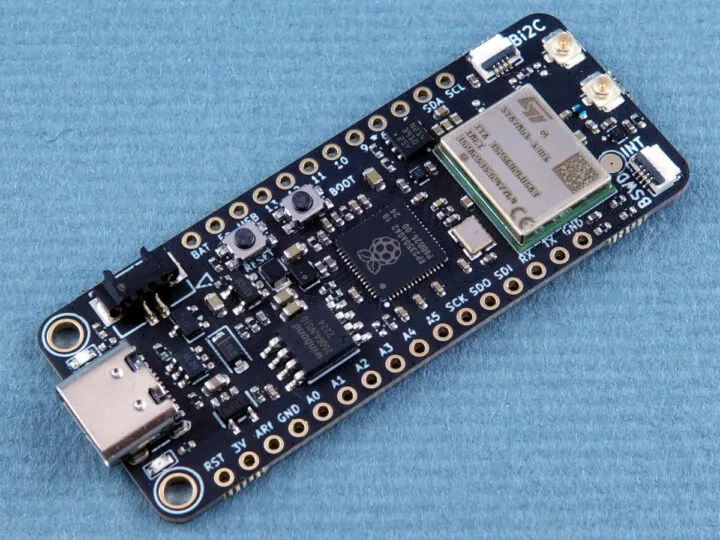

Para makers latinoamericanos que quieran experimentar localmente, la barrera de entrada bajó considerablemente: un modelo cuantizado de 7B parámetros corre en una Raspberry Pi 5 con 8 GB de RAM, y modelos de 13B en una GPU de consumo como la RTX 3060 con 12 GB. Ya no es necesario una H100 de USD 30.000 para tener un asistente local funcional, lo que abre la puerta a aplicaciones edge sin enviar datos a la nube.