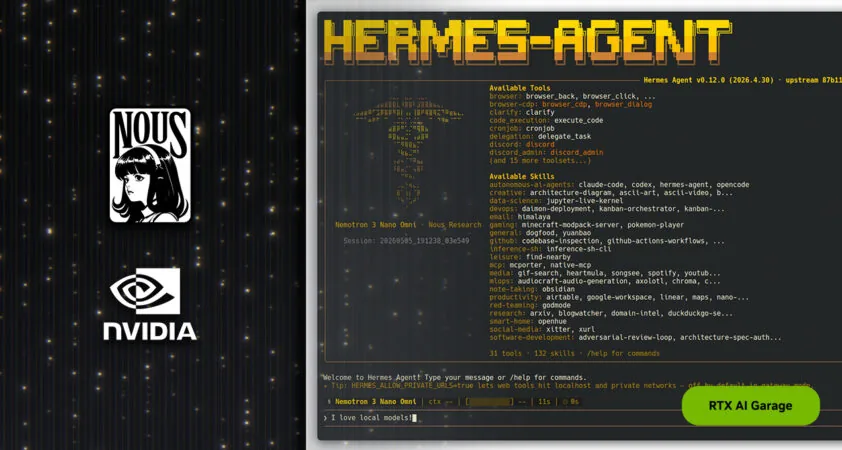

Los agentes autónomos están cambiando cómo los usuarios resuelven trabajo y, después del impacto de OpenClaw, la comunidad empezó a migrar hacia frameworks open source más maduros. El último en consolidarse es Hermes Agent, que cruzó las 140.000 estrellas en GitHub en menos de tres meses y, según OpenRouter, figura como el agente más utilizado del mundo desde la semana pasada.

Desarrollado por Nous Research, Hermes apunta a dos propiedades históricamente difíciles de combinar en un agente autónomo: confiabilidad y auto-mejora. Es agnóstico al proveedor y al modelo por diseño, y está optimizado para uso local permanente, lo que convierte a las GPUs NVIDIA RTX, a las workstations NVIDIA RTX PRO y a NVIDIA DGX Spark en hardware ideal para sostener cargas de trabajo 24/7.

Qwen 3.6, la nueva serie de modelos grandes de lenguaje de pesos abiertos de Alibaba, encaja particularmente bien con este escenario. Sus variantes de 27B y 35B parámetros superan a los modelos previos de 120B y 400B, y corren tanto sobre tarjetas NVIDIA RTX como sobre DGX Spark para acelerar agentes locales.

¿Qué hace distinto al agente Hermes?

Como otros frameworks populares, Hermes se integra con aplicaciones de mensajería, accede a archivos y aplicaciones locales y se mantiene operando todo el día. Pero, según NVIDIA, hay cuatro capacidades que lo separan del resto.

- Skills auto-evolutivas: Hermes escribe y refina sus propias habilidades. Cada vez que enfrenta una tarea compleja o recibe feedback, guarda lo aprendido como un skill para adaptarse y mejorar con el tiempo.

- Sub-agentes contenidos: cada sub-agente es un trabajador efímero y aislado, con contexto y herramientas acotadas a una sub-tarea. Esto ordena la ejecución, reduce confusiones del orquestador y permite usar ventanas de contexto chicas, ideal para modelos locales.

- Confiabilidad por diseño: Nous Research cura y prueba a fondo cada skill, herramienta y plug-in que viene de fábrica. El resultado es que Hermes funciona incluso con modelos locales de 30.000 millones de parámetros, sin la depuración constante que exigen otros frameworks.

- Mismo modelo, mejores resultados: comparativas hechas por desarrolladores muestran resultados consistentemente más sólidos en Hermes con el mismo modelo subyacente. La diferencia, explica NVIDIA, está en que Hermes opera como una capa de orquestación activa y no como una envoltura fina alrededor del modelo, lo que habilita agentes persistentes en el dispositivo en vez de ejecuciones tarea por tarea.

Tanto Hermes como los modelos que lo respaldan están pensados para correr en local. Por lo mismo, la calidad del hardware determina directamente la experiencia, y las GPUs NVIDIA RTX están diseñadas para este tipo de cargas.

Qwen 3.6: inteligencia de data center, en el escritorio

La nueva familia Qwen 3.6 amplía lo que ya había mostrado Qwen 3.5. El modelo Qwen 3.6 35B corre sobre cerca de 20 GB de memoria y supera a modelos de 120.000 millones de parámetros, que necesitan más de 70 GB para operar.

Por su parte, Qwen 3.6 27B es un modelo denso con más parámetros activos que llega a la precisión de modelos de 400.000 millones de parámetros, como Qwen 3.5 397B, ocupando una dieciseisava parte del tamaño. En GPUs RTX de gama alta, esto se traduce en tiempos de respuesta notoriamente más cortos.

Para acelerar la inferencia, los NVIDIA Tensor Cores entregan mayor throughput y menor latencia, lo que permite que Hermes complete tareas multipaso o refine sus skills en segundos en vez de minutos.

DGX Spark, la computadora agentica siempre encendida

Agentes como Hermes están pensados para correr de forma continua: responden requests, planifican tareas multipaso, ejecutan de manera autónoma y se mejoran a sí mismos. NVIDIA DGX Spark se presenta como la compañera ideal para ese rol, una máquina compacta, eficiente y autónoma para flujos agenticos sostenidos durante toda la jornada.

Con 128 GB de memoria unificada y un petaflop de rendimiento de IA, DGX Spark puede mantener funcionando modelos mixture-of-experts de 120.000 millones de parámetros durante toda la jornada. El nuevo Qwen 3.6 35B ofrece inteligencia equivalente con una huella más liviana, lo que abre espacio para correr cargas concurrentes.

Para sacar el máximo rendimiento, NVIDIA publicó el playbook de Hermes para DGX Spark. Quienes quieran ir más allá pueden registrarse en las sesiones prácticas de la serie Build It Yourself, donde se enseña a construir agentes autónomos con NemoClaw y OpenShell.

DGX Spark se puede pedir a los socios de manufactura de NVIDIA: el catálogo está disponible en el marketplace de la compañía.

¿Cómo empezar a correr Hermes en hardware NVIDIA?

Echar a andar Hermes localmente sobre hardware NVIDIA es directo. La puerta de entrada es el repositorio de Hermes en GitHub, donde está la documentación oficial.

A partir de ahí, basta con elegir un modelo local y un runtime. Las opciones más rodadas son correr Hermes junto a Qwen 3.6 vía llama.cpp, LM Studio u Ollama. El agente ya incluye soporte de fábrica para LM Studio y Ollama, lo que ofrece el camino más corto para tener un agente local funcionando.

¿Vale la pena montar el stack en Chile o LatAm?

DGX Spark se vende por la red de partners de NVIDIA, lo que en la región implica importación vía distribuidores de workstations profesionales. Para entornos de prueba más accesibles, Qwen 3.6 35B corre en GPUs RTX de gama media-alta (24 GB de VRAM o más) que ya se distribuyen localmente para gaming y creación de contenido, lo que abre una vía intermedia para experimentar con agentes locales sin pasar por hardware de servidor.

Para quien quiere empezar con presupuesto contenido, una NVIDIA RTX 4090 o RTX 5080 con 16 a 24 GB de VRAM permite correr Qwen 3.6 27B en formatos cuantizados, con tiempos de respuesta razonables para asistentes personales. La versión 35B exige más memoria, pero ya con dos tarjetas en paralelo o un único modelo cuantizado a 4 bits, baja a rangos viables para escritorios entusiastas.

Lo último del RTX AI Garage

- Las GPUs NVIDIA RTX PRO entregan hasta 3 veces más velocidad de generación de tokens corriendo modelos Qwen 3.6 con llama.cpp.

- Los modelos Gemma 4 26B y 31B de Google ya están disponibles como checkpoints NVFP4 para mayor rendimiento en GPUs NVIDIA Blackwell. Combinados con los nuevos drafters de Multi-Token Prediction, ofrecen hasta 3 veces más inferencia con la misma calidad de salida.

- Mistral Medium 3.5, lanzado en abril, suma compatibilidad con llama.cpp y Ollama, lo que habilita su uso en sistemas NVIDIA RTX PRO y DGX Spark.

- NVIDIA NemoClaw, el stack open source que optimiza experiencias OpenClaw en dispositivos NVIDIA, ahora corre sobre Windows Subsystem for Linux (WSL2), abriendo el camino a entusiastas y desarrolladores en la plataforma de Microsoft.