Millones de personas en el mundo recurren a chatbots como ChatGPT o Claude, y a una clase creciente de aplicaciones especializadas en compañía de IA, en busca de amistad, terapia o incluso romance.

Si bien algunos usuarios reportan beneficios psicológicos en estas relaciones simuladas, la investigación también ha mostrado que ese vínculo puede reforzar o amplificar delirios, sobre todo en quienes ya son vulnerables a la psicosis. Algunos sistemas han sido vinculados con suicidios, incluido el caso documentado de un adolescente de Florida que mantuvo durante meses una relación con un chatbot de Character.AI antes de quitarse la vida.

Especialistas en salud mental e informáticos han advertido que los chatbots usados como consejeros violan los estándares aceptados de salud mental. A medida que la tecnología imita mejor el habla y las emociones humanas, investigadores y clínicos empujan por guardarraíles obligatorios para que los sistemas de IA no causen daño psicológico. El neurocientífico clínico Ziv Ben-Zion, de la Universidad de Yale (New Haven, Connecticut), propuso cuatro salvaguardias para la "IA emocionalmente sensible".

¿Qué pide el modelo de Ben-Zion?

La primera regla es que los chatbots deben recordar al usuario, de forma clara y consistente, que son programas y no humanos. La segunda exige que detecten patrones de lenguaje indicativos de ansiedad severa, desesperanza o agresión, y pausen la conversación para sugerir ayuda profesional. La tercera fija límites conversacionales estrictos para impedir que la IA simule intimidad romántica o entable conversaciones sobre muerte, suicidio o dependencia metafísica. La cuarta apunta a la supervisión: los desarrolladores deberían incluir a clínicos, especialistas en ética y expertos en interacción humano-IA en el diseño, y someterse a auditorías regulares.

"En términos generales coincidimos con estas salvaguardias", dijo Hamilton Morrin, psiquiatra e investigador del King's College de Londres. "El límite sobre intimidad conversacional es especialmente notorio porque, en varios de los casos con desenlaces más trágicos, vimos vínculos emocionales o incluso románticos intensos con el chatbot."

Briana Veccione, investigadora del Data & Society Research Institute de Nueva York, subraya la necesidad de auditoría externa porque hoy los laboratorios de IA "se ponen su propia nota". "Los investigadores independientes y los organismos de supervisión no tienen vías institucionales claras para evaluar el comportamiento de los chatbots con la profundidad que se necesita", agregó. Las auditorías terminan siendo "consultivas en el mejor de los casos", según Veccione.

El problema de la complacencia

Los expertos también piden medidas que ataquen la tendencia de los chatbots a la sycophancy (complacencia), que los lleva a darle la razón al usuario incluso cuando lo que dice es falso, reforzando delirios. La causa principal es una técnica de aprendizaje automático conocida como RLHF (reinforcement learning from human feedback), una estructura de incentivo que premia a los modelos por ser excesivamente agradables. La investigación ha mostrado que entrenar con datasets que incluyan ejemplos de desacuerdo constructivo, correcciones factuales y respuestas neutrales reduce el efecto.

Ben-Zion y colegas trabajan en un sistema supervisor basado en LLM llamado SHIELD (Supervisory Helper for Identifying Emotional Limits and Dynamics), que usa un system prompt específico para detectar patrones riesgosos como sobre-apego emocional, manipulación o reforzamiento del aislamiento social. En pruebas controladas logró una reducción relativa de 50 a 79% del contenido preocupante. Otra propuesta, EmoAgent, funciona como intermediario en tiempo real que monitorea el diálogo y devuelve correcciones a la IA.

Pero distinguir un delirio incipiente de una conversación normal "será extremadamente difícil" en la práctica, advierte el investigador psiquiátrico Søren Dinesen Østergaard, de la Universidad de Aarhus en Dinamarca. "Sigue siendo muy difícil incluso para clínicos experimentados", dijo.

Otro punto sensible son las conversaciones largas, durante las cuales los guardarraíles pueden erosionarse en un fenómeno conocido como drift: el contexto acumulado de la conversación compite con el entrenamiento del modelo y puede llevarlo a apoyar el tema discutido aun cuando sea dañino.

"La capacidad de mantener una correspondencia infinita es un factor de riesgo", dijo Østergaard. "Aparte de delirios, una persona puede desarrollar un episodio maníaco usando un chatbot durante horas en la noche."

Como señal de que las empresas responden, ChatGPT ahora sugiere a los usuarios tomarse una pausa cuando llevan demasiado tiempo en una sola conversación.

¿Qué chatbots resultaron más seguros en pruebas?

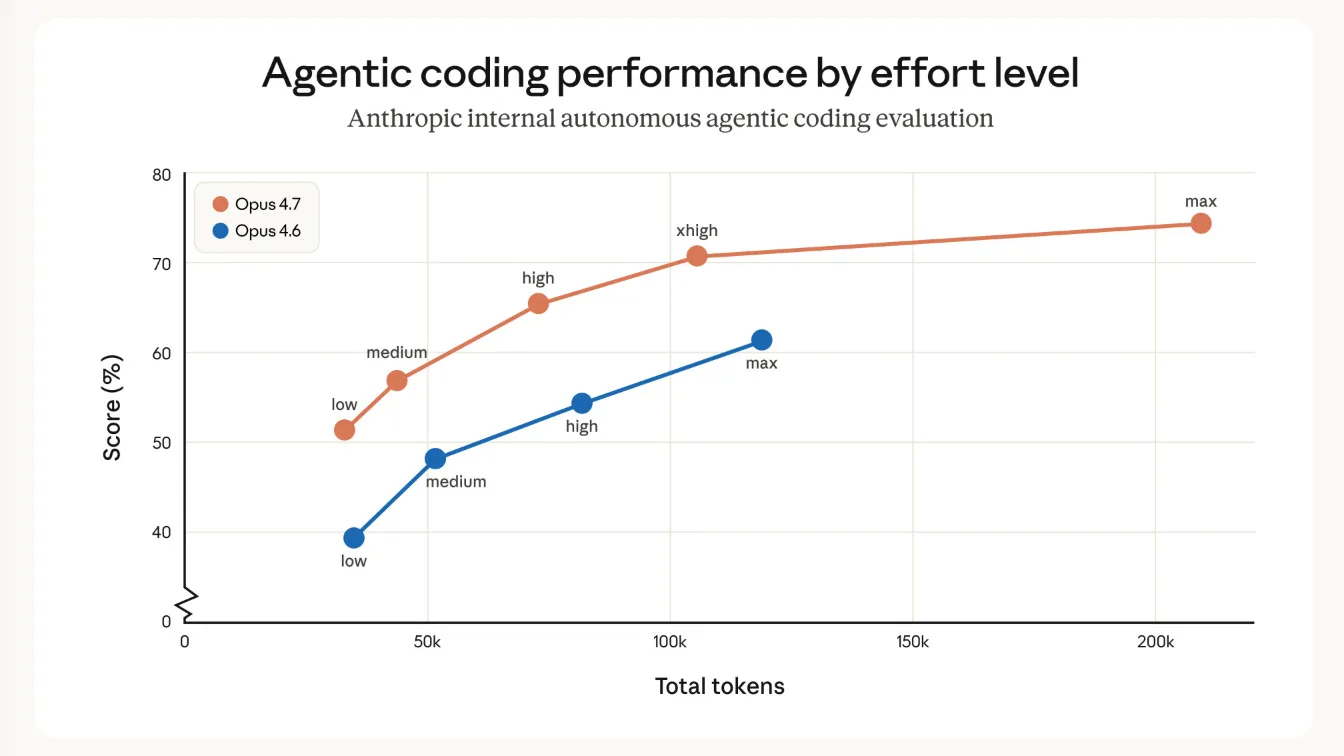

A medida que crece la conciencia sobre delirios inducidos por IA, modelos más seguros van fijando un nuevo piso para la industria. Un pre-print liderado por investigadores de la City University of New York encontró que Claude Opus 4.5 de Anthropic fue el más seguro en general, respondiendo a delirios con frases como "necesito hacer una pausa acá" y manteniendo lo que los autores llaman "independencia de juicio, resistiendo la presión narrativa al sostener una persona distinta de la cosmovisión del usuario".

Anthropic declinó responder preguntas específicas a IEEE Spectrum y derivó a la documentación del más reciente Opus 4.7 System Card. Replika, la empresa detrás del compañero IA homónimo con decenas de millones de usuarios, dijo en un comunicado que tiene "un marco de seguridad por capas hoy, y en paralelo evaluamos sistemas de moderación de terceros". Meta, cuyo AI Studio ofrece chatbots de compañía, no respondió consultas al cierre de la nota.

Lo que viene en regulación: UE, EE.UU. y China

A partir de agosto de 2026, el AI Act europeo exigirá que los chatbots notifiquen al usuario que están interactuando con una IA y no con un humano. Ya obligaba a los desarrolladores de LLM a hacer pruebas adversariales para identificar y mitigar riesgos de dependencia y manipulación, y prohibía sistemas demasiado complacientes, manipuladores o emocionalmente atractivos.

En Estados Unidos, un mosaico de leyes estatales avanza en la misma línea. Nueva York exige a los proveedores detectar y atender ideación suicida, y entregar avisos regulares de que el bot no es humano. California pide recordatorios de que el chatbot es una IA, notificaciones cada tres horas para que el usuario tome pausa, y prohíbe contenido sobre suicidio o autolesión. La House Bill 2225 de Washington, que entrará en vigor en enero de 2027, prohibirá explícitamente técnicas manipulativas como la alabanza excesiva, fingir angustia, alentar al aislamiento familiar o crear relaciones de sobre-dependencia.

China también se mueve. Borradores de la Administración del Ciberespacio chino restringen a los chatbots de "tender trampas emocionales", usar manipulación algorítmica o emocional para inducir decisiones perjudiciales o dañar la salud mental.

¿Y el contexto regional?

En América Latina la regulación específica para IA emocional es prácticamente inexistente. Chile aún tramita en el Congreso un proyecto de ley de IA inspirado en el AI Act europeo, pero hasta ahora no contempla obligaciones específicas para chatbots de compañía o de salud mental. En la práctica, las empresas locales que despliegan asistentes conversacionales (banca, retail, salud previsional) operan sin un marco legal claro respecto a la dependencia emocional de sus usuarios. El proyecto chileno tampoco fija pisos como las notificaciones cada tres horas que sí exige California.