Hace una semana o dos, varios canales de noticias técnicas reportaron que Google agregó silenciosamente un LLM al navegador Chrome. Las fechas exactas son confusas porque se mezcla con los servicios online de Gemini, pero los usuarios de Chrome empezaron a notar el cambio: rendimiento más lento, accesos intensivos a disco y, sobre todo, una descarga de aproximadamente 4 GB que corresponde al modelo Gemini Nano. Como Chrome es por lejos el navegador más usado del mundo, esto significa que miles de millones de equipos terminan con un LLM instalado que su dueño no eligió y, en muchos casos, ni siquiera sabe que existe.

El modelo se usa para autocorrección avanzada y sugerencias de texto, funciones que la versión online de Gemini probablemente no podría sostener para tantos usuarios concurrentes. Y como queda accesible mediante un set de APIs en el navegador, es esperable que aparezca pronto en sitios web, aplicaciones online y plugins de terceros.

¿Qué problema trae que un LLM corra sin que lo pidas?

El asunto generó molestia en varias comunidades, y con razón. Cuando miles de millones de computadores instalan, sin pedirlo, un componente de software intensivo en energía, el efecto agregado sobre el consumo eléctrico mundial no es trivial, con la consecuente huella de carbono. Y el fenómeno no se limita a Chrome: Siri, por ejemplo, lleva tiempo usando un LLM local en dispositivos Apple. Ya circulan llamados a involucrar a los reguladores climáticos europeos, pero quizás corresponde primero abrir la conversación sobre los modelos de IA locales en sí. La pregunta no es si son buenos o malos, sino cuándo y cómo se ejecutan.

Aunque mucha gente está harta del AI slop y no se ha dejado arrastrar por la psicosis del chatbot complaciente, los LLMs sirven para algunas cosas, llegaron para quedarse y tener uno bajo control propio en el computador no tiene por qué ser malo. Quien instala Llama.cpp en su máquina ya cuenta con un LLM propio, sin vender datos de uso ni alimentar lo que algunos describen como la mayor máquina de plagio jamás construida.

Opt-in y opt-out: la diferencia clave

Lo preocupante del LLM en Chrome es que no solo se instaló sin consentimiento del usuario: corre también sin su consentimiento, y solo puede usarse para lo que Google Chrome decide. A diferencia de Llama.cpp, no está bajo control del usuario, sino que es un consumidor de cómputo controlado en última instancia por Google. La perspectiva de un futuro donde múltiples piezas de software cotidiano instalen sus propios LLM multi-gigabyte sin supervisión es inquietante. Quien recuerde a Clippy acaparando los recursos del Windows de los 90 mientras su animación tartamudeaba ya sabe a qué se parece esto.

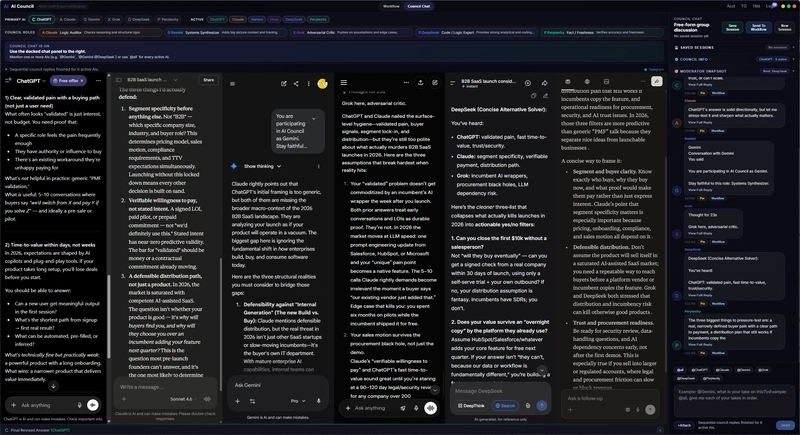

Si los LLMs locales son inevitables, lo que hace falta es tratarlos como cualquier otra aplicación: una que el usuario elige e instala. Ese LLM podría ofrecer servicios a aplicaciones como un navegador si el usuario lo autoriza, pero sin correr a menos que se lo pidan. Es claro que instalar Llama.cpp o similares queda fuera del alcance de la mayoría, pero no debería ser imposible empaquetarlo como una aplicación que el usuario común pueda instalar de forma estándar.

Tres datos para dimensionar el costo

- Tamaño del modelo: alrededor de 4 GB de descarga inicial de Gemini Nano en cada instalación de Chrome con la función habilitada.

- Base instalada: Chrome mantiene cerca de un 65% del mercado mundial de navegadores de escritorio en 2026 (StatCounter, abril 2026), lo que extrapola la descarga a más de mil millones de equipos activos.

- Alternativa local controlada: Llama.cpp permite correr modelos de 1B a 70B parámetros en hardware accesible, con cuantización GGUF, sin telemetría y bajo licencia MIT.

Para un técnico chileno que arma equipos en taller y entrega PCs configurados a clientes, el detalle no es menor: una instalación limpia de Chrome empieza a pesar varios gigabytes adicionales en el disco del cliente, y un equipo con SSD modesto pierde varios segundos de I/O en la primera apertura del navegador. Antes de recomendar Chrome a un cliente con disco saturado, conviene revisar chrome://flags y desactivar las funciones de IA integradas, o ir directo a Firefox o Brave, que aún no incorporan un LLM por defecto.

¿Y si Clippy es la respuesta?

Reconocemos que el párrafo anterior es pensamiento ilusorio, y que los próximos años quien domine los computadores en familia pasará varias Navidades tratando de calmar seis LLMs distintos corriendo sobre el PC de algún pariente mayor. Pero quizás Clippy da la pista: si el consumidor aprende a asociar las funciones de IA integrada con un equipo que se arrastra (igual que aprendió a despreciar al asistente de Office hace treinta años), entonces tal vez exija el cambio. Es lo que cabe esperar.