NVIDIA y la startup londinense Ineffable Intelligence anunciaron una colaboración técnica para construir, desde cero, la infraestructura de hardware y software que necesita la próxima generación de sistemas de aprendizaje por refuerzo (reinforcement learning, RL). Ineffable es el laboratorio que David Silver, uno de los arquitectos de AlphaGo y AlphaZero en DeepMind, fundó tras salir de modo stealth la semana pasada.

¿Qué hace distinto al aprendizaje por refuerzo a escala?

El planteo de Silver es claro. "Los investigadores ya resolvieron el problema fácil de la IA: cómo construir sistemas que sepan todo lo que los humanos ya saben", dijo el cofundador. "Ahora hay que resolver el problema difícil, cómo construir sistemas que descubran conocimiento nuevo por sí mismos. Eso exige un enfoque muy distinto, sistemas que aprendan desde la experiencia."

Esa diferencia tiene consecuencias directas para la infraestructura. A diferencia del preentrenamiento, donde un dataset fijo de datos humanos atraviesa el sistema, los workloads de RL generan sus propios datos sobre la marcha. El sistema actúa, observa, puntúa y actualiza pesos en bucles cortos y continuos, lo que presiona el interconnect, el ancho de banda de memoria y la capa de servicio en formas que el preentrenamiento no produce. Además, el modelo termina aprendiendo formas de experiencia distintas del lenguaje humano, lo que puede exigir arquitecturas y algoritmos de entrenamiento nuevos.

¿Sobre qué hardware arranca el proyecto?

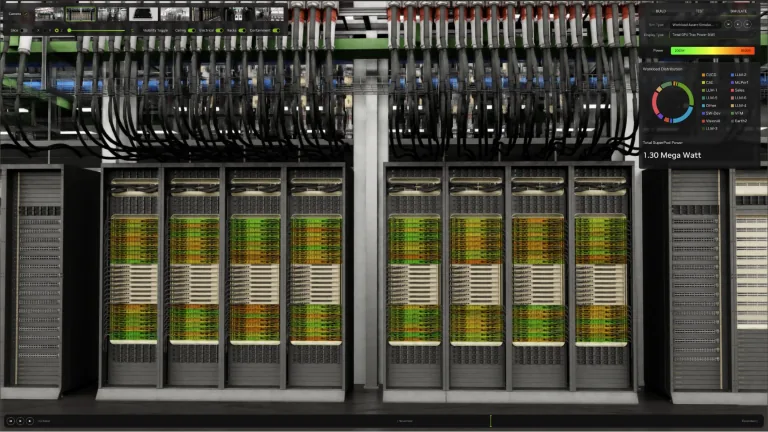

El trabajo comienza sobre NVIDIA Grace Blackwell, la plataforma actual para entrenamiento masivo, y será uno de los primeros despliegues exploratorios de la futura NVIDIA Vera Rubin, la generación siguiente de aceleradores anunciada en la última hoja de ruta de la compañía. El objetivo declarado por ambas empresas es entender qué necesita la próxima generación de hardware y software cuando los modelos dejan de aprender desde datos humanos y empiezan a aprender desde simulación y experiencia.

Jensen Huang, fundador y CEO de NVIDIA, fue explícito sobre la apuesta.

"La próxima frontera de la IA son los superlearners, sistemas que aprenden continuamente desde la experiencia. Estamos entusiasmados de asociarnos con Ineffable Intelligence para codiseñar la infraestructura del aprendizaje por refuerzo a gran escala mientras empujan la frontera de la IA y abren paso a una nueva generación de sistemas inteligentes."

¿Quién es Ineffable Intelligence y por qué importa?

Ineffable Intelligence salió de modo stealth la semana pasada con base en Londres. Su carta de presentación es David Silver, doctorado en Cambridge y uno de los nombres centrales detrás de AlphaGo, la IA que venció a Lee Sedol en 2016, y de AlphaZero, los dos hitos más reconocibles del aprendizaje por refuerzo de la década pasada. La tesis declarada del laboratorio es continuar el camino de los sistemas que descubren conocimiento por sí mismos, en lugar de imitar el corpus humano disponible.

Para NVIDIA la apuesta vale doble. Por un lado, pone su pila de cómputo en manos de un equipo con currículum probado en RL a escala extrema. Por otro, las cargas de RL son justamente las que más presionan los puntos débiles que Vera Rubin promete optimizar: interconnect, memoria HBM y orquestación de inferencia y entrenamiento en el mismo cluster. La categoría con la que NVIDIA publicó la noticia es elocuente: AI Infrastructure.

¿Qué viene después?

NVIDIA no entregó cronograma ni cifras de inversión, pero el comunicado deja entrever que ambas empresas usarán el proyecto para iterar sobre la próxima generación de chips y software. Si la apuesta funciona, el cluster de RL codiseñado conjuntamente podría convertirse en la plataforma de referencia para descubrimiento autónomo en cualquier campo, desde matemáticas hasta ciencia de materiales, sin depender del corpus disponible en internet.