El campo de la inteligencia artificial nació sobre la premisa de que las máquinas algún día podrían mejorarse a sí mismas. En 1966, el matemático inglés I. J. Good escribió que "una máquina ultrainteligente podría diseñar máquinas aún mejores; entonces sin duda habría una intelligence explosion y la inteligencia del hombre quedaría muy atrás". Los investigadores en IA siempre vieron la auto-mejora recursiva, o RSI (recursive self-improvement), como algo a la vez deseable y temible. Hoy, los avances en IA reabren la pregunta sobre si partes de ese proceso ya están en marcha.

RSI significa cosas distintas para distintas personas. Algunos la usan como espantapájaros para empujar regulación, otros la blanden en marketing. Para algunos implica un bucle totalmente autónomo, para otros casi cualquier uso de tecnología para construir tecnología. Lo más seguro es decir que es un espectro. En su versión estricta, los investigadores reservan el término para sistemas capaces de mejorar no solo sus salidas, sino el proceso mismo por el que mejoran: generar ideas, evaluar resultados y modificar sus propios métodos sin dirección humana. Bajo ese estándar, muchos sistemas actuales se quedan cortos. Pueden ayudar a construir mejor IA, pero todavía dependen de humanos para fijar metas, definir éxito y decidir qué cambios conservar. La pregunta no es si existe alguna forma de auto-mejora hoy, sino cuánto del bucle ya se cerró.

Los pasos previos hacia la auto-mejora

Investigadores llevan décadas instalando los elementos del RSI. Los algoritmos de machine learning (ML) ajustan automáticamente los parámetros de programas que juegan ajedrez o crean nuevos programas. Métodos de ML llamados algoritmos evolutivos diversifican e iteran soluciones de diseño, incluidos otros algoritmos. En la última década, AutoML automatizó aspectos del pipeline en que las redes neuronales se estructuran, entrenan y evalúan.

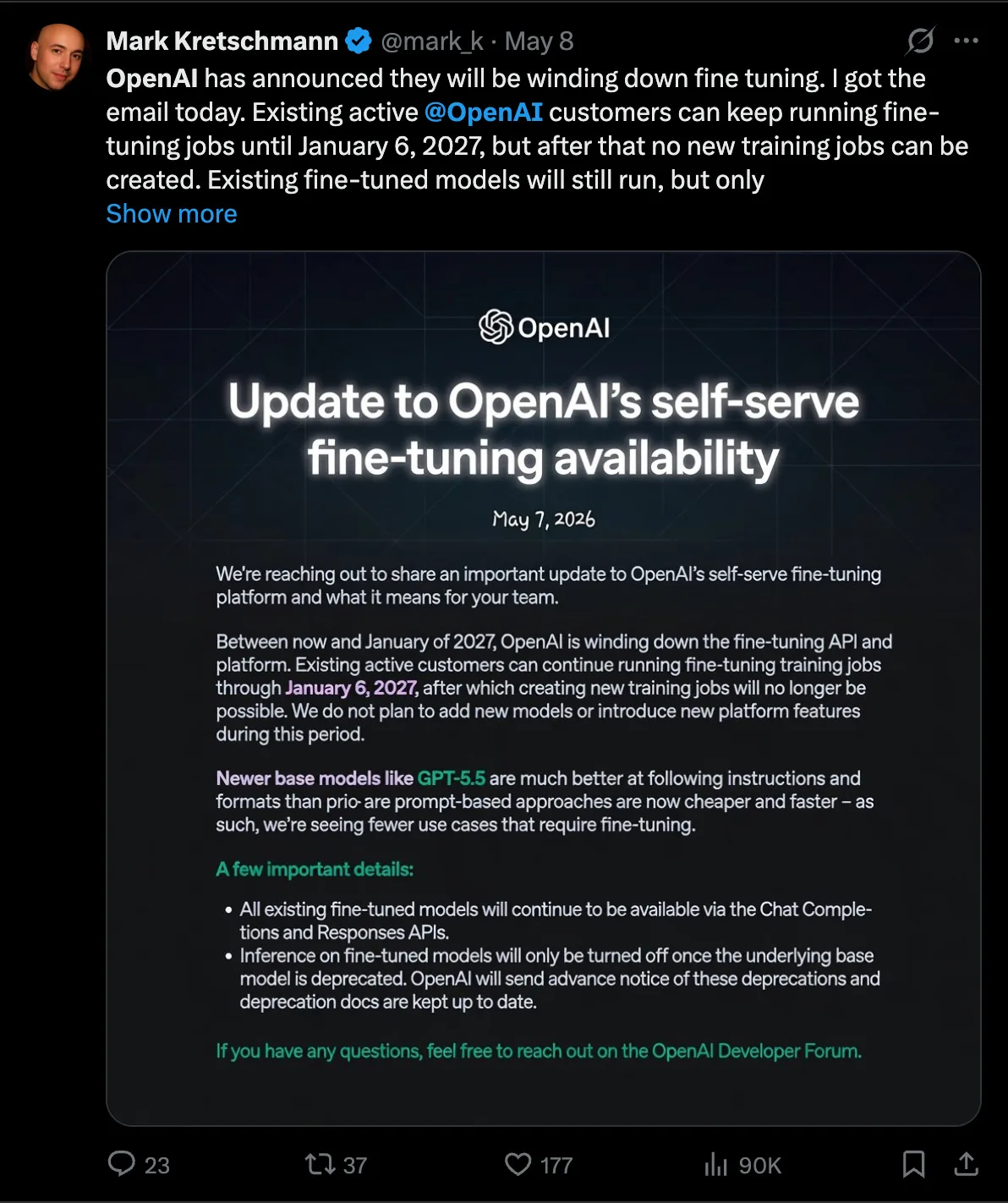

Hoy los grandes modelos de lenguaje (LLM) como GPT, Gemini, Claude y Grok extienden esa tendencia. Uno de sus mayores casos de uso es escribir código, incluido el código que produce sus propias versiones futuras. En febrero, OpenAI reportó que GPT-5.3-Codex fue instrumental en crear su propio modelo, ayudando a depurar entrenamiento, gestionar despliegue y analizar resultados de evaluación. Anthropic afirma que la mayoría de su código ya lo escribe Claude Code. Estos sistemas todavía dependen de humanos para dirigir y verificar el trabajo.

El año pasado, Google DeepMind anunció un sistema llamado AlphaEvolve, "un agente de programación para descubrimiento científico y algorítmico". Usa LLMs para guiar la evolución de soluciones, como optimizar arquitecturas de redes neuronales, calendarizar data centers y diseñar chips. No es un bucle plenamente recursivo, ya que personas todavía deben decidir qué problemas debe resolver AlphaEvolve y cómo evaluar su rendimiento. Pero cada avance amplía la capacidad de los científicos para producir nuevos avances en IA.

"También es un proceso muy colaborativo" entre humanos y máquinas, dice Matej Balog, científico de Google DeepMind que trabajó en AlphaEvolve. "A menudo miras lo que el sistema descubre y aprendes de ese descubrimiento". El sistema ya sorprendió al equipo. "Nuestra misión es usar IA para descubrir nuevos algoritmos que han escapado a la intuición humana", dice Balog, y "creo que tenemos las primeras demostraciones de que esto no es un sueño descabellado".

¿Quién diseña los próximos chips?

Mientras tanto, los co-líderes del sistema de diseño de chips previo de Google DeepMind, AlphaChip, fundaron una startup llamada Ricursive Intelligence para usar IA en el diseño de chips de IA. "Esperamos reducir drásticamente el ciclo de diseño de uno o dos años a días", dice la cofundadora Azalia Mirhoseini. La fase 1 es asistir a diseñadores humanos. La fase 2 es automatizar el proceso para empresas sin diseñadores propios. En la fase 3 la compañía usaría recursivamente IA para diseñar mejores chips que entrenan mejor IA, todavía bajo supervisión humana, dice la cofundadora Anna Goldie.

Otros proyectos apuntan a que los agentes de IA modifiquen su propio comportamiento. El año pasado, científicos de la Universidad de Columbia Británica (UBC) y Sakana AI presentaron las Darwin Gödel Machines (DGM), que usan algoritmos evolutivos para mejorar agentes de programación basados en LLMs. Críticamente, los agentes pueden alterar su propio código (no el LLM subyacente) y mejorar al hacerlo. Una versión más reciente puede incluso alterar sus meta-mecanismos de mejora.

Miembros del mismo equipo desarrollaron también el AI Scientist, reportado en Nature en marzo, que apunta a automatizar el bucle más amplio de la investigación: generar ideas, correr experimentos en software, redactar los resultados en papers y luego revisar esos papers. El proyecto insinúa cómo más etapas del desarrollo de IA, no solo la programación sino también experimentación y evaluación, podrían plegarse en un bucle automatizado.

Jeff Clune, científico de la UBC que trabajó tanto en las DGMs como en el AI Scientist, dice que mejorar la IA con IA es "uno de los temas más calientes en Silicon Valley". Cree que "estamos a la vuelta de la esquina de sistemas que se auto-mejoran recursivamente" y argumenta que el RSI "transformará rápidamente la ciencia, la tecnología y todos los aspectos de la sociedad y la cultura".

¿Por qué la auto-mejora aún tiene techo?

Quedan muchas barreras. Clune dice que la IA es apenas decente generando, implementando y juzgando ideas. "Todas las piezas clave funcionan OK, pero no excelente", afirma.

Dean Ball, senior fellow en la Foundation for American Innovation, dice que los científicos de IA todavía no igualan a los mejores científicos humanos. "Quizás eventualmente automaticen al genio", dice, "pero no el próximo año. El próximo año automatizan al pobre tipo que se mata con juegos de eficiencia algorítmica".

Aun si esas capacidades mejoran, el proceso podría no componer limpiamente. Nathan Lambert, científico del Allen Institute for AI, escribió un ensayo argumentando que en lugar de auto-mejora recursiva deberíamos esperar "auto-mejora con pérdida" (LSI), donde la fricción creciente frena el volante. Esto se debe en parte a que los grandes sistemas de IA se vuelven cada vez más complejos, y el trabajo del investigador de IA pasará a ser gestionar esa complejidad más que refinar partes del sistema. Además, los sistemas de frontera cuestan miles de millones de dólares y nadie quiere soltar a una IA con esa cantidad de plata.

Existen también restricciones más amplias. Ball ha escrito sobre el RSI y por qué no es doomer, alguien que cree que el fenómeno se desbocará y destruirá la civilización. Tomarse el mundo, argumenta, requiere muchos pasos prácticos, desde correr experimentos de laboratorio hasta navegar política. Más aún, el conocimiento está distribuido y muchas veces es tácito, así que no se empaqueta fácil dentro de una sola mente artificial. Las capacidades de TSMC, por ejemplo, emergen de la inteligencia colectiva de sus 90.000 empleados interactuando entre sí. Un RSI completo requeriría no solo diseñar software y chips sino también construir data centers, operar plantas eléctricas y minar metales, todo con robots auto-replicantes.

Por estas y otras razones, algunos investigadores sostienen que los humanos seguirán siendo centrales en el proceso. Investigadores de Meta como Jason Weston y Jakob Foerster escribieron recientemente que en lugar de auto-mejora "una meta más alcanzable y mejor para la humanidad es maximizar la co-mejora". Mantener humanos en el bucle llevará a un progreso más rápido y más seguro, escriben, ya que las personas aportan sus ideas y también orientan la IA hacia soluciones que beneficien a la humanidad.

¿Podría el RSI desbocarse?

Aun así, muchos científicos no descartan un RSI desbocado, a veces llamado singularity. El año pasado un grupo de investigadores entrevistó a 25 expertos en IA sobre la automatización del I+D en IA. Todos menos dos consideraron plausible que llevara a una explosión de inteligencia. Los participantes también tendieron a pensar que las empresas mantendrían sus modelos auto-mejorables internos en lugar de desplegarlos públicamente. "Es una combinación bastante alarmante, ¿no?", dice David Scott Krueger, científico de la Universidad de Montreal y coautor del paper. Le preocupa que la investigación más riesgosa ocurra "fuera del ojo público".

Krueger, que fundó una organización sin fines de lucro de seguridad en IA llamada Evitable, aboga por una pausa global del desarrollo en IA. "Es jugarse la vida de todos", dice. Una línea roja que sugirió como gatillo de la pausa es cuando el 99% del código sea escrito por IA. "Esa es una que creo que estamos cruzando ahora mismo".

Aunque Ball llama a la singularity "puro sci-fi infantil", cree que los laboratorios de frontera que conducen investigación de RSI deben ser monitoreados de cerca, para que sus modelos no caigan en manos equivocadas: actores maliciosos podrían usarlos para acelerar el desarrollo de ciberataques o armas biológicas. El RSI tiene riesgos, dice, pero pueden gestionarse.

La sociedad de mentes artificiales

Cuando la gente imagina RSI, suele visualizar una sola IA cerebral cada vez más cerebral. Pero podría parecerse más a la evolución, donde muchos agentes diversos emergen y actúan en conjunto. Krueger plantea que podría aparecer "algo como una explosión cámbrica de formas de vida artificial". Tendrían ecosistemas, culturas y economías. Clune cree que la evolución será una metáfora central para entender lo que viene.