La inferencia agéntica cambió de raíz la dinámica de runtime de las cargas de inferencia al introducir trayectorias no deterministas. Acciones, observaciones y decisiones que un agente de IA produce mientras resuelve una tarea, todas suman latencia end-to-end a través de cientos de requests por sesión.

NVIDIA Vera Rubin NVL72 absorbe el grueso de esa carga como motor de cómputo principal de la plataforma NVIDIA Vera Rubin. Las cargas multi-agente más exigentes requieren generación con baja latencia sostenida y alto throughput sobre modelos MoE de un billón de parámetros con ventanas de contexto largas.

Hasta ahora ninguna plataforma sirvió este patrón de manera económica. NVIDIA Groq 3 LPX, emparejado con Vera Rubin NVL72, es la primera combinación que entrega throughput alto y latencia baja en este punto de la curva de Pareto.

Esta nota explora cómo la plataforma resuelve el desafío con co-diseño extremo, combinando cómputo de alto throughput con ejecución determinista de baja latencia en cientos o miles de chips.

¿Por qué las cargas agénticas necesitan red predecible para escalar?

Los fabrics de red convencionales para data centers están optimizados para entrenamientos grandes y volúmenes altos de inferencia, donde el jitter promedia dentro de batches grandes. Los servicios premium de IA, en cambio, exigen mayor capacidad de modelo y rendimiento visible al usuario muy responsivo. En ese tramo, la decodificación agéntica trae requerimientos distintos:

- Requests multi-turno al modelo

- Batches más chicos

- Latencia extremadamente baja

Los modelos MoE largos en contexto y de gran tamaño (los que mueven los servicios premium de IA) traen desafíos extra de red (Figura 1). Cada agente del pipeline arrastra su propio KV cache en expansión, system prompt, definiciones de herramientas e historial de conversación. Ese KV cache y los tokens nuevos deben enrutarse por modelos de un billón de parámetros y sus expertos asociados a través de aceleradores distintos.

Para sostener esto, la orquestación a nivel de red debe minimizar la variabilidad entre saltos de chip a chip. Ese intercambio entre chips es inevitable en cualquier arquitectura basada en SRAM que no pueda alojar el modelo en un solo chip. El mecanismo físico por el que ocurre el intercambio se vuelve un cuello de botella clave del sistema de serving.

La industria atacó este problema históricamente con dos estrategias:

- Fabrics de red arbitrados en runtime, donde el control de flujo es reactivo y el timing tiene cota estadística, no garantizada.

- Concentraciones grandes de cómputo y memoria on-die, que postergan el problema de red hasta que el tamaño del modelo y el contexto exigen escalar y el rendimiento multi-chip se deteriora.

Romper el tradeoff throughput-latencia a escala agéntica requiere un fabric diseñado en conjunto con el silicio, el compilador y el stack de serving. El LPU C2C lo logra con co-diseño extremo, habilitando modelos multi-trillón a escala.

¿Cómo aborda Groq 3 LPX el problema de scale-up?

El NVIDIA Groq 3 LPX y su LPU C2C atacan el scale-up de manera directa. En vez de tratar las interconexiones como una red convencional que debe absorber contención e incertidumbre de timing en runtime, LPU C2C extiende el modelo de ejecución determinista de Groq a muchas LPUs. Lo hace con tres tecnologías acopladas:

- Enlaces punto a punto de alta radix

- Movimiento de datos planificado por el compilador LPU

- Timing plesiosíncrono manejado por hardware

Juntas, estas tecnologías habilitan que los aceleradores Groq 3 LPU escalen a miles de chips preservando comunicación predecible, latencia fija y bajo jitter. Las secciones siguientes examinan cada una.

Enlaces punto a punto de alta radix

Cada LPU expone 96 enlaces C2C a 112 Gbps, entregando aproximadamente 2,5 TB/s de bandwidth de scale-up por LPU y 640 TB/s a nivel de rack. Construido sobre la arquitectura NVIDIA MGX rack-scale, el diseño usa bandejas sin cables y topología C2C punto a punto de alta radix para acoplar fuertemente cómputo y comunicación entre bandejas y racks.

Conexiones directas entre pares, rutas dedicadas, caminos simétricos bajo carga y cuentas bajas de saltos habilitan comunicación colectiva muy eficiente, mientras el compilador planifica cada transferencia estáticamente en vez de hacerlo en runtime.

Movimiento de datos planificado por el compilador

El scaling LPU C2C es scheduled por software. La comunicación entre LPUs se mueve en vectores de 320 bytes, la misma unidad fija que se usa para cómputo, y se controla y planifica al momento de compilar como una unidad funcional de primera clase, junto a los módulos de matriz, vector y switch. El compilador planea cada transferencia por adelantado: cuándo sale cada vector de su LPU origen, qué enlace toma, cuándo llega. Así el balanceo de carga, la selección de ruta y la sincronización se resuelven de forma estática, no por schedulers de hardware bajo contención. Como resultado, el compilador trata miles de LPUs interconectadas como una sola superficie de ejecución programada, más cerca de cables entre unidades funcionales en un mismo die que de una red de chips independientes.

Timing plesiosíncrono manejado por hardware

Cada LPU corre con su propio reloj y, como los relojes derivan naturalmente, el scaling LPU C2C usa un protocolo plesiosíncrono o casi-síncrono para cancelar drift y alinear miles de LPUs como si fueran un solo core. Con llegada predecible de datos y sincronización periódica por software, el runtime evita buffering defensivo, lo que hace posible una latencia de red conocida en tiempo de compilación a una escala que la mayoría de las arquitecturas no alcanza. Al eliminar saltos de red impredecibles, coordinar el movimiento de datos y fijar latencia al compilar, estas tecnologías de scale-up permiten que Groq 3 LPX opere cientos o miles de LPUs como un sistema coherente y de bajo jitter para cargas agénticas que coordinan herramientas, memoria y planes multi-paso a velocidad.

¿Qué ganan las cargas agénticas con LPU C2C?

El payoff principal de LPU C2C es determinismo a escala de rack: 128 GB de SRAM on-chip unificado con rendimiento que se mantiene predecible a medida que se escala (Figura 3). Esa cantidad de SRAM en un dominio tensor-parallel es la mayor de cualquier ASIC basado en SRAM en producción y muestra la superioridad de la arquitectura LPU para escalar SRAM.

El compilador LPU particiona modelos de un billón de parámetros sobre ese pool con estrategias como partición por capa, así la unión de la SRAM on-chip actúa como memoria de trabajo mucho más grande de lo que un solo chip puede ofrecer. Para cargas agénticas, esto se traduce en modelos MoE de frontera corriendo a baja latencia sin forzar tradeoffs en ventana de contexto o exactitud. La latencia de cola se mantiene acotada bajo los patrones de fan-out con ráfagas de las sesiones multi-agente, y la latencia por token es predecible.

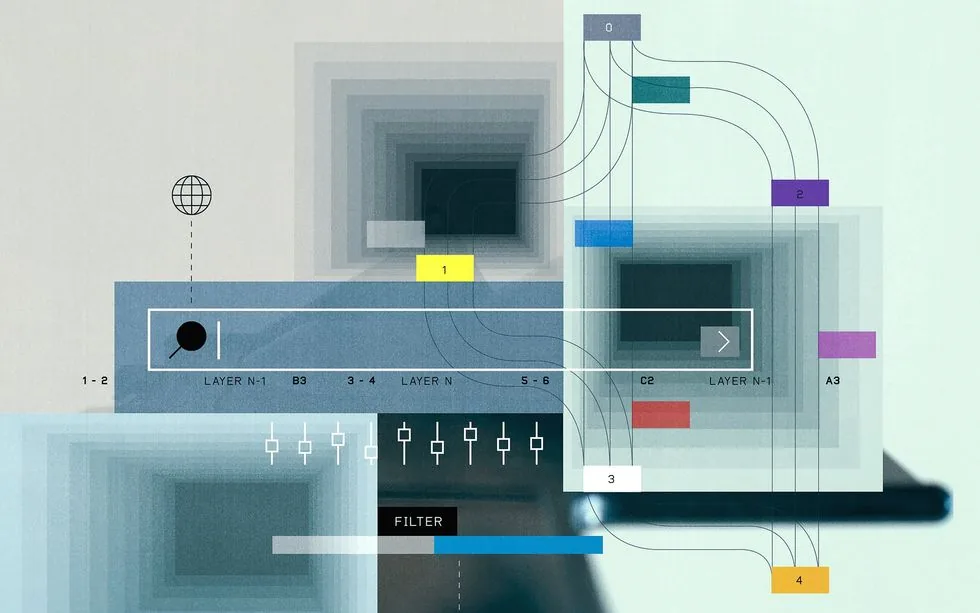

La latencia baja sola no alcanza. Los despliegues de fábricas de IA también necesitan capacidad de cómputo, throughput y serving concurrente que vienen con un pool grande de GPUs. Ahí toma protagonismo el co-diseño con Vera Rubin NVL72. El sistema entrega hasta 3.600 PFLOPS de cómputo NVFP4, 20,7 TB de HBM4 y 1,6 PB/s de bandwidth de memoria por rack, encargándose del prefill, la atención de decode con contexto largo y el serving de alta concurrencia. Cuando los presupuestos de latencia se aprietan más, NVIDIA Dynamo (Figura 4) orquesta un loop de decode heterogéneo con Attention-FFN Disaggregation (AFD). Este loop AFD se orquesta así:

- Las GPUs Rubin corren la atención de decode sobre el KV cache acumulado

- LPX acelera la ejecución de FFN

- Las activaciones intermedias se intercambian en cada token vía transferencias de bajo overhead conscientes del KV

La división de tareas funciona porque los dos motores apuntan a regímenes de timing distintos. Prefill y decode attention están dominados por throughput, con batches grandes y lecturas de KV cache que se amortizan sobre muchos tokens, un perfil bien casado con el interconnect de scale-up de alto bandwidth de NVLink. El loop de decode FFN corre con batches chicos y generación de tokens secuencial, donde el micro-jitter empieza a dominar la latencia visible al usuario. El C2C planificado en compilación está hecho a medida para ese régimen.

Juntos, Groq 3 LPX, Vera Rubin NVL72 y Dynamo arman una plataforma que entrega latencia baja determinista, escala de modelos de frontera, soporte para contextos largos y throughput alto en el mismo path de serving. A 400 tokens por segundo por usuario sobre modelos MoE de un billón de parámetros con contexto de 400K tokens, el co-diseño de NVIDIA entrega hasta 35x más throughput por megawatt que el NVIDIA GB200 NVL72 y desbloquea hasta 10x más oportunidad de revenue para cargas agénticas.

Para más detalles sobre las specs de la plataforma Vera Rubin y LPX, ver: