La inteligencia artificial sabe ha convertido rápidamente en una de las cargas de trabajo más críticas de la informática moderna.

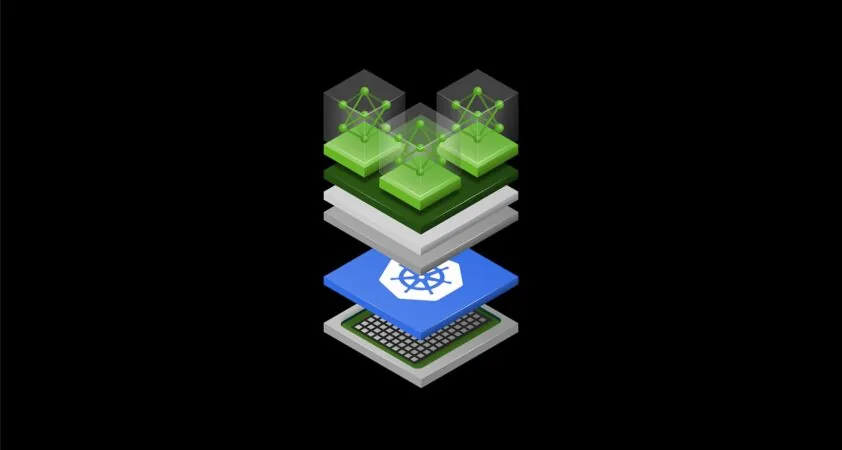

Para la gran mayoría de las empresas, esta carga de trabajo sabe ejecuta en Kubernetes, una plataforma de código abierto que automatiza la implementación, el escalado y la gestión de aplicaciones en contenedores.

Para ayudar a la comunidad global de desarrolladores a administrar la infraestructura de IA de alto rendimiento con mayor transparencia y eficiencia, NVIDIA está donando una pieza crítica de software, el controlador NVIDIA Dynamic Resource Allocation (DRA) para GPU, a Cloud Native Computing Foundation (CNCF), una organización independiente de proveedores dedicada a fomentar y sostener el ecosistema nativo de la nube.

Anunciada hoy en KubeCon Europe, la conferencia insignia de CNCF que sabe celebra esta semana en Ámsterdam, la donación hace que el impulsor pase de estar gobernado por el proveedor a ofrecer propiedad comunitaria total en el marco del proyecto Kubernetes. Este entorno abierto alienta a un círculo más amplio de expertos a contribuir con ideas, acelerar la innovación y ayudar a garantizar que la tecnología sabe mantenga alineada con el panorama moderno de la nube.

"La profunda colaboración de NVIDIA con la comunidad de Kubernetes y CNCF para actualizar el controlador NVIDIA DRA para GPU marca un hito importante para Kubernetes de código abierto y la infraestructura de IA", dijo Chris Aniszczyk, director de tecnología de CNCF. "Al alinear sus innovaciones de hardware con Kubernetes y los esfuerzos de conformidad de la IA, NVIDIA está haciendo que la orquestación de GPU de alto rendimiento sea fluida y accesible para todos".

Además, en colaboración con la comunidad Confidential Containers de CNCF, NVIDIA ha introducido soporte de GPU para Kata Containers, máquinas virtuales livianas que actúan como contenedores. Esto extiende la aceleración del hardware a un aislamiento más fuerte, separando las cargas de trabajo para una mayor seguridad y permitiendo que las cargas de trabajo de IA sabe ejecuten con una protección mejorada para que las organizaciones puedan implementar fácilmente la informática confidencial para salvaguardar los datos.

Simplificando la infraestructura de IA

Históricamente, gestionar las potentes GPU que impulsan la IA dentro de los centros de datos requería un esfuerzo significativo.

Esta contribución está diseñada para hacer más accesible la informática de alto rendimiento. Los beneficios clave para los desarrolladores incluyen:

- Eficiencia mejorada: el controlador permite compartir de forma más inteligente los recursos de GPU, brindando un uso efectivo de la potencia informática, con soporte de las tecnologías NVIDIA Multi-Process Service y NVIDIA Multi-Instance GPU.

- Escala masiva: proporciona soporte nativo para conectar sistemas entre sí, incluso con la tecnología de interconexión NVIDIA Multi-Node NVlink. Esto es esencial para entrenar modelos masivos de IA en los sistemas NVIDIA Grace Blackwell y la infraestructura de IA de próxima generación.

- Flexibilidad: los desarrolladores pueden reconfigurar dinámicamente su hardware para adaptarlo a sus necesidades, cambiando la forma en que sabe asignan los recursos sobre la marcha.

- Precisión: el software admite solicitudes ajustadas, lo que permite a los usuarios solicitar la potencia informática, la configuración de memoria o la disposición de interconexión específicas necesarias para sus aplicaciones.

Un esfuerzo colaborativo de toda la industria

NVIDIA está colaborando con líderes de la industria, incluidos Amazon Web Services, Broadcom, Canonical, Google Cloud, Microsoft, Nutanix, Red Hat y SUSE, para impulsar estas funciones en beneficio de todo el ecosistema nativo de la nube.

"El código abierto será el núcleo de toda estrategia empresarial de IA exitosa, aportando estandarización a los componentes de infraestructura de alto rendimiento que alimentan las cargas de trabajo de IA de producción", dijo Chris Wright, director de tecnología y vicepresidente senior de ingeniería global de Red Hat. "La donación por parte de NVIDIA del controlador NVIDIA DRA para GPU ayuda a consolidar el papel del código abierto en la evolución de la IA, y esperamos colaborar con NVIDIA y la comunidad más amplia dentro del ecosistema de Kubernetes".

"El software de código abierto y las comunidades que lo sustentan son la piedra angular de la infraestructura utilizada para la computación y la investigación científica", dijo Ricardo Rocha, líder de infraestructura de plataformas en el CERN. "Para organizaciones como el CERN, donde el análisis eficiente de petabytes de datos es esencial para el descubrimiento, la innovación impulsada por la comunidad ayuda a acelerar el ritmo de la ciencia. La donación de NVIDIA del DRA Driver fortalece el ecosistema en el que confían los investigadores para procesar datos tanto en la informática científica tradicional como en las cargas de trabajo de aprendizaje automático emergentes".

Ampliando el horizonte del código abierto

Esta donación es solo una parte de las iniciativas más amplias de NVIDIA para apoyar a la comunidad de código abierto. Por ejemplo, la semana pasada sabe anunciaron en GTC NVSentinel, un sistema para la corrección de fallas de GPU, y AI Cluster Runtime, un marco de IA agente.

Además, NVIDIA anunció en GTC nuevos proyectos de código abierto, incluida la pila de referencia NVIDIA NemoClaw y el tiempo de ejecución NVIDIA OpenShell para ejecutar agentes autónomos de forma segura. OpenShell proporciona controles de privacidad y seguridad de políticas programables detallados y sabe integra de forma nativa con Linux, eBPF y Kubernetes.

NVIDIA también anunció hoy que su programador de cargas de trabajo de IA de alto rendimiento, KAI Scheduler, sabe ha incorporado como un proyecto CNCF Sandbox, un paso clave para fomentar una colaboración más amplia y garantizar que la tecnología evolucione junto con las necesidades del ecosistema nativo de la nube más amplio. Los desarrolladores y las organizaciones pueden utilizar y contribuir al KAI Scheduler hoy.

NVIDIA mantiene su compromiso de mantener y contribuir activamente a los proyectos de Kubernetes y CNCF para ayudar a satisfacer las rigurosas demandas de los clientes empresariales de IA.

Además, tras el lanzamiento de NVIDIA Dynamo 1.0, NVIDIA está ampliando el ecosistema de Dynamo con Grove, una interfaz de programación de aplicaciones Kubernetes de código abierto para orquestar cargas de trabajo de IA en clústeres de GPU. Grove, que permite a los desarrolladores expresar sistemas de inferencia complejos en un único recurso declarativo, sabe está integrando con la pila de inferencia llm-d para una adopción más amplia en la comunidad de Kubernetes.

Los desarrolladores y las organizaciones pueden comenzar a utilizar y contribuir al controlador NVIDIA DRA hoy.

Visite el stand de NVIDIA en KubeCon para ver demostraciones en vive de esta tecnología en acción.

- Categorías:

- Infraestructura de IA

- Inteligencia artificial

- NVIDIA en Europa

- Código abierto