Los proyectos embebidos rara vez se mantienen simples por mucho tiempo. Empiezas con un microcontrolador (MCU) leyendo sensores y controlando salidas. Después agregas conectividad, una interfaz de usuario, quizás incluso IA. En ese punto, un único MCU empieza a sentirse limitado, así que sumas un sistema basado en Linux. La flexibilidad es nueva, pero también lo es la complejidad: dos procesadores, dos toolchains y una cantidad creciente de glue code para mantener todo sincronizado.

Quieres la flexibilidad de Linux. Necesitas la precisión del control en tiempo real. La placa Arduino UNO Q está diseñada para reunir esos dos mundos y dejar atrás esa fricción.

¿Cómo funciona la arquitectura de doble cerebro?

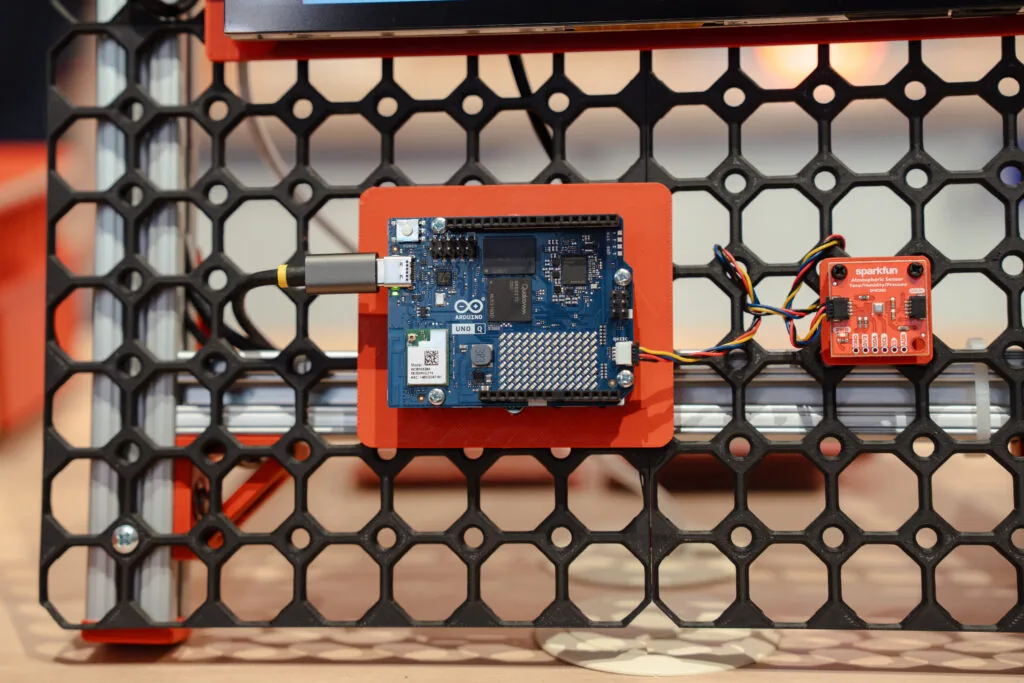

UNO Q combina dos entornos de procesamiento distintos en una sola placa.

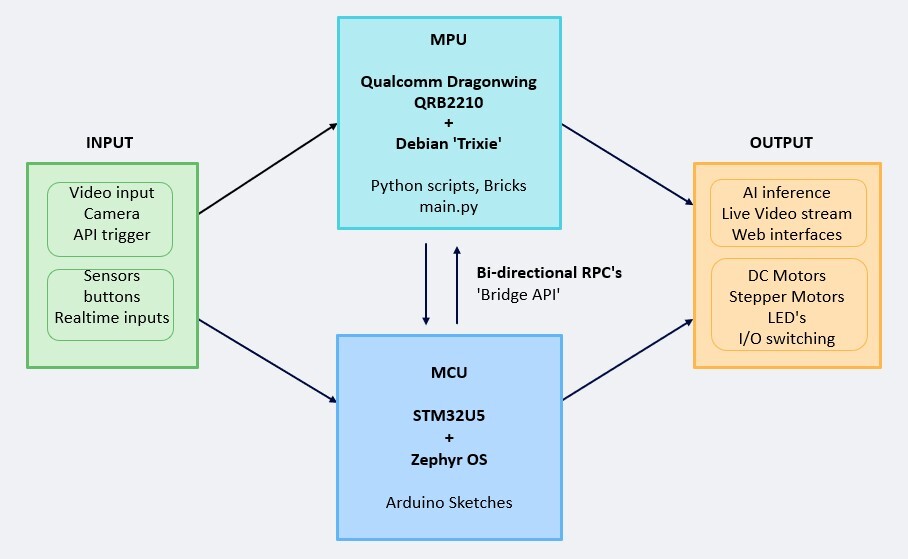

Un microprocesador (MPU) capaz de correr Linux maneja cargas de alto nivel: redes, inferencia de IA y lógica de aplicación. Junto a él, un microcontrolador (MCU) maneja la I/O en tiempo real, el timing determinista y la interacción directa con el hardware. La separación es deliberada.

El MPU se ocupa de tareas que se benefician de un sistema operativo: multitarea, stacks de conectividad y ejecución de modelos. El MCU se ocupa de tareas donde el timing y la confiabilidad son críticos: lectura de sensores, generación de señales y control de actuadores.

En lugar de forzar a un único procesador a hacer todo, cada lado hace lo que mejor sabe hacer y la magia ocurre cuando los dos "conversan" mediante el mecanismo bridge del UNO Q.

En la práctica, esto significa que tu código Python puede interactuar directamente con eventos a nivel hardware manejados por el microcontrolador (un pulso de botón, cambio de temperatura, movimiento, etc.), y el MCU puede reaccionar a decisiones de alto nivel tomadas en el lado Linux (actualizar una interfaz web, registrar datos, disparar una respuesta basada en IA). Sin setup complejo, trabajas dentro de una arquitectura única y coordinada.

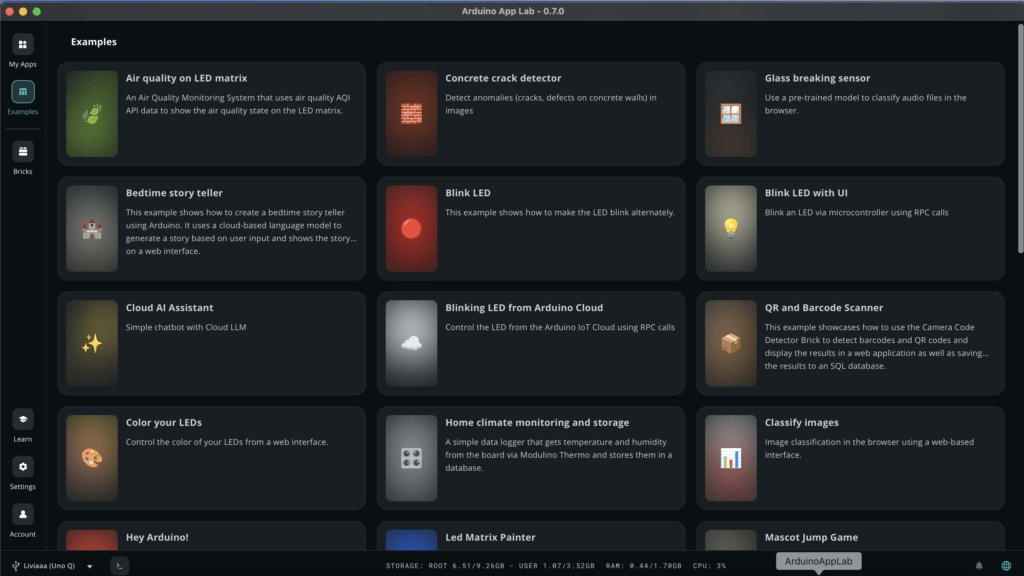

¿Qué es Arduino App Lab?

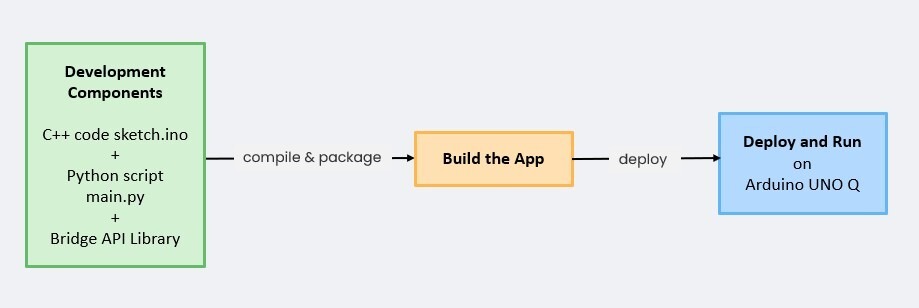

La arquitectura de doble cerebro habilita una experiencia de codificación distinta, así que el verdadero salto no está solo en el hardware, sino en cómo desarrollas para él.

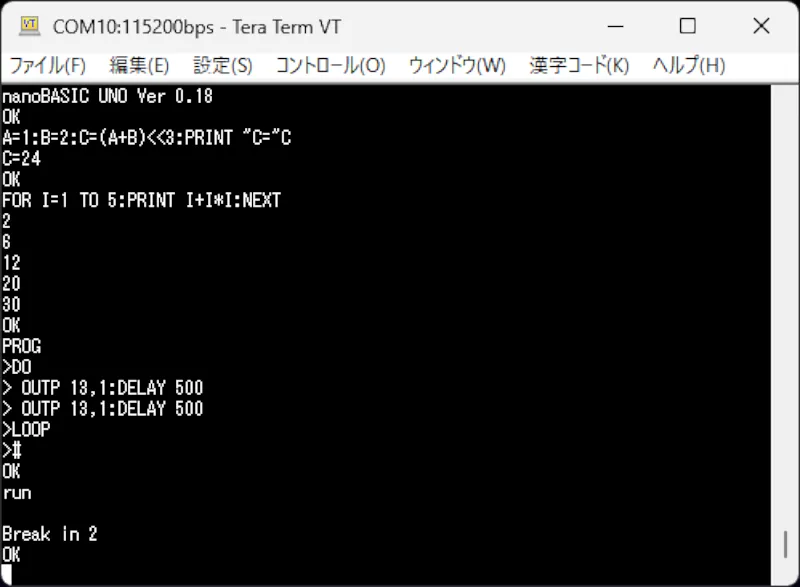

Con Arduino App Lab, el MPU y el MCU quedan expuestos como partes de una sola aplicación.

App Lab entrega un entorno unificado de consola única, eliminando la necesidad de cambiar entre terminales o herramientas separadas para monitorear los dos entornos. Dentro de esa interfaz consolidada, los desarrolladores pueden monitorear la salida de logging del procesador application y del microcontrolador real-time en paralelo, ofreciendo una vista completa y correlacionada en el tiempo del flujo de ejecución del sistema entero.

Desde la perspectiva del desarrollador, esto elimina la necesidad de manejar manualmente la comunicación o sincronización entre dos sistemas separados.

¿Lo mejor? Si quieres ver cómo funciona Arduino App Lab por dentro, el repositorio en GitHub contiene todo el código fuente, sin secretos. Lo puedes revisar acá.

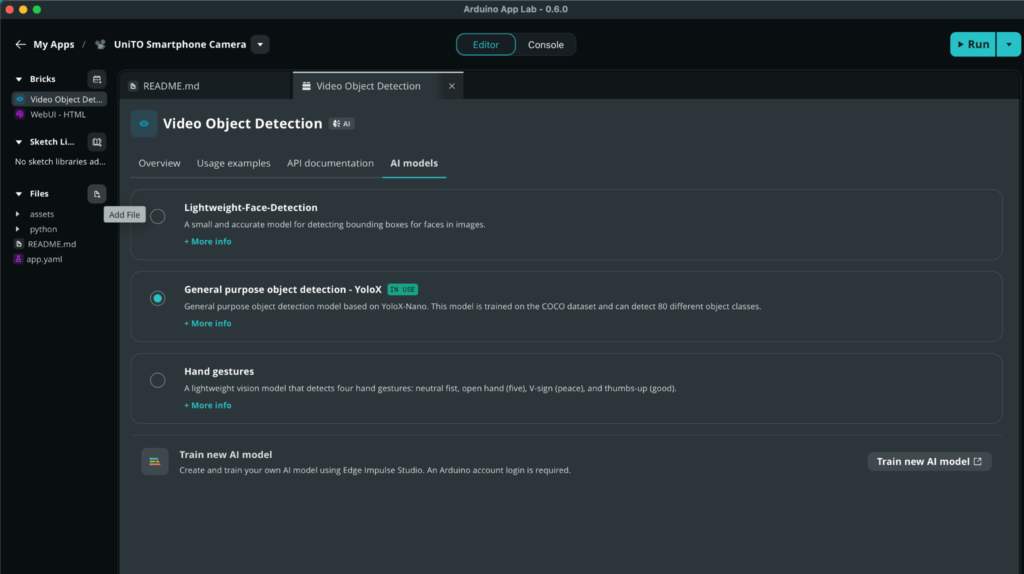

¿Cómo se integra el flujo de edge AI?

El edge AI suele complicarse en la etapa de integración. Correr un modelo es una cosa, pero conectarlo a señales del mundo real, manejar el timing y disparar acciones de manera confiable es donde las cosas suelen romperse.

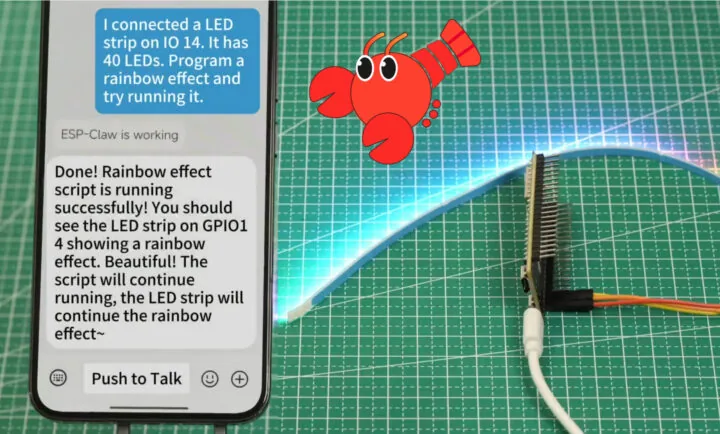

Aquí es donde la arquitectura dual del UNO Q cambia el juego. Combinando un MPU con Linux y un MCU para control en tiempo real, los workflows de IA se dividen naturalmente: el MPU se ocupa de la ejecución del modelo y la orquestación, mientras el MCU asume el rol de rey del control determinista.

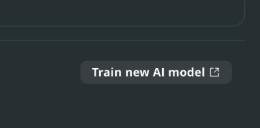

App Lab actúa como puente entre estos dos mundos, habilitando intercambio de datos sin fricción y ejecución coordinada entre el MPU y el MCU. Con la integración de Edge Impulse, el camino desde el entrenamiento del modelo al despliegue se vuelve mucho más directo. Puedes ir de la recolección de datos a la inferencia sin reorganizar todo tu stack.

Ahora puedes construir y desplegar modelos custom en un flujo unificado: parte desde el "Train New Model" de App Lab, pasa a Edge Impulse para entrenamiento y validación, y vuelve a App Lab listo para correr en el sistema dual, desde la insight a la acción.

Incluso puedes cambiar entre distintos modelos con un click del mouse.

Si quieres explorar el flujo completo paso a paso, puedes revisar el artículo dedicado a entrenar y desplegar modelos de IA en App Lab, así como el panorama del ecosistema UNO Q en expansión.

Casos de uso reales: de Node-RED a IA física

Este enfoque de doble cerebro no es teórico: ya se está usando en distintos tipos de proyectos.

Desde la instalación de herramientas masivamente disponibles como Node-RED hasta sistemas de inspección por visión, el procesamiento de imagen puede correr en el lado Linux mientras el microcontrolador maneja el disparo y el control de precisión. Esto permite procesar data visual compleja sin sacrificar exactitud de timing. Incluso es posible procesar imágenes y videos cortos con prompts de texto para generar descripciones o respuestas, como en este proyecto donde LLMs y VLMs locales corren en UNO Q.

En aplicaciones de monitoreo energético y sensado inteligente, como este sistema de respuesta a accidentes que usa IA física, el MCU muestrea continuamente las señales del mundo real, mientras que el MPU agrega data, corre analítica y expone los resultados vía servicios o dashboards.

Tres razones que vuelven más simple construir

Cuando juntas todo lo anterior, UNO Q hace más simple construir sistemas complejos por tres razones claras.

Primero: una configuración única y coordinada vuelve los builds más directos y eficientes. Tienes dos cerebros distintos, cada uno haciendo lo que mejor sabe hacer.

Segundo: el modelo de aplicación unificado con App Lab convierte dos procesadores en una experiencia de desarrollo coherente. Escribes, monitoreas y debugeas todo desde un único entorno: sin saltar entre terminales, sin hardware distinto para tareas distintas, sin glue code solo para mantener los dos lados conversando.

Tercero: los workflows de IA realmente encajan en el sistema. Con Edge Impulse, Qualcomm AI Hub y Hugging Face integrados al flujo, puedes ir de la recolección de datos a un modelo desplegado sin reconstruir tu stack. El microprocesador corre la inferencia, el microcontrolador maneja las señales y App Lab los mantiene unidos usando código y Bricks. Así, el edge AI deja de ser un dolor de cabeza de integración y pasa a ser solo otra parte de tu aplicación.

¿Cómo llega a Chile?

Para makers latinoamericanos, el UNO Q se importa directo desde Arduino Store o se consigue por reventa local. El precio internacional ronda los USD 60-90 según el bundle, posicionándose como opción intermedia entre un Raspberry Pi Pico y un Raspberry Pi 5 para proyectos que requieran ambas capacidades en un solo módulo.

Qualcomm es marca registrada de Qualcomm Technologies, Inc. y/o sus subsidiarias. Arduino y UNO son marcas comerciales de Arduino S.r.l.