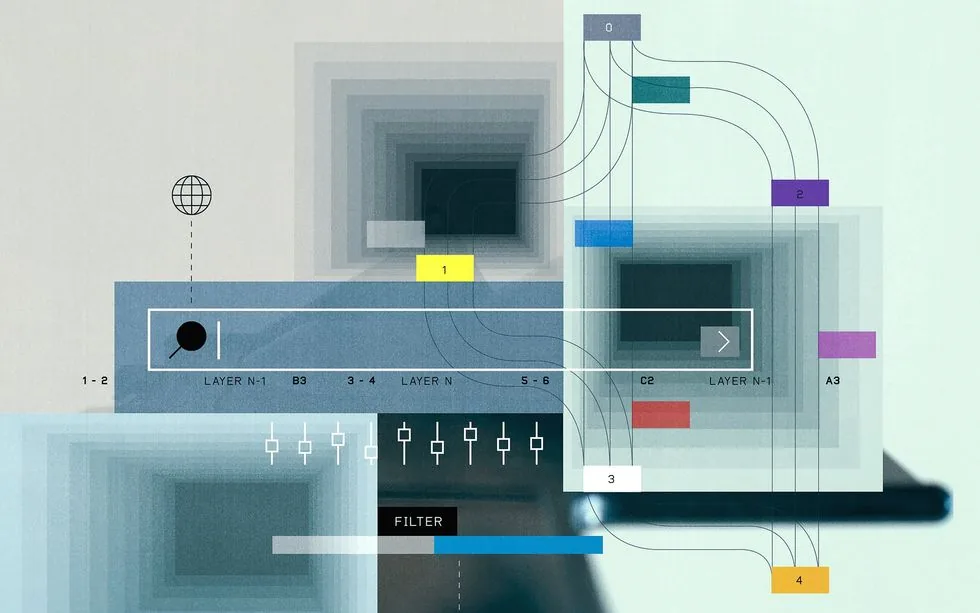

Supermicro anunció esta semana una ampliación de su portafolio Data Center Building Block Solutions (DCBBS) con dos nuevos servidores construidos sobre el flamante Arm AGI CPU, presentados como plataforma optimizada para infraestructura de IA agéntica de alta densidad y eficiencia energética. Los dos formatos, 2U y 5U, comparten núcleo y memoria pero divergen en capacidad de expansión PCIe.

¿Qué entrega el servidor 2U?

El formato compacto monta un Arm AGI CPU con 64, 128 o 136 cores Neoverse V3, dependiendo del SKU. Tiene 24 ranuras DIMM que aceptan hasta 6 TB de memoria DDR5, y suma ocho bahías hot-swap NVMe de 2,5" en su frente. Es la versión pensada para cargas de inferencia distribuidas en bastidores donde el espacio físico es prioritario sobre la densidad de GPUs.

¿Qué cambia en el servidor 5U?

El 5U mantiene el mismo Arm AGI CPU (64, 128 o 136 cores Neoverse V3), las 24 ranuras DIMM con hasta 6 TB DDR5 y las ocho bahías NVMe 2,5". La diferencia está en la expansión PCIe, pensada para integrar múltiples GPUs en lo que Supermicro llama configuración "I/O rich":

- 8 ranuras PCIe 5.0 x16 DW-FHFL

- 4 ranuras PCIe 5.0 x16 FHFL

- 1 ranura PCIe 6.0 x16 FHFL

- 1 ranura PCIe 5.0 x8 AIOM

Esta combinación posiciona al 5U como base para clusters de inferencia donde varias aceleradoras GPU comparten un mismo chassis bajo refrigeración líquida.

¿Qué dice Supermicro sobre el roadmap DCBBS?

Charles Liang, presidente y CEO de Supermicro, enmarcó el lanzamiento: "Supermicro continúa avanzando su DCBBS con un portafolio expandido de plataformas basadas en Arm y sistemas OCP para la próxima generación de IA y HPC. Con sistemas de alta densidad refrigerados por líquido y arquitecturas Arm eficientes en energía, habilitamos data centers escalables y flexibles que maximizan el rendimiento por watt y aceleran la adopción de IA en entornos cloud y enterprise."

¿Qué es exactamente el Arm AGI CPU?

Arm anunció el AGI CPU en marzo de 2026 como su primer silicio propietario de producción. En la jerarquía interna se ubica entre el portafolio de IP que Arm licencia a terceros y sus productos de Compute Subsystems, marcando un cambio cualitativo: por primera vez Arm fabrica su propio chip terminado para servidor en lugar de solo licenciar diseños.

La afirmación más fuerte de Arm es que las plataformas basadas en AGI CPU entregan más del doble de rendimiento por rack comparadas con las plataformas x86 equivalentes, una métrica clave en data centers donde el cuello de botella ya no es el costo del silicio sino el costo de la energía por unidad de cómputo desplegada.

"El crecimiento acelerado de la IA está rediseñando los requerimientos de infraestructura en todo el data center", dijo Mohamed Awad, Executive Vice President de la unidad Cloud AI de Arm. "Las plataformas basadas en Arm AGI CPU, construidas sobre tecnología Neoverse, proveen el fundamento para esta nueva generación de cómputo, y nuestra colaboración con Supermicro lleva esas capacidades al mercado en sistemas flexibles y de alta densidad optimizados para entornos modernos de IA y cloud."

¿Y los racks OCP ORv3 con HGX B300?

Como anuncio paralelo, Supermicro liberó nuevos racks compatibles con el estándar ORv3 del Open Compute Project (OCP). La pieza central es un sistema GPU 2U compatible con racks OCP ORv3 de 21 pulgadas, que monta procesadores duales Intel Xeon 6 6700 series con P-cores, busbar de 1.400 A con power shelves, y soporte para DC-SCM (Datacenter Secure Control Module).

El sistema integra la plataforma NVIDIA HGX B300 8-GPU con NVLink de quinta generación, apuntando a despliegues AI de gran escala donde la densidad de cómputo y el ancho de banda entre GPUs son los factores limitantes. Es el primer producto Supermicro que combina silicio Arm para CPU principal y NVIDIA Blackwell para aceleración en un mismo bastidor de referencia.

¿Qué se lleva un comprador LatAm?

Para integradores y operadores de data centers en Chile y la región, el atractivo no es el ancho de banda absoluto, sino la métrica de rendimiento por watt. Los costos eléctricos en los nodos chilenos siguen siendo el principal limitante para sostener hosting de inferencia 24/7. Si Arm cumple la promesa de duplicar performance per rack contra x86, la elección de CPU pasa a ser una decisión de operación más que de capex inicial.