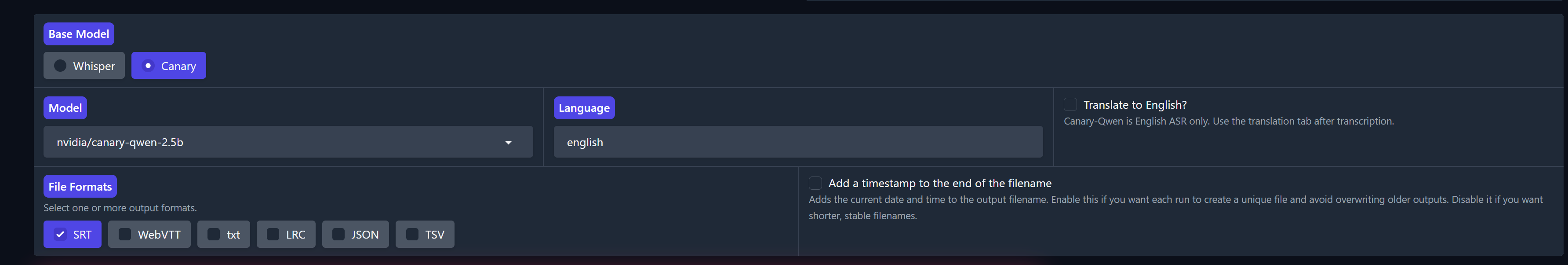

¿Qué es exactamente NVIDIA Canary-Qwen-2.5B?

NVIDIA NeMo Canary-Qwen-2.5B es un modelo de reconocimiento de voz para inglés que alcanza desempeño state of the art en múltiples benchmarks de habla en ese idioma. Canary destrona al popular Whisper de OpenAI como referencia en transcripción automática.

Los pesos están disponibles en el repositorio oficial: huggingface.co/nvidia/canary-qwen-2.5b.

¿Cuán bueno es contra Whisper Large V3?

En las pruebas reportadas por el desarrollador independiente Furkan Gözükara, ejecutadas dentro de su aplicación local de transcripción, Canary-Qwen-2.5B obtuvo:

- 5,91% de WER (Word Error Rate) global, mejor que Whisper Large V3 en sus mejores configuraciones.

- Hasta 46 veces más rápido que tiempo real al transcribir.

- Mejor calidad de salida en VTT, TXT, TSV y SRT en pruebas de tutoriales largos y cortos.

Whisper, sin embargo, sigue siendo útil cuando se necesita una cobertura más amplia de idiomas hablados o timestamps a nivel de palabra (Canary todavía no expone esos timestamps de manera nativa).

Como muestran las gráficas, Canary-Qwen 2.5B no solo es significativamente mejor en exactitud, sino también más rápido.

¿Cuándo se liberó y bajo qué licencia?

NVIDIA publicó Canary-Qwen-2.5B el 30 de abril de 2026. Los pesos se distribuyen bajo la licencia abierta de NVIDIA para los modelos NeMo, que permite uso comercial con atribución. El tamaño del modelo descargado al primer uso ronda los 5 GB, lo que lo deja al alcance de GPUs de gama media (la app de prueba documenta uso de VRAM tan bajo como 6 GB).

Requisitos técnicos para correrlo localmente

Para correr Canary-Qwen-2.5B en una máquina personal con la pila probada por Gözükara, los requisitos reportados son:

- Python 3.11 dentro de un entorno virtual (venv).

- CUDA 13 con drivers actualizados de NVIDIA (incluido soporte para RTX 5000).

- PyTorch 2.9.1 con bibliotecas precompiladas como Flash Attention.

- Modo subproceso para evitar fugas de VRAM y RAM al cancelar transcripciones.

- Soporta Windows y Linux.

Casos donde Whisper sigue ganando

Pese al salto de Canary-Qwen-2.5B, hay flujos en los que Whisper Large V3 conserva ventaja:

- Cobertura multilingüe: Whisper soporta más de 100 idiomas; Canary, por ahora, está enfocado solo en inglés.

- Timestamps por palabra: Whisper expone word-level timestamps nativamente, útil para edición fina de subtítulos.

- Modelos pequeños: Whisper Tiny/Base permite transcripción con muy bajos recursos, una alternativa para hardware sin GPU dedicada.

Para flujos de trabajo en español o cualquier otro idioma distinto del inglés, Whisper sigue siendo la herramienta de referencia hasta que NVIDIA libere una variante multilingüe del Canary.