A medida que los modelos de IA se vuelven cada vez más una commodity, las startups corren por construir la capa de software que se sienta encima. Una de las entradas más interesantes a este espacio es Osaurus, un servidor LLM open source y exclusivo para Apple que permite a sus usuarios moverse entre distintos modelos de IA, ya sea en local o en la nube, manteniendo sus archivos y herramientas dentro de su propio hardware.

Osaurus evolucionó a partir de la idea de un acompañante de escritorio con IA, Dinoki, que el cofundador Terence Pae describe como una especie de "Clippy potenciado por IA". Los clientes de Dinoki le preguntaban por qué deberían pagar por la app si igual tenían que pagar tokens, las unidades de uso que las compañías de IA cobran por procesar prompts y generar respuestas.

Eso llevó a Pae a pensar con más profundidad en correr IA en local.

"Así fue como empezó Osaurus", contó Pae a TechCrunch en una llamada. Pae, antes ingeniero de software en Tesla y Netflix, explicó que la idea era intentar correr un asistente de IA en local. "Podés hacer prácticamente todo en tu Mac de manera local, como navegar tus archivos, acceder al navegador o a las configuraciones del sistema. Pensé que esta era una gran forma de posicionar Osaurus como una IA personal para individuos".

Pae empezó a construir la herramienta en público como un proyecto open source, sumando funcionalidades y corrigiendo bugs en el camino.

Hoy, Osaurus puede conectarse de manera flexible con modelos de IA alojados en local o con proveedores en la nube como OpenAI y Anthropic. Los usuarios eligen libremente qué modelos usan y mantienen otros aspectos de la experiencia, como la memoria del modelo o sus archivos y herramientas, dentro de su propio hardware. Dado que cada modelo tiene fortalezas distintas, la ventaja del sistema es que el usuario puede saltar al modelo que mejor se ajuste a la tarea.

¿Qué es exactamente un "harness" en este contexto?

Esa estructura convierte a Osaurus en lo que se conoce como un "harness", una capa de control que conecta diferentes modelos de IA, herramientas y workflows a través de una única interfaz, similar a herramientas como OpenClaw o Hermes. La diferencia es que esas herramientas suelen estar pensadas para desarrolladores que se manejan con el terminal. Y a veces, como en el caso de OpenClaw, pueden traer problemas y agujeros de seguridad.

Osaurus, en cambio, presenta una interfaz fácil de usar para consumidores y aborda las preocupaciones de seguridad corriendo todo en un sandbox virtual con aislamiento por hardware. Eso limita el alcance de la IA y mantiene a salvo el equipo y los datos del usuario.

¿Cuánto hardware hace falta para correrlo bien?

Por supuesto, la práctica de correr modelos de IA en la máquina propia todavía está en pañales, dado que es intensiva en recursos y dependiente del hardware. Para correr modelos locales, el sistema necesita al menos 64 GB de RAM. Para modelos más grandes como DeepSeek v4, Pae recomienda equipos con cerca de 128 GB de RAM.

Aun así, Pae cree que las necesidades de la IA local van a bajar con el tiempo.

"Le veo el potencial, porque la inteligencia por watt, que es como la métrica para IA local, ha venido subiendo de manera significativa. Está sobre su propia curva de innovación. El año pasado, la IA local apenas podía terminar oraciones, hoy ya puede correr herramientas, escribir código, acceder a tu navegador y comprarte cosas en Amazon... está mejorando cada vez más", dijo.

¿Qué modelos soporta hoy?

Osaurus puede correr hoy MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, DeepSeek V4 y otros. También soporta los foundation models on-device de Apple, la familia LFM on-device de Liquid AI y, en la nube, se conecta con OpenAI, Anthropic, Gemini, xAI/Grok, Venice AI, OpenRouter, Ollama y LM Studio.

Como servidor MCP (Model Context Protocol) completo, también permite que cualquier cliente compatible con MCP acceda a las herramientas del usuario. Además trae más de 20 plugins nativos para Mail, Calendar, Vision, macOS Use, XLSX, PPTX, Browser, Music, Git, Filesystem, Search, Fetch y otros. Recientemente, Osaurus sumó capacidades de voz.

¿Cómo le va frente a Ollama, Msty o LM Studio?

Desde que el proyecto se lanzó hace casi un año, acumula más de 112.000 descargas, según su sitio. La app compite con otras herramientas que permiten correr modelos localmente como Ollama, Msty y LM Studio, pero ofrece un set de funcionalidades diferenciado y se presenta como una alternativa más amigable para quienes no son desarrolladores.

Actualmente, los fundadores de Osaurus, entre ellos el cofundador Sam Yoo, participan del acelerador neoyorquino Alliance. También están pensando los próximos pasos, que podrían incluir ofrecer Osaurus a empresas, por ejemplo del rubro legal o de salud, donde correr LLMs en local podría abordar preocupaciones de privacidad.

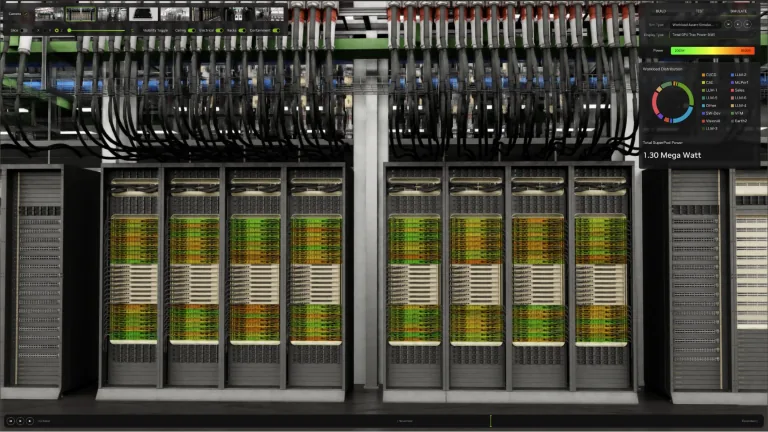

A medida que crece el poder de los modelos de IA locales, el equipo cree que se podría reducir la demanda por centros de datos dedicados a IA.

"Estamos viendo este crecimiento explosivo en el espacio de la IA, donde los proveedores cloud tienen que escalar con centros de datos e infraestructura, pero sentimos que la gente todavía no ha visto realmente el valor de la IA local", dijo Pae. "En lugar de depender de la nube, pueden desplegar un Mac Studio on-prem, y debería usar sustancialmente menos energía. Mantienen las capacidades de la nube, pero no van a depender de un centro de datos para correr esa IA".

Lectura LATAM: la barrera real para Chile es el costo del hardware. Un Mac Studio con 128 GB de RAM ronda los CLP 4 a 5 millones importado, lo que sigue siendo más barato que un año de suscripciones empresariales a Claude o GPT para un equipo legal o clínico de 10 personas, sobre todo si la privacidad de los datos es un requisito regulatorio.