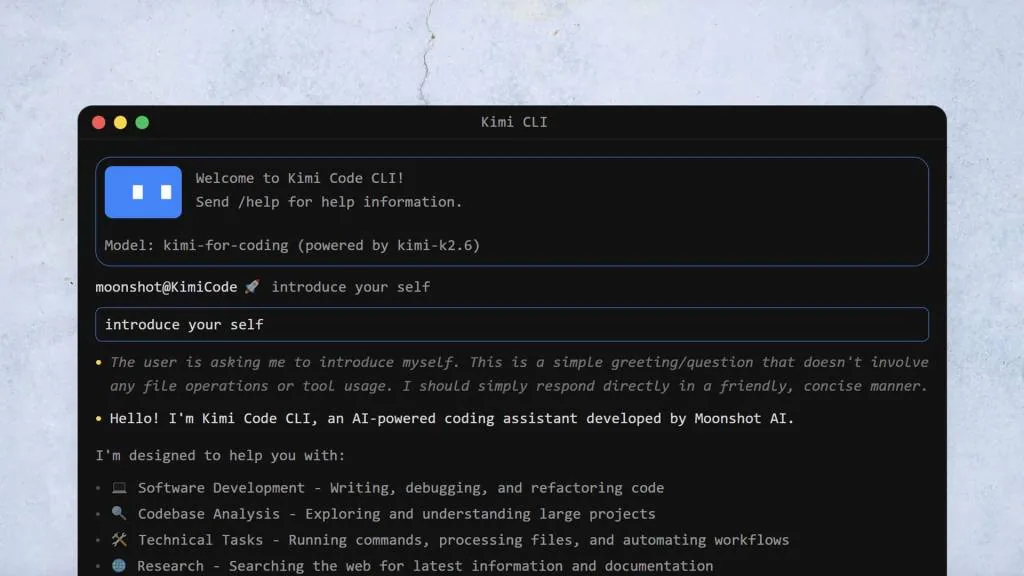

Alibaba lanzó Qwen3.6-27B, un nuevo modelo denso de código abierto con 27.000 millones de parámetros. Según Alibaba, el modelo supera a su predecesor, el Qwen3.5-397B-A17B (397.000 millones de parámetros), en casi todos los benchmarks de programación evaluados. Obtuvo 77,2 en SWE-bench Verified frente a 76,2, y 59,3 en Terminal-Bench 2.0 frente a 52,5.

El modelo maneja tanto texto como razonamiento multimodal. Como modelo "denso", es más fácil de ejecutar que las arquitecturas MoE (Mezcla de Expertos) más complejas, que activan distintos submodelos según la tarea.

Qwen3.6-27B está disponible a través de Qwen Studio, la API de Alibaba Cloud Model Studio y como pesos abiertos en Hugging Face y ModelScope. Está orientado a desarrolladores que buscan alto rendimiento en programación sin lidiar con un modelo de gran tamaño.

Como siempre, los resultados de benchmarks solo insinúan el rendimiento en escenarios reales, y los modelos chinos de código abierto eficientes podrían beneficiarse de la investigación proveniente de laboratorios occidentales de IA.