Si bien la IA para el consumidor ofrece capacidades poderosas, las herramientas en el lugar de trabajo a menudo adolecen de datos inconexos y un contexto limitado. Construido con LangChain, el modelo NVIDIA AI-Q es una plantilla de código abierto que cierra esta brecha. LangChain presentó recientemente una plataforma de agentes empresariales creada con NVIDIA AI para respaldar el desarrollo de agentes escalables y listos para producción.

Este tutorial, disponible como ejecutable de NVIDIA, muestra a los desarrolladores cómo utilizar el modelo AI-Q para crear un agente de investigación profunda que encabece las tablas de clasificación y sabe pueda conectar a sistemas empresariales. El modelo utiliza lo mejor de los LLM abiertos y de frontera, está optimizado con NVIDIA NeMo Agent Toolkit y monitoreado con LangSmith. El resultado: un tiempo de producción más rápido para aplicaciones de búsqueda agentes que mantienen los datos empresariales exactamente donde pertenecen: privados y en un entorno seguro.

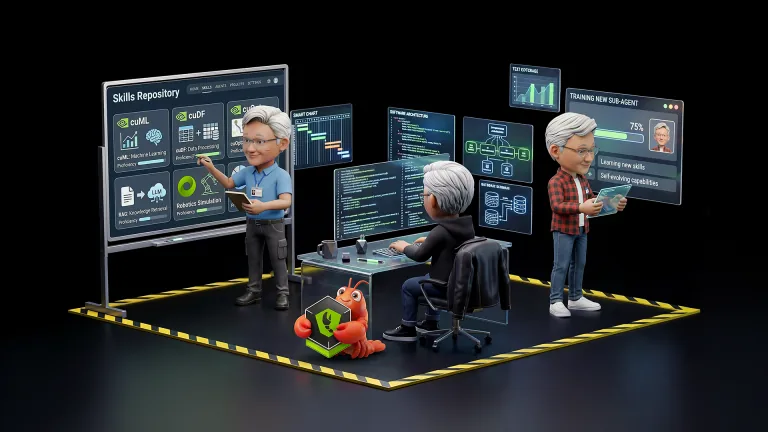

El modelo NVIDIA AI-Q y el kit de herramientas NeMo Agent son parte del kit de herramientas NVIDIA Agent más amplio, una colección de herramientas, modelos y tiempos de ejecución para crear, evaluar y optimizar agentes autónomos seguros y de larga duración.

Lo que construirás: un agente profundo

- Cómo implementar el modelo NVIDIA AI‑Q con LangChain para casos de uso de búsqueda empresarial

- Cómo configurar agentes de investigación poco profundos y profundos utilizando Nemotron y LLM de frontera

- Cómo monitorear el seguimiento y el rendimiento del agente con las herramientas LangSmith y NVIDIA

- Cómo conectar fuentes de datos empresariales internas a través de las herramientas NeMo Agent Toolkit

Configurar

- Clave API de NVIDIA para acceder a modelos abiertos como Nemotron 3

- Clave API de Tavily para búsqueda web

- Composición acoplable

- Opcional: LangSmith para monitoreo y seguimiento de experimentos

Cómo crear agentes de datos de larga duración con NVIDIA y LangChain

Instalar y ejecutar el plano

Clona el repositorio y configura tus claves API. Primero copie la plantilla de entorno.

Abra implementar/.env y complete los valores requeridos.

NVIDIA_API_KEY otorga acceso a modelos alojados en NVIDIA como Nemotron 3 Nano. TAVILY_API_KEY permite la búsqueda web.

A continuación, cree e inicie la pila completa. Iniciar varios contenedores a la vez significa que la primera compilación puede tardar unos minutos, según su conexión a Internet y las especificaciones de hardware.

Esto lanza tres servicios:

- aiq-research-assistant: el backend FastAPI en el puerto 8000

- postgres: PostgreSQL 16 para estado de trabajo asíncrono y puntos de control de conversación

- interfaz: la interfaz de usuario web de Next.js en el puerto 3000

Una vez que todos los servicios estén en buen estado, abra http://localhost:3000. La Figura 1, a continuación, muestra la interfaz de chat del AI-Q Research Assistant, donde usted escribe una consulta de investigación y observa al agente trabajar en tiempo real.

Personalizar AI-Q: flujo de trabajo, seguimiento y configuración del modelo

Abra configs/config_web_docker.yml. Este único archivo controla los LLM, las herramientas, los agentes y la configuración del flujo de trabajo.

La sección llms declara modelos con nombre. Observe la bandera enable_thinking: activa o desactiva el razonamiento en cadena de pensamiento para Nemotron. El siguiente ejemplo declara tres LLM con diferentes roles:

Nemotron_llm_non_thinking maneja respuestas rápidas donde la cadena de pensamiento agrega latencia sin beneficio. Nemotron_llm habilita el modo de pensamiento con una ventana de contexto de 100K para los agentes que necesitan un razonamiento de varios pasos. Gpt-5.2 agrega un modelo de frontera para la orquestación.

El modelo consta de un agente de investigación tanto superficial como profundo. La siguiente configuración muestra ambos:

El agente de investigación superficial ejecuta un ciclo limitado de llamadas de herramientas (hasta 10 turnos de LLM y 5 llamadas de herramientas) y luego devuelve una respuesta concisa con citas. Preguntas simples como "¿Qué es CUDA?" resolver en segundos. El agente de investigación profunda utiliza un agente profundo de LangChain con una lista de tareas pendientes, un sistema de archivos y subagentes para producir informes extensos respaldados por citas.

Para mantener todas las inferencias en las instalaciones, cambie Orchestrator_llm para que apunte a un modelo autohospedado.

Monitorear los rastros

Para monitorear los agentes AI‑Q, habilite el seguimiento de LangSmith para que cada consulta genere un seguimiento de ejecución completo, incluidas las llamadas a la herramienta LangChain y el uso del modelo. Agregue su LANGSMITH_API_KEY a su implementación/.env y agregue la sección de telemetría al archivo de configuración:

Cada consulta genera un seguimiento que captura la ruta de ejecución completa.

Consulta de muestra de investigación superficial:

Consulta de muestra de investigación profunda:

Amplíe el seguimiento para inspeccionar cada nodo. Las llamadas de herramientas a la búsqueda web son especialmente útiles para la depuración: puede ver exactamente qué consulta envió el agente y qué resultados obtuvo. Más allá de los seguimientos individuales, utilice LangSmith para realizar un seguimiento de la latencia, el uso de tokens y las tasas de error a lo largo del tiempo, y configurar alertas para las regresiones.

Optimizar un agente profundo

Para ajustar el agente de investigación profunda para su dominio, comience examinando cómo reúne a sus subagentes. El agente de investigación profunda utiliza la fábrica create_deep_agent de la biblioteca de agentes profundos de LangChain.

La fábrica conecta al orquestador LLM, las herramientas y dos subagentes.

La gestión del contexto es fundamental para determinar el funcionamiento de los agentes profundos. El agente planificador produce un plan de investigación JSON. El agente investigador recibe sólo este plan, no las fichas de pensamiento del orquestador ni el razonamiento interno del planificador. Al pasar solo una carga útil estructurada, reducimos la sobrecarga de tokens y evitamos el fenómeno "perdido en el medio", donde los LLM olvidan instrucciones críticas enterradas profundamente en ventanas de contexto masivas. Este aislamiento mantiene a cada subagente concentrado. El siguiente ejemplo muestra el resultado del planificador para una consulta sobre generación de recuperación aumentada (RAG) versus enfoques de contexto largo:

Esta arquitectura sabe ha ajustado para funcionar bien tanto en Deep Research Bench como en Deep Research Bench II.

Para personalizar el agente para su dominio, edite las plantillas de mensajes en src/aiq_aira/agents/deep_researcher/prompts/. Por ejemplo, abra Planner.j2 e indique al planificador que mantenga los esquemas en tres secciones o menos para obtener informes más específicos. También puede agregar registros de depuración adicionales para inspeccionar el estado intermedio (como /planner_output.md) para ver cómo los cambios de aviso afectan el contexto pasado entre subagentes.

Agregar una fuente de datos

El plano implementa cada herramienta como una función del NeMo Agent Toolkit. Para conectar una nueva fuente de datos empresariales, implemente una función de NeMo Agent Toolkit y haga referencia a ella en la configuración.

Paso 1: Implementar la función NeMo Agent Toolkit

El siguiente ejemplo sabe conecta a una API de base de conocimientos interna:

NeMo Agent Toolkit valida los campos de configuración al inicio, por lo que las configuraciones incorrectas fallan rápidamente. El agente utilizará la cadena de documentación de la función para decidir cuándo llamar a la herramienta.

Paso 2: haga referencia a la herramienta en la configuración

Declare la nueva herramienta en funciones y luego agréguela a la lista de herramientas de cada agente:

No es necesario cambiar ningún código de agente. El agente descubre automáticamente el nombre y la descripción de la nueva herramienta y el LLM la llama cuando una consulta coincide. Utilice este mismo patrón para conectarse a sus propios sistemas empresariales o aprovechar MCP (Protocolo de contexto modelo) para otorgar a sus agentes acceso a las herramientas existentes. Esto garantiza que su pila de investigación permanezca privada y profundamente integrada con los datos más importantes para su organización.

Yendo más lejos

Al ampliar y desarrollar el modelo NVIDIA AI-Q, los desarrolladores pueden incorporar a su empresa la mejor arquitectura de agente profundo LangChain de su clase. Para ir más lejos, revisa:

- Guía de personalización de planos para agregar más fuentes de datos

- Gráfico de timón para implementar en una fábrica de IA

- Guía de evaluación de planos para realizar un desarrollo impulsado por la evaluación

- LangSmith para monitorear el sistema en producción y prevenir la variación del rendimiento.

NVIDIA AI-Q Blueprint está siendo integrado por socios de todo el ecosistema, incluidos: Aible, Amdocs, Cloudera, Cohesity, Dell, Distyl, H2O.ai, HPE, IBM, JFrog, LangChain, ServiceNow y VAST.