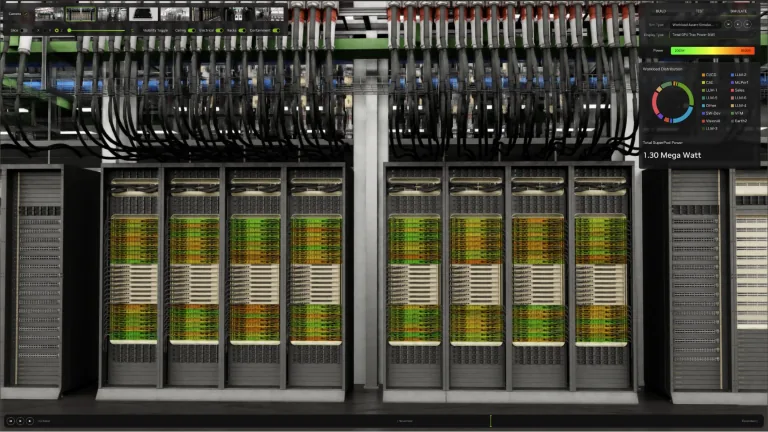

La capacidad de cómputo de los grandes fleets de GPUs abre oportunidades inéditas para innovar y entregar valor a clientes en tiempo récord. Pero esas ventajas vienen con desafíos concretos: a escala, los equipos lidian con hardware heterogéneo, stacks de software que se mueven rápido, presupuestos ajustados de potencia y cargas multiusuario con picos impredecibles. Un solo hotspot, un driver mal configurado o una falla sutil de hardware puede propagarse y derivar en trabajos throttled, SLAs incumplidos y gasto desperdiciado.

A esto se suma la complejidad y la cantidad de componentes en clusters de gran escala, lo que vuelve imprescindible mantener visibilidad sobre las operaciones día a día y entender el estado operacional en cualquier momento. Monitorear la utilización de las GPUs e identificar cuellos de botella durante la ejecución se vuelve más difícil cuanto más crece la flota. Detectar áreas de baja utilización y migrar workloads hacia ellas es una de las mejores formas de asegurar el retorno sobre la inversión.

Por estas razones, el monitoreo GPU-aware es esencial a escala. Los equipos necesitan visibilidad que vaya más allá de saber si el nodo está arriba o abajo: necesitan saber si, en cada momento, cada acelerador está rindiendo como se espera, de manera segura y consistente.

Este artículo introduce NVIDIA Fleet Intelligence, un servicio gestionado basado en agentes para el monitoreo continuo de las GPUs de data center de NVIDIA. Está disponible en disponibilidad general (GA) desde hoy.

¿Cuáles son las áreas clave del monitoreo de GPU?

Las áreas importantes del monitoreo de GPU incluyen potencia, temperatura, rendimiento, salud y configuración uniforme.

- Potencia: monitorear utilización y throttling para mantenerse dentro del presupuesto eléctrico del data center maximizando el rendimiento por watt.

- Temperatura: detectar hotspots y problemas de flujo de aire temprano, antes de que aparezca thermal throttling o envejecimiento prematuro de componentes.

- Rendimiento: observar utilización, ancho de banda de memoria, salud del interconnect y causas de throttling para detectar regresiones y desbalances en la flota.

- Salud: aflorar errores ECC y XID, páginas retiradas, anomalías de HBM, NVLink y PCIe, y otras señales RAS para identificar piezas que están por fallar antes de que efectivamente fallen.

- Configuración uniforme e integridad: como parte de la validación del inventario de GPUs, verificar drivers, firmware y BIOS consistentes para asegurar resultados reproducibles y operación segura, y validar la integridad del firmware.

¿Qué es exactamente NVIDIA Fleet Intelligence?

NVIDIA Fleet Intelligence es un servicio gestionado de bajo nivel, agnóstico al tipo de despliegue, que puede usarse con cualquier stack de software o scheduler. Inicialmente, el servicio soporta a clientes con GPUs y CPUs de data center que administran su propia infraestructura, y a ingenieros que necesitan más visibilidad sobre el comportamiento de GPU y CPU.

El servicio aprovecha tecnología e IP del portafolio de NVIDIA y aprendizajes de operar su propia flota interna de cientos de miles de GPUs distribuidas en NVIDIA DGX Cloud.

Fleet Intelligence usa un agente liviano basado en el host que envía telemetría de GPU al servicio cloud gestionado. NVIDIA publica el agente como un proyecto open source para auditabilidad. El agente se apoya en otras soluciones open source de NVIDIA como GPUd, NVIDIA Data Center GPU Manager (DCGM), y el Attestation SDK. Para más información, visitar NVIDIA/fleet-intelligence-agent en GitHub. Fleet Intelligence se desarrolló con feedback de clientes en acceso temprano (EA), incluidos NVIDIA Cloud Partners (NCPs), Lambda e IREN.

El release GA se concentra en tres áreas:

- Inventario y visualización

- Reportería, alertas y health checks

- Integridad y atestación

Inventario y visualización

Fleet Intelligence ofrece una capa rica para visualizar el inventario global de la flota a través de data centers y clouds. El agente, con footprint mínimo, se instala vía gestores de paquetes Linux o helm install sobre los nodos worker de GPU.

Una vez inscrito, el agente captura información a nivel de nodo que se muestra en el Health Portal alojado en NVIDIA NGC. Como usuario, se puede visualizar la utilización global de la flota de GPUs o segmentada por zonas de cómputo, incluyendo grupos de nodos enrolados en la misma ubicación física o cloud.

En cualquier nivel de la infraestructura, las anomalías se reportan inmediatamente (por ejemplo, errores o umbrales cruzados por consumo eléctrico o temperatura). Esto habilita acceso directo a revisar información detallada de lo que disparó la alerta.

Reportería, alertas y health checks

El agente de Fleet Intelligence se apoya en tecnología de GPUd y DCGM. Las métricas que aportan ambas herramientas se analizan y se envían al Health Service para revisión. El agente permite a Fleet Intelligence monitorear la salud de la flota en tiempo casi real, además de ejecutar health checks periódicos. El agente colecta telemetría sobre host, GPUs, NVLink y red para entregar una imagen holística del estado del sistema.

A medida que se recolectan señales, el servicio analiza errores en el contexto del estado actual y del histórico para entregar recomendaciones de remediación. El agente es de sólo lectura, no modifica configuración del host, y sólo recolecta telemetría y estado de la máquina. Para verificar la data recolectada, se puede escribir salida de muestra localmente o revisar el código fuente del repo público.

También se puede optar por recibir alertas en caso de error o falla por email, Slack y otros canales, y configurar alertas custom para umbrales de baja utilización u otras áreas de interés. Los usuarios pueden configurar reportes para ver inventario y gráficos históricos de consumo eléctrico, tendencias de temperatura, errores y downtime.

El agente emplea health checks pasivos además de checks periódicos. Estos health checks ya estaban disponibles vía DCGM y GPUd. Los nuevos health checks creados a partir del aprendizaje operando las flotas se agregan a medida que aparecen. Fleet Intelligence recolecta de manera continua señales anónimas y metadata sobre fallas y errores en toda la base instalada. Este approach permite mayor fidelidad de datos para aplicar a modelos de categorización predictiva de fallas que estarán disponibles en futuros releases.

Integridad y atestación

Apoyándose en tecnología de NVIDIA Confidential Computing, Fleet Intelligence verifica criptográficamente la integridad de las GPUs, asegurando la autenticidad y confiabilidad del sistema. El agente usa el Attestation SDK para obtener mediciones de la GPU (o "evidence") en tiempo de ejecución. Estas mediciones se firman digitalmente con certificados on-device basados en el root of trust de NVIDIA.

La evidencia se envía al NVIDIA Remote Attestation Service (NRAS) sobre un canal seguro para verificación. NRAS aprovecha los Reference Integrity Manifests (RIMs), estructuras generadas como parte de los builds de vBIOS. El servicio NRAS valida que la evidencia coincida con los valores esperados y devuelve pass/fail al servicio Fleet Intelligence.

Una vez activado, el usuario puede ver los dashboards de inventario con los resultados de los chequeos de integridad que corren diariamente o por demanda. Estos chequeos aseguran que cada GPU de la flota tenga configuración known-good, sin manipular y al día. También se pueden crear reportes de Fleet Intelligence que detallen información de la flota de GPU con el estado actual de integridad. Estos reportes se pueden descargar y usar con otras herramientas de reportería.

Según Chuan Li, Chief Scientific Officer de Lambda, "NVIDIA Fleet Intelligence le dio al equipo de research de Lambda visibilidad end-to-end a través de nuestra flota de GPUs Blackwell y Hopper con setup mínimo. Sus alertas capturan tanto fallas activas como señales tempranas de advertencia. Sus reportes convierten la salud a escala de flota en insights accionables".

¿Cómo empezar con NVIDIA Fleet Intelligence?

El servicio entrega visibilidad integral sobre potencia, temperatura, rendimiento, salud y configuración de las flotas de GPUs y CPUs de NVIDIA, asegurando que cada chip opere con eficiencia y confiabilidad óptimas. La integración de agentes livianos para telemetría en tiempo real, combinada con visualización y mecanismos de alerta robustos, permite a las empresas maximizar el ROI y mantener estándares operacionales óptimos.

El agente Fleet Intelligence open source y la incorporación de tecnologías de integridad y atestación subrayan el compromiso de NVIDIA con la transparencia y la seguridad. A medida que los negocios siguen escalando despliegues de GPU y CPU, Fleet Intelligence ofrece herramientas esenciales para navegar la complejidad de los data centers modernos, asegurando rendimiento sostenible y predecible en entornos diversos.

Para el contexto regional, el servicio resulta especialmente interesante para clusters universitarios y laboratorios que en LatAm operan stack de GPUs Hopper sin presupuesto para licencias de observabilidad comercial tipo Datadog o New Relic, que pueden costar entre USD 50 y USD 200 por host al mes. El componente de integridad criptográfica, en cambio, queda fuera del alcance de la mayoría de las instalaciones académicas locales: requiere arquitectura Blackwell o Vera Rubin, hardware que en Chile todavía no aparece en proveedores como ENTEL Cloud o servicios estatales como REUNA.

Solicitar acceso a NVIDIA Fleet Intelligence está abierto desde hoy. El servicio se ofrece sin costo a propietarios, operadores y tenants cloud de GPUs de data center de NVIDIA. Soporta las arquitecturas Vera Rubin, Blackwell y Hopper. La atestación criptográfica sólo está soportada en Vera Rubin y Blackwell.